Bộ phim WarGames năm 1983 kể về một hacker trẻ tuổi xâm nhập vào hệ thống vũ khí hạt nhân được vận hành bởi trí tuệ nhân tạo của Mỹ. Khi bộ phim đến tay Tổng thống Ronald Reagan, nó đã khiến vị tổng tư lệnh này hỏi lực lượng của mình rằng liệu hệ thống phòng thủ của nước ông có thể bị can thiệp như vậy hay không. Hóa ra chuyện đó hoàn toàn có thể. Nhưng thứ mà họ không nói đến đó là việc sử dụng trí tuệ nhân tạo (AI) để kiểm soát kho vũ khí hạt nhân quốc gia. Điều đó vẫn còn là quá xa vời vào năm 1983, nhưng bây giờ mọi chuyện đã khác.

Tại hội nghị hacker Def Con, 7 chú bot trí tuệ nhân tạo được cho đấu với nhau trong trò chơi cướp cờ (capture the flag). Khi tham gia trò chơi, mỗi nhóm sẽ được giao cho một máy tính hay một mạng để bảo vệ, nhiệm vụ là không được để cho đội khác cắm "cờ" (có thể là phần mềm hay một thứ gì đó) vào máy của mình. Song song đó, mỗi đội cũng tranh thủ đi tấn công các đội khác để gắn "cờ" vào máy của họ. Điều thú vị ở Def Con đó là việc tấn công và bảo vệ sẽ do AI chịu trách nhiệm phần lớn, không cần tới sự can thiệp của con người như truyền thống.

Mục đích của cuộc thi cướp cờ này không chỉ để các hacker chứng tỏ khả năng mà còn để lôi kéo nhiều công ty và nhà nghiên cứu tập trung vào việc phát triển trí tuệ nhân tạo với mức tự động hóa cao. Bộ quốc phòng Mỹ (DoD) đã giao cho cơ quan nghiên cứu DARPA (trực thuộc Bộ) nhiệm vụ đảm bảo rằng Mỹ sẽ luôn đi ở tuyến đầu về mảng này.

Hiện tại Mỹ đang triển khai quân lính ở nhiều nơi để chống khủng bố và các nhóm cực đoan, nhưng thông qua Def Con, DoD đang muốn tập trung vào những xung đột lớn hơn có khả năng diễn ra trong tương lai, ví dụ như các mẫu thuẫn với Nga, Trung Quốc hay Triều Tiên. Arati Prabhakar, giám đốc DARPA, cho biết: "Trong cả các cấp quân sự lẫn cấp lãnh đạo, chúng ta đang thấy ngày càng có nhiều người tập trung xây dựng những khả năng mới để sử dụng nếu Mỹ cần ngăn chặn hay đánh bại một đối thủ nào đó".

Tại hội nghị hacker Def Con, 7 chú bot trí tuệ nhân tạo được cho đấu với nhau trong trò chơi cướp cờ (capture the flag). Khi tham gia trò chơi, mỗi nhóm sẽ được giao cho một máy tính hay một mạng để bảo vệ, nhiệm vụ là không được để cho đội khác cắm "cờ" (có thể là phần mềm hay một thứ gì đó) vào máy của mình. Song song đó, mỗi đội cũng tranh thủ đi tấn công các đội khác để gắn "cờ" vào máy của họ. Điều thú vị ở Def Con đó là việc tấn công và bảo vệ sẽ do AI chịu trách nhiệm phần lớn, không cần tới sự can thiệp của con người như truyền thống.

Mục đích của cuộc thi cướp cờ này không chỉ để các hacker chứng tỏ khả năng mà còn để lôi kéo nhiều công ty và nhà nghiên cứu tập trung vào việc phát triển trí tuệ nhân tạo với mức tự động hóa cao. Bộ quốc phòng Mỹ (DoD) đã giao cho cơ quan nghiên cứu DARPA (trực thuộc Bộ) nhiệm vụ đảm bảo rằng Mỹ sẽ luôn đi ở tuyến đầu về mảng này.

Hiện tại Mỹ đang triển khai quân lính ở nhiều nơi để chống khủng bố và các nhóm cực đoan, nhưng thông qua Def Con, DoD đang muốn tập trung vào những xung đột lớn hơn có khả năng diễn ra trong tương lai, ví dụ như các mẫu thuẫn với Nga, Trung Quốc hay Triều Tiên. Arati Prabhakar, giám đốc DARPA, cho biết: "Trong cả các cấp quân sự lẫn cấp lãnh đạo, chúng ta đang thấy ngày càng có nhiều người tập trung xây dựng những khả năng mới để sử dụng nếu Mỹ cần ngăn chặn hay đánh bại một đối thủ nào đó".

Cũng vì vậy mà DoD đã giới thiệu chiến lược phản khán thứ 3 của mình (offset strategy). Loại chiến lược này thường được sinh ra khi Mỹ đối mặc với một số vấn tác chiến nào đó. Trước đây, chiến lược phản khán đầu tiên của họ chính là xây dựng kho vũ khí hạt nhân. Chiến lược phản khán thứ hai là làm ra những tên lửa hành trình thông minh dựa trên dữ liệu về giám sát và gián điệp. Còn bây giờ, chiến lược thứ ba tập trung vào việc tạo ra một quân đội AI. Đó là kế hoạch dài hạn liên quan tới chiến tranh mạng, tự động hóa, robot và cách mà con người sẽ làm việc chung với máy trên chiến trường.

"Thông tin tình báo của chúng tôi gợi ý rằng các đối thủ đã bắt đầu việc này rồi. Chúng tôi biết Trung Quốc đang đầu tư vào robot và tự động hóa. Tổng tư lệnh Nga Valery Gerasimov mới đây cho biết quan đội nước này đang chuẩn bị để chiến đấu trên mặt trận robot", thư ký bộ quốc phòng Bob Work cho hay.

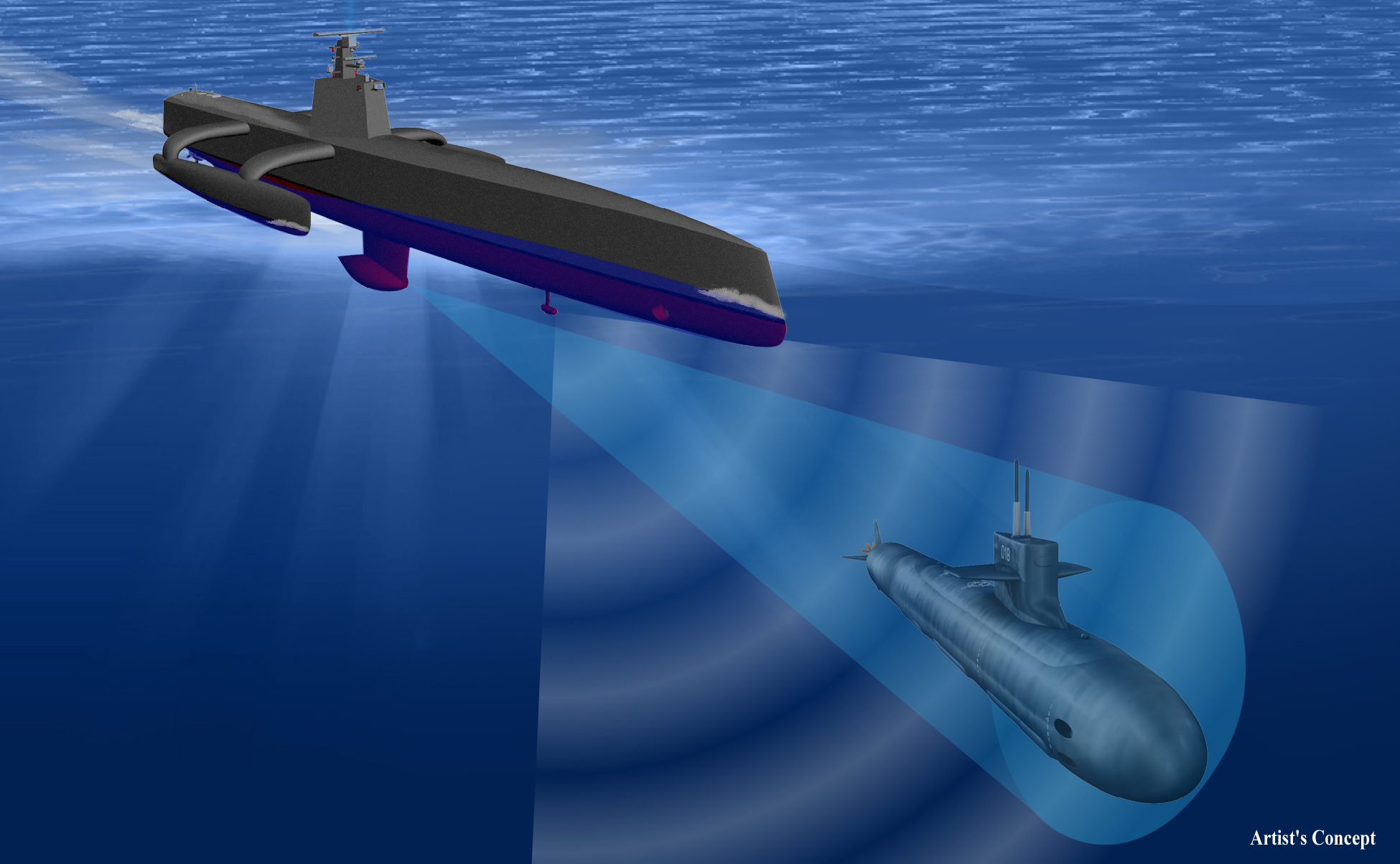

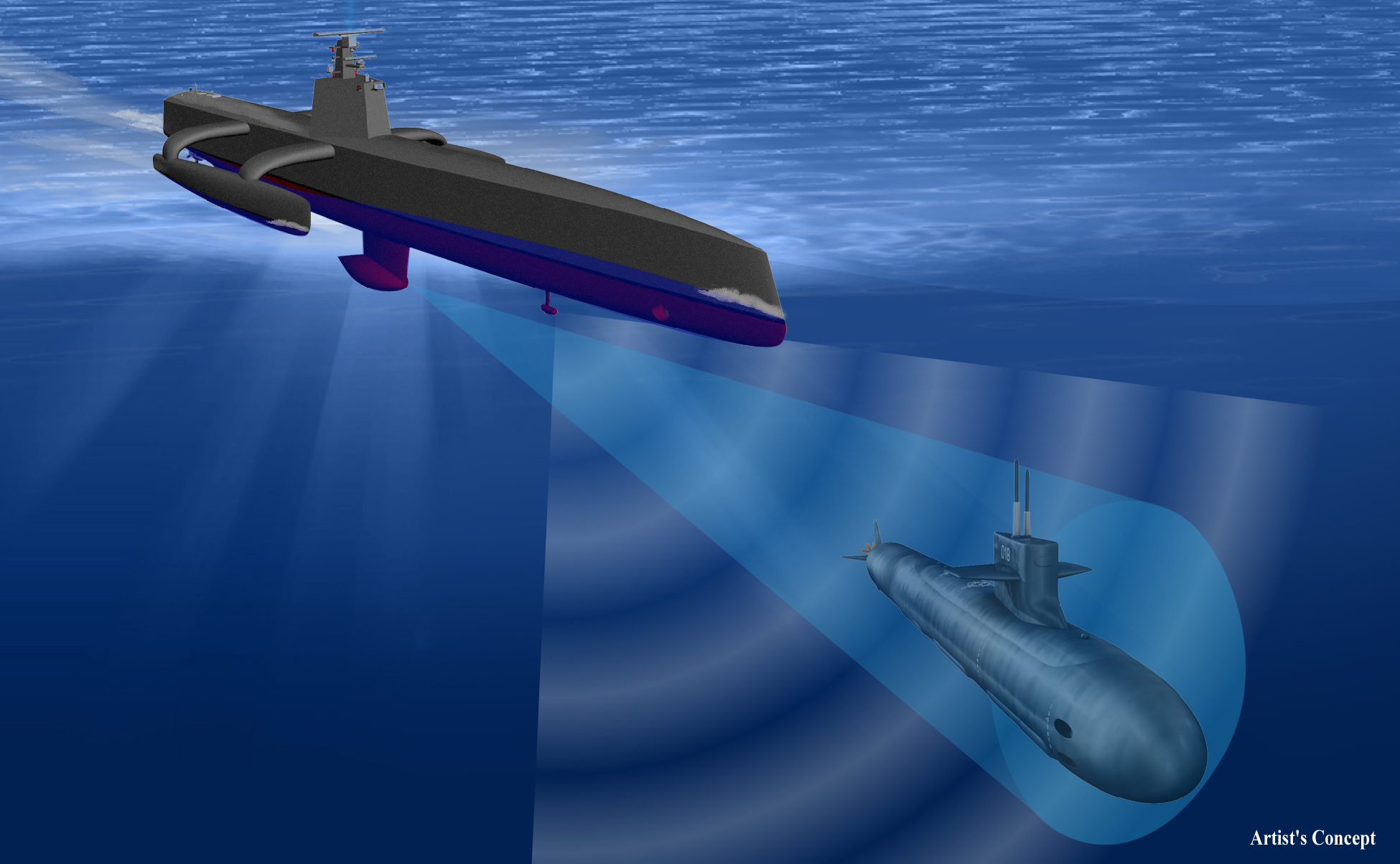

Hiện tại các máy bay drone của quân đội tuy là không có người lái trên khoan nhưng vẫn phải có người điều khiển từ một trạm cách xa mục tiêu. Trong tương lai, những chiếc drone này sẽ tự lái hoàn toàn, cả drone trên không, trên bộ lẫn dưới nước. Chúng có thể làm được điều đó là nhờ vào trí tuệ nhân tạo, khi ấy con người chỉ đóng vai trò giám sát mà thôi. DARPA hiện đang nghiên cứu hai thiết bị tự bay. Một chiếc nằm trong chương trình CODE nhằm tạo ra chiếc máy bay không chỉ dùng để bay giám sát mà còn để tấn công. Chiếc còn lại là một đội máy bay nhỏ Gremline có thể được triển khai và rút về ngay từ trên không.

Nhưng để đội robot này tự bay được trên không, DoD sẽ cần phải chắc chắn rằng chúng có thể nói chuyện với nhau và biết đâu là ta, đâu là địch. DARPA đã giới thiệu một chương trình thi thố để các đội làm ra một giải pháp machine learning nào đó nhằm giúp các thiết bị giao tiếp, đoán xem đối thủ đang làm gì và nghĩ ra cách tận dụng giải tần số radio một cách hiệu quả.

Song song đó, DARPA đã mở chương trình "Học hỏi hành vi cho Chiến tranh mạng thông minh" (BLADE). Việc nghiên cứu này sẽ phát triển các khả năng để chống lại những mối nguy hiểm mới và luôn thay đổi trong môi trường tác chiến". Đây là hai trong số các giải pháp mà DARPA đang làm để giữ kênh liên lạc thông suốt giữa mọi thứ ở phe ta trên chiến trường. Tuy nhiên, chưa giải pháp nào sẵn sàng để đưa vào sử dụng trong tương lai.

Tuy AI mạnh là vậy nhưng nó vẫn có những hạn chế khá lớn, và vẫn chưa thể gọi là hoàn hảo. Có một số mặt AI làm tốt hơn người, chẳng hạn như nhận dạng hình ảnh, nhưng "khi chúng mắc sai lầm thì đó là những sai làm mà không con người nào mắc phải cả". Nếu có vấn đề gì xảy ra, bạn khó mà biết lý do vì sao. "Bạn không hiểu điều gì đang diễn ra".

Ngoài ra cũng còn vấn đề về niềm tin. Làm sao quân đội dám triển khai một thứ vũ khí mà họ không thể hiểu nó hoàn toàn, và khi nào thì họ đủ tự tin để làm điều đó? DARPA và DoD đang cố gắng giải quyết vấn đề này.

Quảng cáo

Ngay cả khi bạn tin tưởng vào hạ tầng AI mà bạn tạo ra và tin nó có thể làm hết những gì nó tạo ra để làm thì hạ tầng đó vẫn có nguy cơ bị hack. "Tôi không nghĩ rằng người ta hiểu điều này có ảnh hưởng như thế nào đến những hệ thống dạng này", Prabhakar nói. DARPA rất lo lắng về chuyện một bộ não nhân tạo bị hack để làm những chuyện đáng ra nó không được phép làm và gây hại cho con người. Một chiếc drone gắn súng bị hack có thể trở thành thảm họa.

Có một tương lai chắc chắn rằng những trận chiến trong tương lai sẽ là trận chiến của AI và robot, tuy nhiên nó không chỉ là drone bay lòng vòng ngoài mặt trận. Nó sẽ là sự kết hợp giữa con người với máy cùng làm việc với nhau với cả một hạ tầng quốc phòng đằng sau. Khi đó, ai làm được AI tốt nhất, xịn nhất sẽ là người chiến thắng.

Nguồn: Engadget