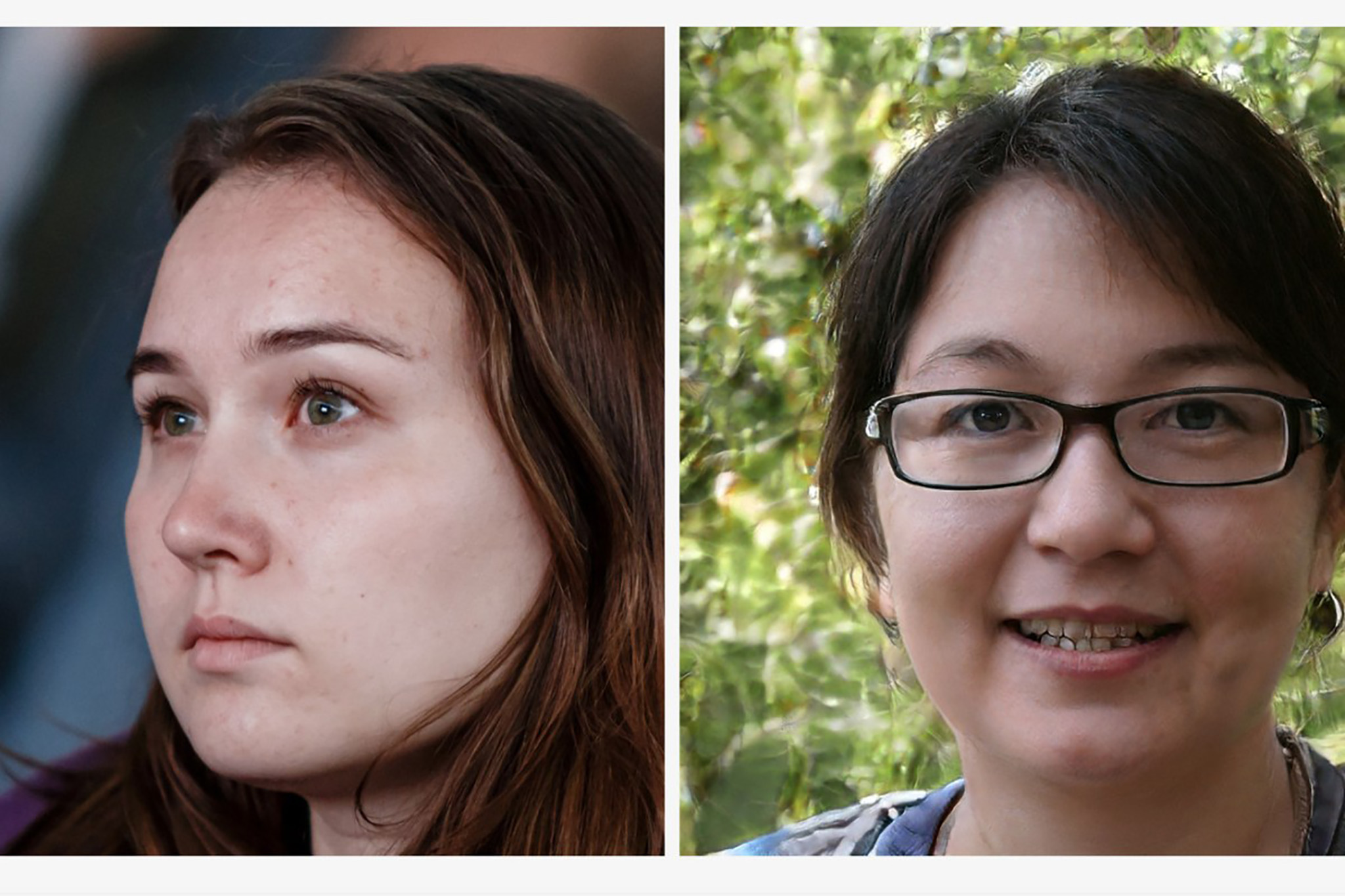

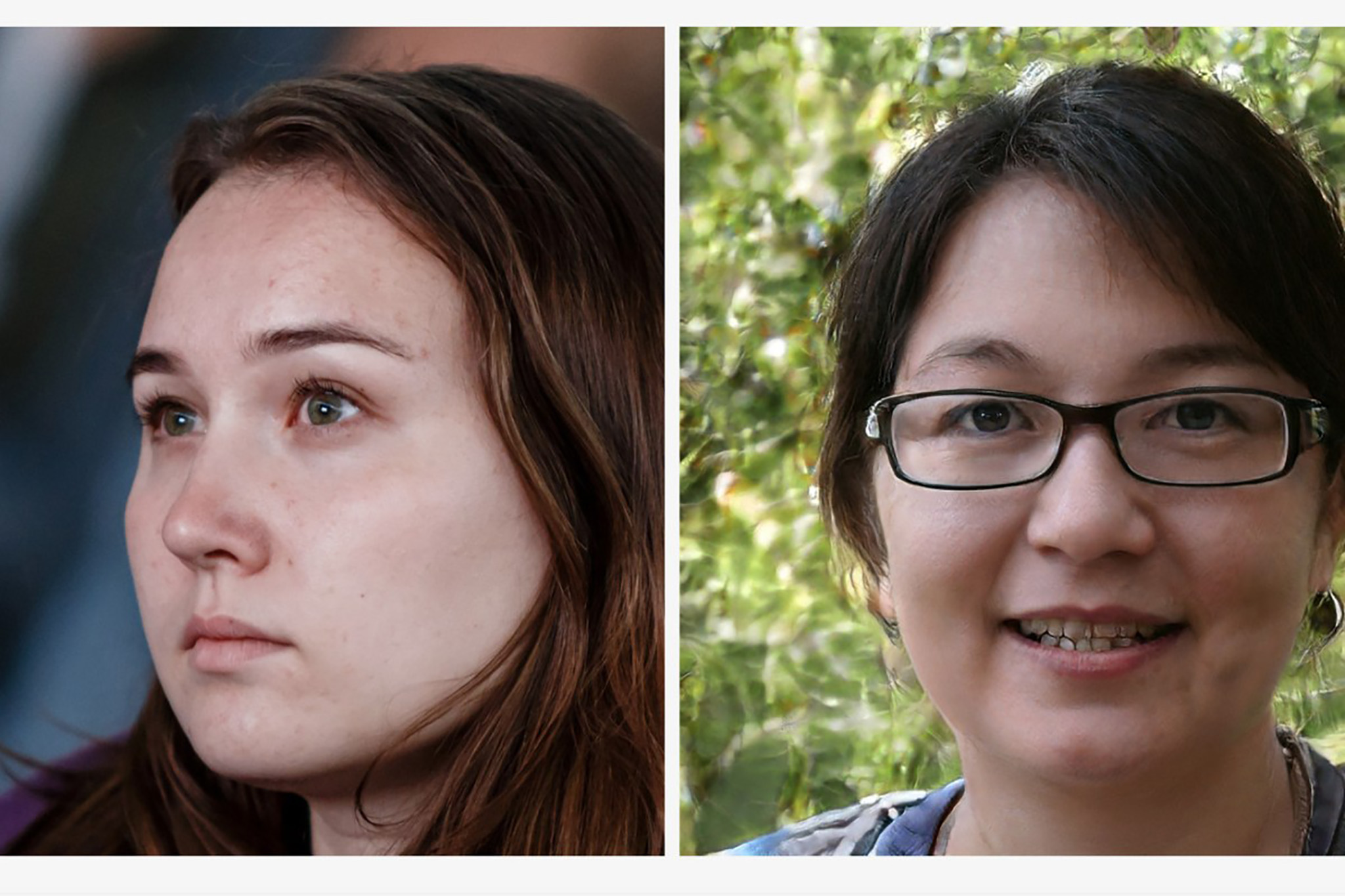

Hồi tháng 02/2019, một trang web tên là https://www.thispersondoesnotexist.com/ xuất hiện, sử dụng AI để tạo ra những bức hình khuôn mặt con người giống hệt như thật. Mới đây nhất, anh em có thể thư giãn và thử thách độ tinh mắt của bản thân bằng cách truy cập vào trang web http://whichfaceisreal.com/. Nó sẽ hiện ra hai bức hình, một là ảnh chụp người thật, bức còn lại được tạo ra từ thuật toán StyleGAN. Anh em chỉ việc click vào bức hình nào anh em nghĩ là người thật, và chờ trang web đưa ra kết quả, ví dụ như hình dưới đây:

Trang web "đố vui" này được hai giảng viên đại học Washington, Mỹ là Jevin West và Carl Bergstrom tạo ra. Họ thấy rằng sự phát triển với tốc độ quá nhanh của AI như hiện tại có thể khiến cho con người bị ảnh hưởng tiêu cực trong việc chia sẻ thông tin trên mạng internet, khi những bức hình, và sau này có thể là tin tức fake do AI tạo ra bị phát tán tràn lan.

"Khi một công nghệ mới như thế này xuất hiện, thời điểm nguy hiểm nhất là khi mọi người không biết đến sự tồn tại của nó. Đó chính là lúc những công nghệ này có thể đánh lừa con người hiệu quả nhất. Điều chúng tôi đang muốn làm là giúp cộng đồng mạng biết về sự tồn tại của công nghệ StyleGAN, giống hệt như thời điểm mọi người nhận ra rằng một bức hình có thể được chỉnh sửa bằng Photoshop ấy," Bergstrom và West chia sẻ với The Verge.

Quay trở lại với StyleGAN. Đây là một thuật toán deep learning sử dụng cách tiếp cận mang tên GAN (generative adversarial network). Với thuật toán kiểu này, hai AI sẽ được cho đối đầu với nhau. Trong trường hợp của StyleGAN, một AI có nhiệm vụ tạo ra một bức hình mặt người sau khi xem hàng chục triệu bức hình chân dung người thật trên internet, và AI còn lại sẽ có nhiệm vụ tìm ra điểm sai khác khiến bức hình đó không thuyết phục. Sau vài tuần tự "thi đấu" và tự nâng cấp, đây là kết quả:

Thuật toán StyleGAN được ba kỹ sư tại Nvidia là Tero Karras, Samuli Laine và Timo Aila tạo ra, dựa trên thành quả trước đó của Ian Goodfellow cùng các đồng sự. Điều đáng lo ngại là, kỹ thuật huấn luyện AI theo kiểu GAN này còn có thể giúp những hệ thống neural network có thể bóp méo cả video lẫn âm thanh chứ chẳng riêng gì hình ảnh, ví dụ Deepfakes chẳng hạn. Dưới đây là một đoạn video dùng Deepfakes để tạo ra một cảnh cựu tổng thống Obama phát biểu, và nó hoàn toàn không tồn tại ngoài đời thật:

Theo Jevin West, ở thời điểm hiện tại những bức hình fake mặt người được AI tạo ra còn có thể phân biệt được, như anh em có thể thử ngay trong trang web mình ghi ở đầu bài, nhưng trong vòng 3 năm nữa, nó sẽ giống thật hơn bao giờ hết. Anh em có thể thấy trong những bức hình AI tạo ra, nhiều chi tiết tương đối dễ nhận ra, từ sợi tóc, đến sự cân bằng của khuôn mặt, vị trí môi, tai, khóe mắt và nhiều chi tiết khác.

Trang web "đố vui" này được hai giảng viên đại học Washington, Mỹ là Jevin West và Carl Bergstrom tạo ra. Họ thấy rằng sự phát triển với tốc độ quá nhanh của AI như hiện tại có thể khiến cho con người bị ảnh hưởng tiêu cực trong việc chia sẻ thông tin trên mạng internet, khi những bức hình, và sau này có thể là tin tức fake do AI tạo ra bị phát tán tràn lan.

"Khi một công nghệ mới như thế này xuất hiện, thời điểm nguy hiểm nhất là khi mọi người không biết đến sự tồn tại của nó. Đó chính là lúc những công nghệ này có thể đánh lừa con người hiệu quả nhất. Điều chúng tôi đang muốn làm là giúp cộng đồng mạng biết về sự tồn tại của công nghệ StyleGAN, giống hệt như thời điểm mọi người nhận ra rằng một bức hình có thể được chỉnh sửa bằng Photoshop ấy," Bergstrom và West chia sẻ với The Verge.

Quay trở lại với StyleGAN. Đây là một thuật toán deep learning sử dụng cách tiếp cận mang tên GAN (generative adversarial network). Với thuật toán kiểu này, hai AI sẽ được cho đối đầu với nhau. Trong trường hợp của StyleGAN, một AI có nhiệm vụ tạo ra một bức hình mặt người sau khi xem hàng chục triệu bức hình chân dung người thật trên internet, và AI còn lại sẽ có nhiệm vụ tìm ra điểm sai khác khiến bức hình đó không thuyết phục. Sau vài tuần tự "thi đấu" và tự nâng cấp, đây là kết quả:

Thuật toán StyleGAN được ba kỹ sư tại Nvidia là Tero Karras, Samuli Laine và Timo Aila tạo ra, dựa trên thành quả trước đó của Ian Goodfellow cùng các đồng sự. Điều đáng lo ngại là, kỹ thuật huấn luyện AI theo kiểu GAN này còn có thể giúp những hệ thống neural network có thể bóp méo cả video lẫn âm thanh chứ chẳng riêng gì hình ảnh, ví dụ Deepfakes chẳng hạn. Dưới đây là một đoạn video dùng Deepfakes để tạo ra một cảnh cựu tổng thống Obama phát biểu, và nó hoàn toàn không tồn tại ngoài đời thật:

Tham khảo The Verge

![[Vui] Mời anh em chơi trò đoán khuôn mặt, đâu là người thật và đâu là hình AI tạo ra?](https://photo2.tinhte.vn/data/attachment-files/2019/03/4581863_Cover_AI.jpg)