Mô hình ngôn ngữ GPT-4 đã chính thức ra mắt, cùng với đó là những hứa hẹn thay đổi cách con người tương tác với máy móc, cũng như cách máy tính phục vụ con người. Cùng lúc, cuộc đua nghiên cứu phát triển sản phẩm AI giữa hai ông lớn Microsoft và Google cũng đang diễn ra càng lúc càng nóng, với những công bố và thông tin chính thức được đưa ra. Hầu hết chúng, trong mắt người dùng các dịch vụ trực tuyến đều chẳng mấy cuốn hút, vì trong đó đều là những thuật ngữ chuyên ngành rắc rối và khó hiểu đối với phần đông.

Nhưng không có những thuật ngữ và thông tin như vậy, cũng sẽ rất khó để mô tả được cách những thuật toán machine learning vận hành và phục vụ hàng tỷ người.

PaLM về cơ bản giống hệt như LLaMa mà Meta vừa công bố cách đây ít lâu, hay chính bản thân GPT của OpenAI. Google vừa tuyên bố cho ra mắt API mô hình ngôn ngữ này kết hợp với những công cụ phục vụ doanh nghiệp.

Với PaLM, các doanh nghiệp sẽ có thể tuỳ chỉnh mô hình để làm rất nhiều tác vụ. Từ biến mô hình thành chatbot phục vụ hỗ trợ khách hàng, biến nó thành công cụ tổng hợp thông tin trong môi trường doanh nghiệp, ví dụ tổng hợp ý chính trong những cuộc họp trực tuyến, hay thậm chí là viết cả code, Google nói PaLM làm được hết.

Nhưng không có những thuật ngữ và thông tin như vậy, cũng sẽ rất khó để mô tả được cách những thuật toán machine learning vận hành và phục vụ hàng tỷ người.

Google tung ra API mô hình ngôn ngữ PaLM

PaLM về cơ bản giống hệt như LLaMa mà Meta vừa công bố cách đây ít lâu, hay chính bản thân GPT của OpenAI. Google vừa tuyên bố cho ra mắt API mô hình ngôn ngữ này kết hợp với những công cụ phục vụ doanh nghiệp.

Với PaLM, các doanh nghiệp sẽ có thể tuỳ chỉnh mô hình để làm rất nhiều tác vụ. Từ biến mô hình thành chatbot phục vụ hỗ trợ khách hàng, biến nó thành công cụ tổng hợp thông tin trong môi trường doanh nghiệp, ví dụ tổng hợp ý chính trong những cuộc họp trực tuyến, hay thậm chí là viết cả code, Google nói PaLM làm được hết.

Đọc thêm: https://tinhte.vn/thread/google-se-mang-tinh-nang-tao-hinh-anh-bang-van-ban-len-gboard-nho-model-ai-imagen.3639179/

Và để hỗ trợ các doanh nghiệp tuỳ biến PaLM, Google cũng kẹp API mô hình ngôn ngữ này với bộ công cụ tuỳ chỉnh MakerSuite. Nhờ công cụ này, các kỹ thuật viên của các doanh nghiệp có thể tuỳ chỉnh API PaLM ngay trên nền trình duyệt theo đúng nhu cầu, rất tiện lợi. Còn quá trình huấn luyện mô hình ngôn ngữ để phục vụ nhu cầu của từng khách hàng đương nhiên vẫn được xử lý thông qua nền tảng dịch vụ đám mây Google Cloud.

Bên cạnh PaLM API, Google cũng đang mở rộng hỗ trợ nền tảng Vertex AI, công cụ giúp các doanh nghiệp huấn luyện và ứng dụng mô hình ngôn ngữ. Vertex sẽ được tiếp cận nhiều mô hình do chính các kỹ sư của Google Research hoặc công ty con DeepMind của Google, rồi sau này sẽ tiếp cận cả những mô hình ngôn ngữ mã nguồn mở hoặc của bên thứ 3.

Đọc thêm: https://tinhte.vn/thread/microsoft-co-prometheus-google-co-bard-gio-meta-cung-da-co-chatbot-llama.3638228/

Microsoft có Prometheus, Google có Bard, giờ Meta cũng đã có chatbot LLaMa

CEO Meta, Mark Zuckerberg vừa giới thiệu mô hình ngôn ngữ LLaMa, viết tắt của Large Language Model Meta AI: “Hôm nay chúng tôi cho ra mắt mô hình ngôn ngữ AI quy mô lớn mang tên LLaMa để giúp các nhà nghiên cứu cải thiện công việc của họ.

tinhte.vn

Những công bố mới của Google là thứ phần đông người dùng không quan tâm. Nhưng vấn đề nằm ở chỗ, đem API tới cho các doanh nghiệp, thì việc ứng dụng mô hình ngôn ngữ nói riêng cũng như AI nói chung sẽ trở nên phổ biến, giúp công nghệ này tiếp cận nhiều người dùng hơn trong tương lai. Đó cũng chính là những gì Meta, OpenAI và Microsoft cũng đang triển khai, bên cạnh việc tạo ra những giải pháp ứng dụng mô hình ngôn ngữ phục vụ người dùng cá nhân, mà ChatGPT chính là một ví dụ cụ thể.

Microsoft chơi lớn, đầu tư GPU cực mạnh Nvidia H100 xử lý AI

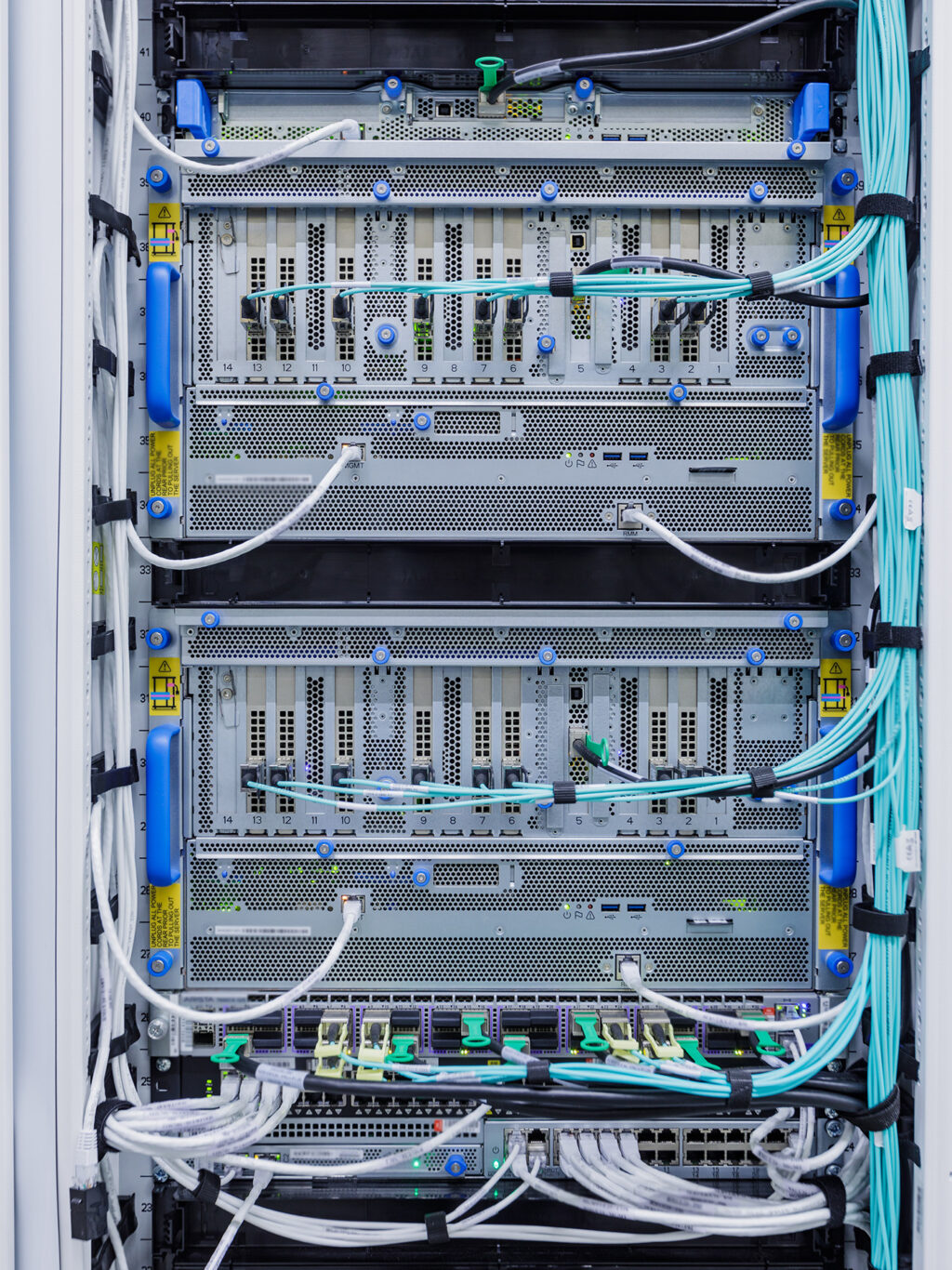

Trên blog chính thức của Microsoft, tập đoàn này vừa hé lộ những chi tiết kỹ thuật của một hệ thống máy tính huấn luyện thuật toán AI, để công bố việc nâng cấp toàn diện dàn máy chủ vận hành xử lý ChatGPT trên máy chủ đám mây Azure.

Trước đó, cụm máy chủ Azure xử lý AI của Microsoft được trang bị cụm máy chủ thế hệ cũ, ND A100 v4, bên trong là những GPU Nvidia A100 Tensor Core kiến trúc Ampere, được thiết kế riêng để tăng tốc xử lý những thuật toán machine learning. Hàng nghìn GPU như vậy được Microsoft trang bị cho máy chủ, từ đó tạo ra cơ sở hạ tầng phục vụ cho Microsoft, cho OpenAI, hay bất kỳ đối tác doanh nghiệp nào muốn ứng dụng sức mạnh xử lý của các mô hình ngôn ngữ nói riêng và các thuật toán AI nói chung.

Quảng cáo

Scott Guthrie, phó chủ tịch phụ trách AI và điện toán đám mây của Microsoft cho biết họ đã đầu tư vìa trăm triệu USD để nâng cấp hệ thống. Giờ máy chủ Azure phục vụ xử lý AI được vận hành bởi cả GPU A100 đời trước, lẫn GPU H100 Tensor Core, kiến trúc Hopper mới nhất của Nvidia, được giới thiệu vào năm ngoái.

Những đối tác của Microsoft thuê máy chủ Azure xử lý AI sẽ được tiếp cận với hệ thống scalable cực kỳ khủng, với sức mạnh từ 8 đến hàng nghìn GPU tuỳ vào nhu cầu cũng như túi tiền. Và bên trong một cụm máy chủ chạy ảo hoá NC H100 v5 VM là những thông số kỹ thuật như thế này:

- 8 GPU Nvidia H100 Tensor Core, kết nối với nhau thông qua cầu nối NVSwitch và NVLink 4.0

- Cầu nối dữ liệu Nvidia Quantum-2 CX7 InfiniBand băng thông 400 Gb/s, mỗi máy ảo có tốc độ xử lý dữ liệu 3.2 Tb/s.

- Cầu nối NVSwitch và NVLink 4.0 tạo ra băng thông dữ liệu 3.6 TB/s trong toàn bộ cụm 8 GPU H100.

- 4 CPU Intel Xeon Scalable.

- Kết nối PCIe Gen 5, băng thông của mỗi GPU đạt ngưỡng 64GB/s.

- RAM DDR5 4800MHz 16 Channel.

Đọc sơ qua cấu hình mỗi cụm máy chủ cũng có thể thấy rõ một điều, khi những mô hình ngôn ngữ và thuật toán machine learning càng phát triển, có càng nhiều tham số để tạo ra những nội dung chân thực và đạt yêu cầu nhất, thì sức mạnh điện toán cũng phải tăng theo cấp số nhân. Hệ quả là cả chi phí mua sắm thiết bị lẫn chi phí vận hành đều sẽ tăng trong thời gian tới. Và thương mại hoá chính những hệ thống máy chủ này cho các đối tác doanh nghiệp là hướng đi hợp lý nhất.

Đọc thêm: https://tinhte.vn/thread/da-bat-dau-cuoc-dua-pha-gia-dich-vu-chatbot-ai-va-mo-hinh-ngon-ngu.3643528/