74 bình luận

Chia sẻ

Bài nổi bật

có lol mà tin thằng sony này, đến con của nó camera như nồi. Nhớ lúc mua con Aqua camera 21 hay 23mpx gì đó. Chụp xấu hơn cả con 5mpx iphone.

Thà nói mọe cảm biến sony nghe còn an tâm gấp mấy lần dăm ba cái ống kính Leica này Leica nọ =))

bài viết ghi thông tin không đầy đủ gây hiểu nhầm cho nhiều người nhất là trong khi gần đây con redmi note 7 đang bị bóc phốt về camera 48mpx.

1. redmi note 7 hiện nay đang dùng cảm biến của SAMSUNG chứ không phải SONY do thiếu nguồn cung của SONY.

2. chip đang sử dụng trên redmi note 7 là snap 660 cũng ko hỗ trợ độ phân giải 48mpx thực sự của SONY.

3. cảm biến của SONY và SAMSUNG cơ chế hoàn toàn khác nhau.

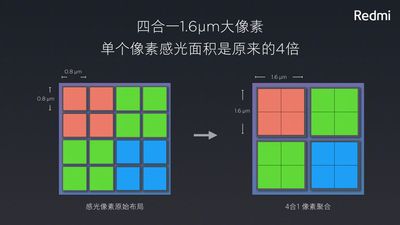

-Với SONY là chính xác độ phân giải 48mpx, mỗi điểm ảnh kích thước 0,8. khi thiếu sáng thì 4 điểm ảnh (2 xanh lá, 1 đỏ, 1 xanh nước biển) gộp thành 1 (có thể thành 1 trong 3 màu nên trên tùy theo vị trí).

- Với SAMSUNG là độ phân giải có 12mpx, mỗi điểm ảnh kích thước 1,6 nhưng có thể chia 1 điểm ảnh (ví dụ màu xanh lá) thành 4. (vẫn là màu xanh lá). nên về bản chất samsung chỉ là resize lại cái ảnh từ 12mpx lên 48mpx. chả có tác dụng gì ngoài marketing.

1. redmi note 7 hiện nay đang dùng cảm biến của SAMSUNG chứ không phải SONY do thiếu nguồn cung của SONY.

2. chip đang sử dụng trên redmi note 7 là snap 660 cũng ko hỗ trợ độ phân giải 48mpx thực sự của SONY.

3. cảm biến của SONY và SAMSUNG cơ chế hoàn toàn khác nhau.

-Với SONY là chính xác độ phân giải 48mpx, mỗi điểm ảnh kích thước 0,8. khi thiếu sáng thì 4 điểm ảnh (2 xanh lá, 1 đỏ, 1 xanh nước biển) gộp thành 1 (có thể thành 1 trong 3 màu nên trên tùy theo vị trí).

- Với SAMSUNG là độ phân giải có 12mpx, mỗi điểm ảnh kích thước 1,6 nhưng có thể chia 1 điểm ảnh (ví dụ màu xanh lá) thành 4. (vẫn là màu xanh lá). nên về bản chất samsung chỉ là resize lại cái ảnh từ 12mpx lên 48mpx. chả có tác dụng gì ngoài marketing.

Nó nhận tín hiệu vào 4 điểm cảm biến xử lý ngay cấp phần cứng cho ra 1 điểm ảnh thì cpu tầm trung chỉ tiếp nhận 12mpx để xử lý mới mượt, chứ đòi 660 xử lý 48mpx ảnh thì coi như tự đeo tạ vào chân đeo gông vào cổ rồi.

Cách gộp nhiều điểm thành 1 để tăng cường chất lượng này có nhiều hướng tiếp cận, nếu cpu mạnh thì nó sẽ cho 48b triệu cảm biến tiếp nhận 48tr điểm ảnh độc lập rồi đưa cpu mày tự bóp lại thành 12mpx để xài hay giữ vậy tùy ý. Còn chip tầm trung thì nó chấp nhận chỉ có đầu ra cuối là 12mpx nhưng là kết quả tiếp nhận của 48tr điểm cảm biến được "bóp" ngay từ gốc.

Và mấy nay nếu xem review liên quan vụ này để ý sẽ thấy thao tác trích xuất 48mpx thô đều đi kèm với trải nghiệm là bị chậm và chỉ bật được bên mode pro, còn dùng thông thường theo đúng mục đích thiết kế thì nhanh bình thường. Cái cảm biến này mục đích ko phải dùng để cho ra ảnh 48mpx là như vậy.

- với samsung là khi ảnh lên 48mpx thì block 4x4 (16 điểm ảnh) vẫn chỉ tính được là xếp theo 1 bayer. vì có 2 điểm ảnh cạnh nhau thu nhận màu giống nhau, nên thực tế chỉ là 1 block bayer (nhưng kích thước to).

- với sony là khi ảnh lên 48mpx thì block 4x4 (16 điểm ảnh) sẽ được tính thành 4 bayer (sony gọi là quadbayer) vì không có 2 điểm ảnh cạnh nhau nào thu nhận màu giống nhau nên tạo thành 4 block bayer (kích thước nhỏ)

cách làm của sony thì chính xác mới là cách làm tăng chi tiết của ảnh lên, còn samsung thì không (độ chi tiết của ảnh được phân biệt bằng màu sắc và tương phản giữa 2 điểm ảnh cạnh nhau)

1895769.jpg

Bài mới

- Chịu trách nhiệm nội dung: Trần Mạnh Hiệp

- © 2024 Công ty Cổ phần MXH Tinh Tế

- Địa chỉ: Số 70 Bà Huyện Thanh Quan, P. Võ Thị Sáu, Quận 3, TPHCM

- Số điện thoại: 02822460095

- MST: 0313255119

- Giấy phép thiết lập MXH số 11/GP-BTTTT, Ký ngày: 08/01/2019