NVIDIA đã đầu tư và cung cấp các công cụ, giải pháp cũng như công nghệ cho mảng AI doanh nghiệp từ lâu, điển hình là phục vụ cho mô hình ngôn ngữ lớn. Không phải từ khi ChatGPT trở thành 1 hiện tượng thì người ta mới bắt đầu chú ý, mà Large Language Model đã xuất hiện từ khoảng 2018, ứng dụng cho nhiều nhiệm vụ khác nhau. AI có thể bao hàm nhiều lĩnh vực rộng lớn, nhưng trong đó mô hình ngôn ngữ lớn là thứ đứng đằng sau nhiều ứng dụng đang rất phổ biến hiện nay.

Large Language Model (LLM) hay mô hình ngôn ngữ lớn là 1 hệ thống trí tuệ nhân tạo (AI) đã được đào tạo với lượng lớn dữ liệu văn bản, sử dụng thuật toán học máy (machine learning), để tạo ra các phản hồi giống như con người đối với các dữ liệu đầu vào bằng văn bản. LLM là 1 trong những ứng dụng thành công nhất của mô hình transformer, có thể nhận dạng, tóm tắt, dịch, dự đoán và tạo văn bản cũng như nội dung khác dựa trên kiến thức thu được từ bộ dữ liệu khổng lồ đã huấn luyện.

LLM gồm 1 mạng thần kinh (neural network) có nhiều tham số (thường là hàng tỉ trở lên), được đào tạo trên số lượng lớn văn bản chưa được gắn nhãn bằng cách sử dụng phương pháp học tự giám sát (self-supervised) hoặc học bán giám sát (semi-supervised). LLM xuất hiện vào khoảng năm 2018 và hoạt động tốt ở nhiều nhiệm vụ khác nhau. Chúng là những mô hình học máy sử dụng các thuật toán học sâu để xử lý và hiểu ngôn ngữ. LLM đã được sử dụng trong rất nhiều ứng dụng như xử lý ngôn ngữ tự nhiên, dịch máy, trả lời câu hỏi, phân loại văn bản và tạo văn bản. Chúng cũng đã được sử dụng để tạo văn bản thực tế cho chatbot và trợ lý ảo. Theo xu thế hiện tại, các doanh nghiệp dần muốn sở hữu 1 chatbot hay trợ lý ảo để phục vụ cho công việc kinh doanh cũng như hỗ trợ khách hàng.

Mô hình ngôn ngữ lớn - Large Language Model (LLM) là gì?

Large Language Model (LLM) hay mô hình ngôn ngữ lớn là 1 hệ thống trí tuệ nhân tạo (AI) đã được đào tạo với lượng lớn dữ liệu văn bản, sử dụng thuật toán học máy (machine learning), để tạo ra các phản hồi giống như con người đối với các dữ liệu đầu vào bằng văn bản. LLM là 1 trong những ứng dụng thành công nhất của mô hình transformer, có thể nhận dạng, tóm tắt, dịch, dự đoán và tạo văn bản cũng như nội dung khác dựa trên kiến thức thu được từ bộ dữ liệu khổng lồ đã huấn luyện.

LLM gồm 1 mạng thần kinh (neural network) có nhiều tham số (thường là hàng tỉ trở lên), được đào tạo trên số lượng lớn văn bản chưa được gắn nhãn bằng cách sử dụng phương pháp học tự giám sát (self-supervised) hoặc học bán giám sát (semi-supervised). LLM xuất hiện vào khoảng năm 2018 và hoạt động tốt ở nhiều nhiệm vụ khác nhau. Chúng là những mô hình học máy sử dụng các thuật toán học sâu để xử lý và hiểu ngôn ngữ. LLM đã được sử dụng trong rất nhiều ứng dụng như xử lý ngôn ngữ tự nhiên, dịch máy, trả lời câu hỏi, phân loại văn bản và tạo văn bản. Chúng cũng đã được sử dụng để tạo văn bản thực tế cho chatbot và trợ lý ảo. Theo xu thế hiện tại, các doanh nghiệp dần muốn sở hữu 1 chatbot hay trợ lý ảo để phục vụ cho công việc kinh doanh cũng như hỗ trợ khách hàng.

Ứng dụng của mô hình ngôn ngữ lớn trong doanh nghiệp

Nhờ khả năng tìm kiếm, xử lý ngôn ngữ tự nhiên mà LLM có thể hỗ trợ rất đắc lực cho doanh nghiệp trong thời đại kỹ thuật số. ChatGPT hay Bing AI cũng là các ví dụ ứng dụng của mô hình ngôn ngữ lớn, tuy nhiên vẫn còn đó những ngôn ngữ có lượng dữ liệu quá nhỏ (tiếng Việt, tiếng Thái...) chưa đủ để đào tạo mô hình có chất lượng tốt. Các ứng dụng của LLM có thể kể đến như chatbot tự động, trợ lý ảo cho nhà bán lẻ hay cung cấp dịch vụ, nâng cao trải nghiệm khách hàng. Những công cụ tìm kiếm có thể sử dụng LLM để tìm và đưa ra câu trả lời gần giống con người, tạo sự thoải mái khi giao tiếp. Lĩnh vực khoa học có thể đào tạo LLM để tìm hiểu về phân tử, nguyên tử, DNA và RNA; trong khi nhà phát triển dễ dàng viết phần mềm hay huấn luyện hành động vật lý cho robot bằng cách ứng dụng LLM.

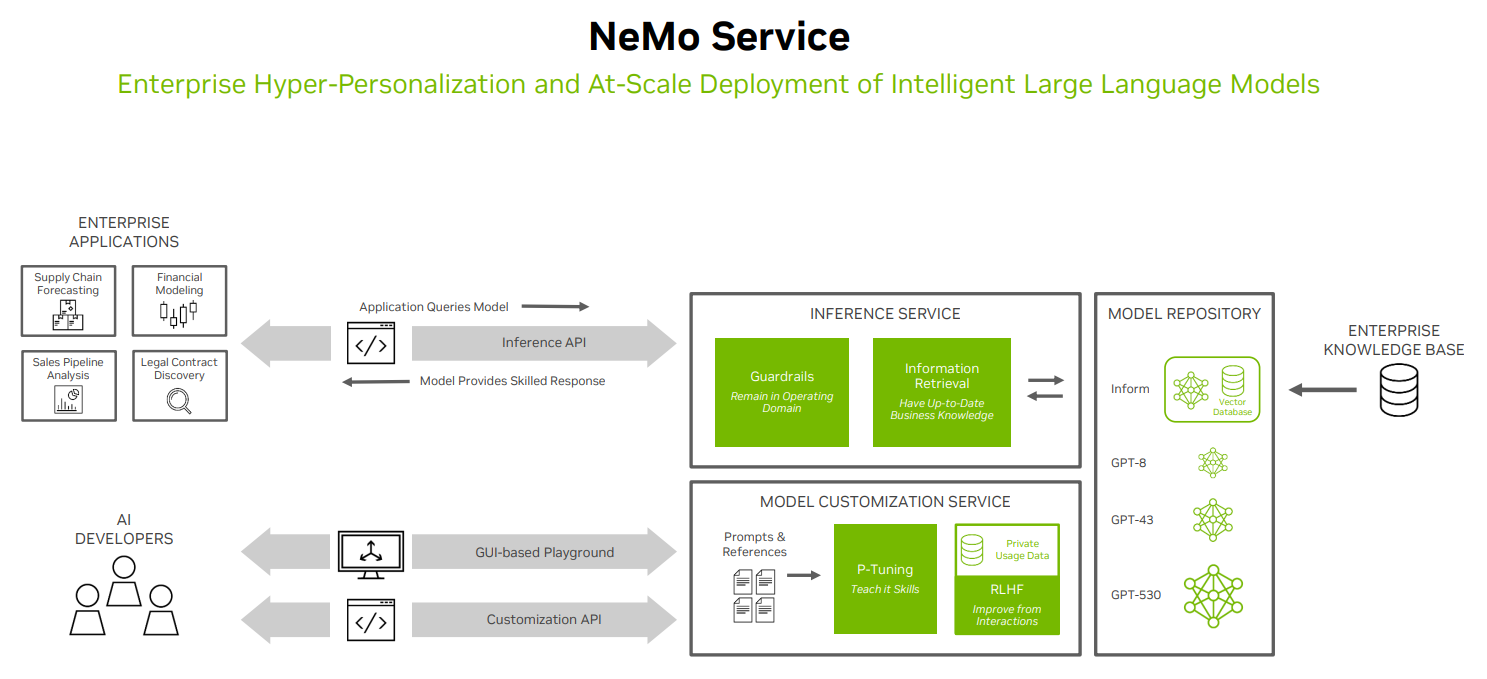

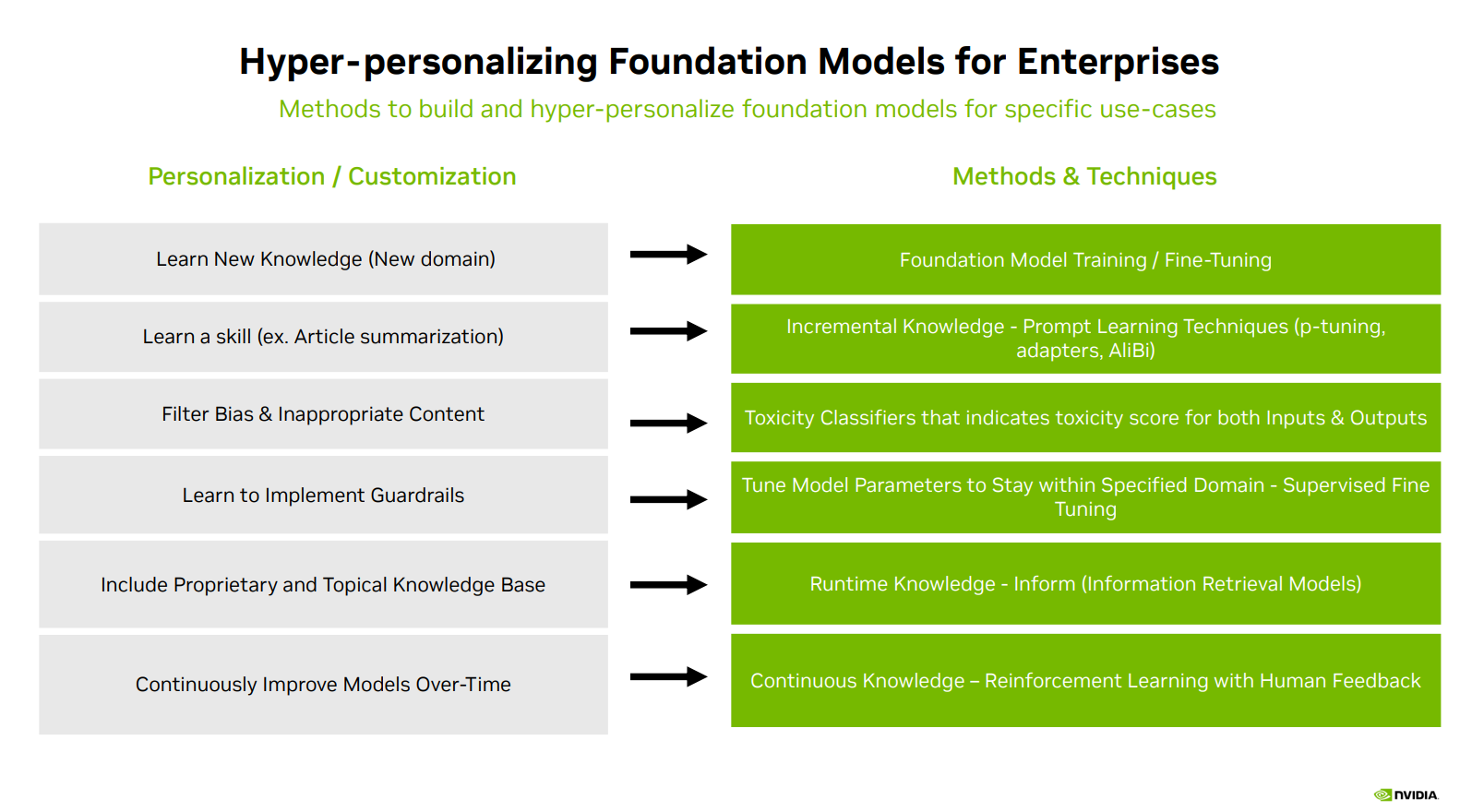

Từ phía NVIDIA, công ty cung cấp nhiều công cụ để xây dựng và triển khai các LLM như NeMo LLM (dễ dàng tùy chỉnh và triển khai theo quy mô yêu cầu, sử dụng API đám mây được quản lý bởi NVIDIA hay dịch vụ đối tác), NeMo Megatron (framework giúp đào tạo và triển khai LLM hiệu quả, tiết kiệm chi phí, có thể xử lý dữ liệu phân tán tự động, đào tạo mô hình tùy chỉnh quy mô lớn) hay BioNeMo (dịch vụ và framework phục vụ trong nghiên cứu protein, phân tử, DNA và RNA, xây dựng dựa trên NeMo Megatron cho đào tạo và triển khai các mô hình AI transformer sinh học phân tử cỡ lớn ở quy mô siêu máy tính).

NVIDIA NeMo

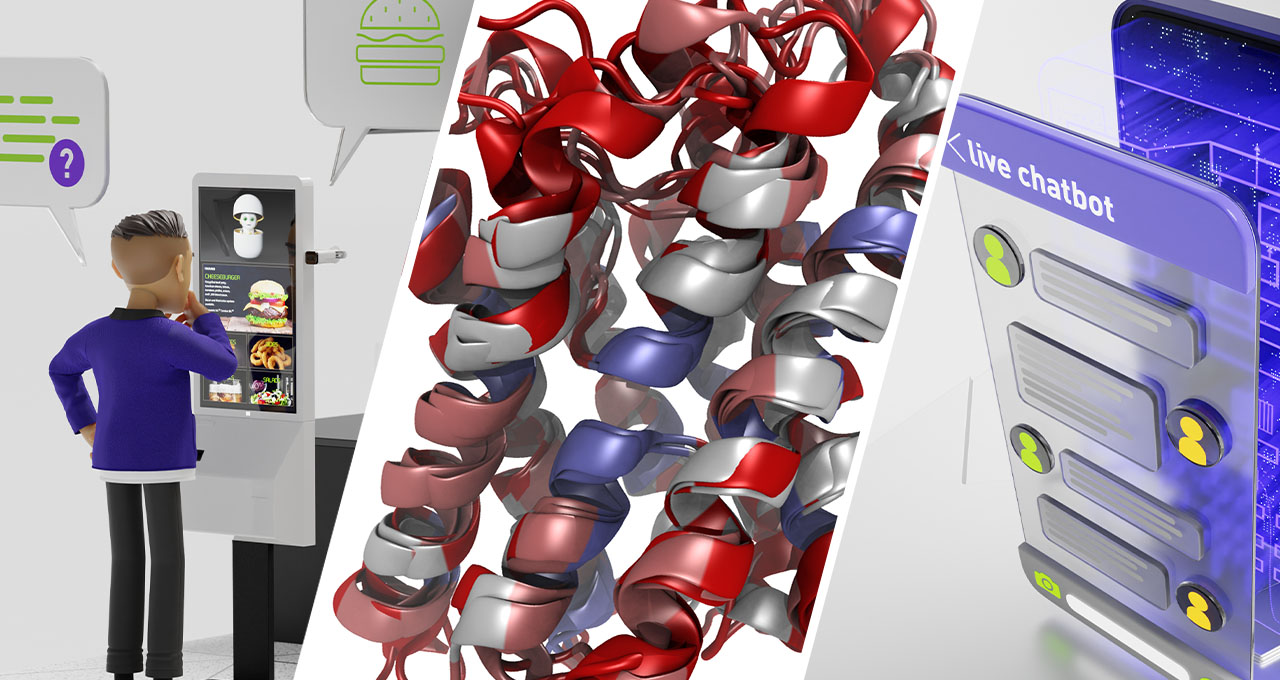

NVIDIA NeMo là framework (khung chương trình viết sẵn) doanh nghiệp trên nền tảng đám mây toàn diện dành cho các nhà phát triển phần mềm để xây dựng, tùy chỉnh và triển khai các mô hình AI tổng quát (Generative AI) với hàng tỉ tham số. NeMo là bộ công cụ AI đàm thoại (Conversational AI) được xây dựng cho các nhà nghiên cứu làm việc về nhận dạng giọng nói tự động (Automatic Speech Recognition - ASR), tổng hợp văn bản thành giọng nói (Text-To-Speech synthesis - TTS), mô hình ngôn ngữ lớn (Large Language Model - LLM) và xử lý ngôn ngữ tự nhiên (Natural Language Processing - NLP). Mục tiêu chính của NeMo là giúp các nhà nghiên cứu từ ngành công nghiệp và học viện sử dụng lại công việc trước đó (các đoạn mã và mô hình) để đẩy nhanh quá trình nghiên cứu.

NeMo framework cung cấp quy trình làm việc tăng tốc để đào tạo với các kỹ thuật xử lý song song 3D (3D Parallelism Technique), lựa chọn của rất nhiều kỹ thuật tùy chỉnh, tối ưu suy luận của các mô hình quy mô lớn cho các ứng dụng ngôn ngữ và hình ảnh, với cấu hình đa GPU và đa node. NeMo là bộ công cụ giúp xây dựng các mô hình AI đàm thoại tiên tiến nhất hiện nay. NeMo có nhiều bộ mô hình cho ASR, NLP và TTS, mỗi bộ này bao gồm các module dựng sẵn chứa mọi thứ cần thiết để huấn luyện dữ liệu của doanh nghiệp. Với NeMo, việc phát triển mô hình AI tổng quát trở nên dễ dàng, tiết kiệm chi phí và nhanh chóng hơn.

Quảng cáo

NeMo framework mang lại hiệu quả đào tạo ở mức hiệu quả cao, giúp đào tạo các mô hình nền tảng quy mô lớn, sử dụng các kỹ thuật song song 3D như: Tensor parallelism (mở rộng tỉ lệ mô hình trong node), data and pipeline parallelism (mở rộng quy mô dữ liệu và mô hình trên hàng nghìn GPU) và sequence parallelism (phân phối bộ nhớ kích hoạt trên các thiết bị tensor parallel). Tất cả các mô hình NeMo đều được đào tạo bằng Lightning và quá trình đào tạo có thể tự động mở rộng tới 1000 GPU. Ngoài ra, các mô hình NeMo Megatron LLM có thể được đào tạo tới 1 nghìn tỉ tham số bằng cách sử dụng tensor và data and pipeline parallelism. Mô hình NeMo có thể được tối ưu hóa để suy luận và triển khai cho các trường hợp sử dụng sản xuất với NVIDIA Riva.

NVIDIA Riva và LaunchPad

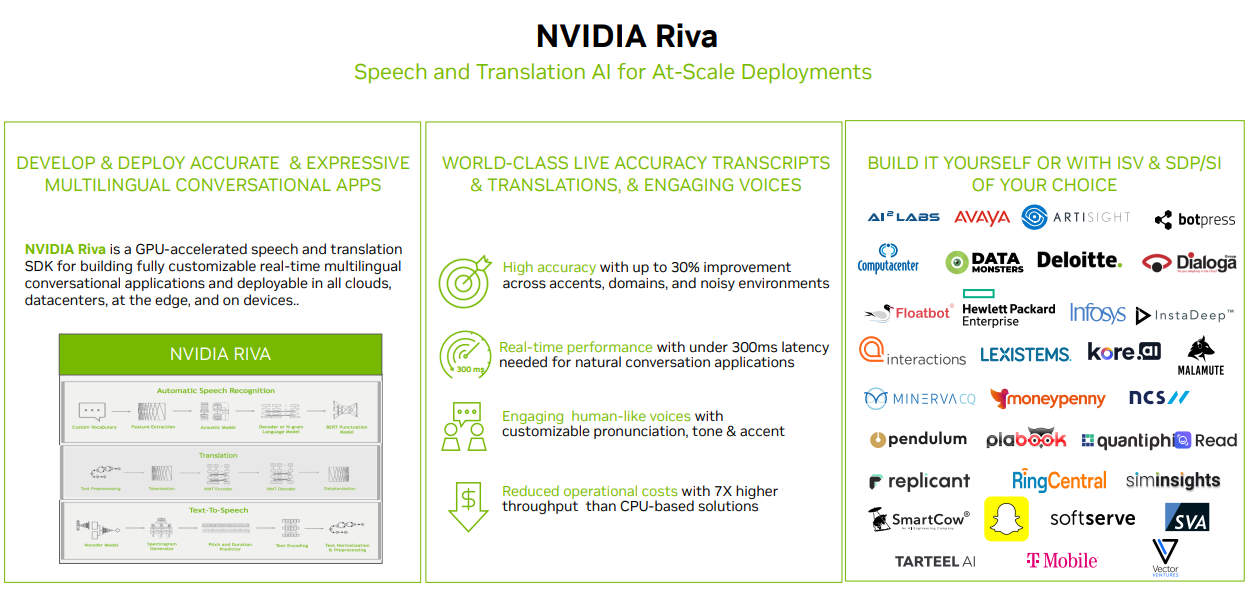

NVIDIA Riva là SDK (bộ công cụ phát triển phần mềm) tăng tốc bởi GPU để xây dựng các ứng dụng Speech AI được tùy chỉnh cho từng trường hợp sử dụng, đồng thời mang lại hiệu suất thời gian thực. NVIDIA Riva cung cấp cho nhà phát triển các công cụ để tạo ra những dịch vụ AI đàm thoại có thể hiểu ngôn ngữ tự nhiên, rồi tiếp tục tạo phản hồi giống như người trong thời gian thực. NVIDIA Riva có thể được sử dụng trong nhiều ứng dụng khác nhau như nhận dạng giọng nói, xử lý ngôn ngữ tự nhiên, tổng hợp văn bản thành giọng nói.

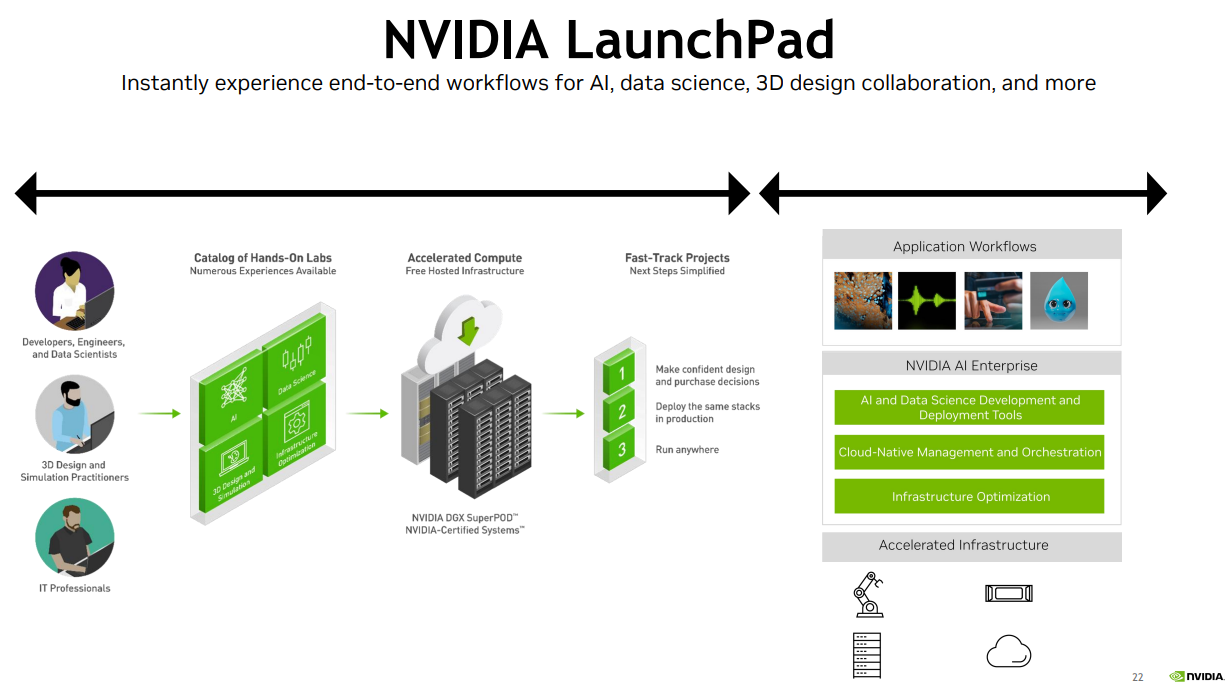

NVIDIA LaunchPad cung cấp quyền truy cập miễn phí vào phần cứng và phần mềm NVIDIA dành cho doanh nghiệp thông qua trình duyệt Internet. Khách hàng có thể trải nghiệm sức mạnh của AI với các giải pháp đầu cuối thông qua phòng thí nghiệm thực hành có hướng dẫn hoặc sử dụng NVIDIA-Certified Systems như là sandbox. Với AI LaunchPad, các đối tác của NVIDIA bao gồm Equinix cung cấp môi trường đám mây lai hỗ trợ đào tạo và suy luận AI, triển khai ở vùng biên và các khía cạnh khác của khoa học dữ liệu. LaunchPad có NVIDIA-Certified Systems và hệ thống NVIDIA DGX, chạy toàn bộ NVIDIA AI Software Stack.

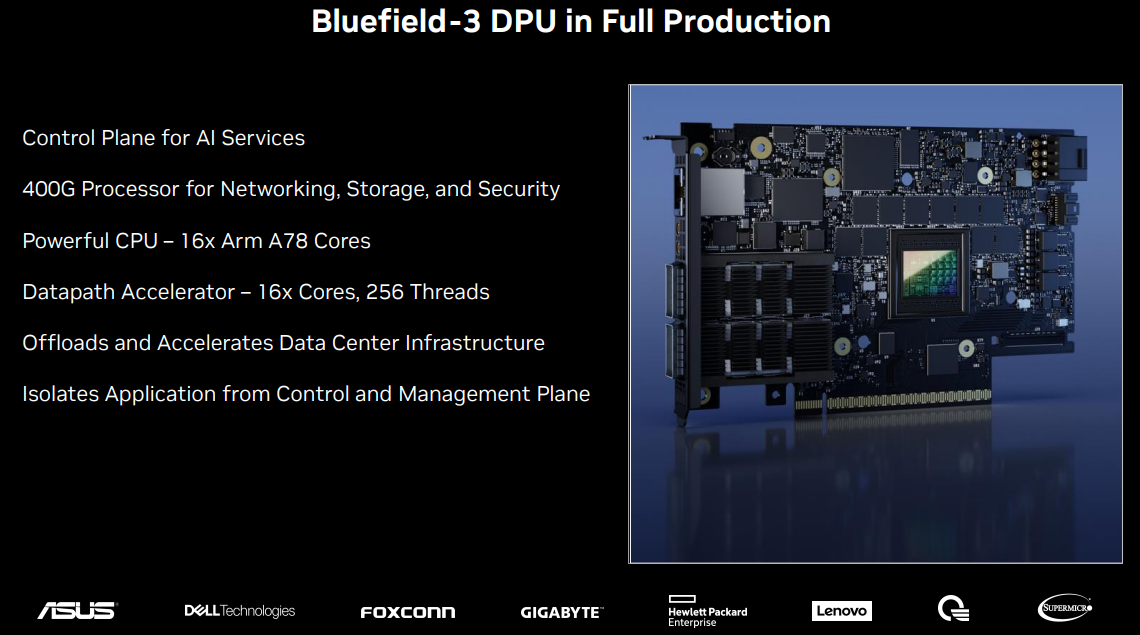

NVIDIA BlueField-3

Quảng cáo

NVIDIA BlueField là 1 dòng sản phẩm DPU (Data Processing Unit) do NVIDIA thiết kế và sản xuất. Ban đầu BlueField được Mellanox Technologies phát triển, sau đó đã thuộc về NVIDIA khi hãng này mua lại vào tháng 3/2019 với giá 6.9 tỉ USD. DPU hay đơn vị xử lý dữ liệu, là 1 loại bộ xử lý có thể lập trình hiện đại, giúp giảm tải và tăng tốc các tác vụ kết nối mạng, lưu trữ và bảo mật từ các CPU trong trung tâm dữ liệu.

NVIDIA BlueField-3 DPU là nền tảng hạ tầng điện toán có tốc độ 400 Gbps với khả năng xử lý ở tốc độ đường truyền mạng, lưu trữ và an ninh mạng do phần mềm xác định. BlueField-3 kết hợp khả năng tính toán mạnh mẽ, kết nối mạng tốc độ cao và khả năng lập trình mở rộng để cung cấp các giải pháp tăng tốc phần cứng, do phần mềm xác định cho những khối lượng công việc đòi hỏi khắt khe nhất.

DPU NVIDIA BlueField-3 chuyển đổi cơ sở hạ tầng truyền thống thành môi trường “zero-trust”- trong đó mọi người dùng trung tâm dữ liệu đều được xác thực - bằng cách giảm tải và cách ly cơ sở hạ tầng trung tâm dữ liệu khỏi các ứng dụng kinh doanh. Điều này bảo vệ doanh nghiệp từ đám mây đến phần nhân và vùng biên, đồng thời tăng hiệu quả và hiệu suất. BlueField-3 là nền tảng control plane của trung tâm dữ liệu cung cấp dịch vụ đám mây và AI. Các thử nghiệm cho thấy mức giảm điện năng lên tới 24% trên các máy chủ sử dụng DPU NVIDIA BlueField so với các máy chủ không có DPU.

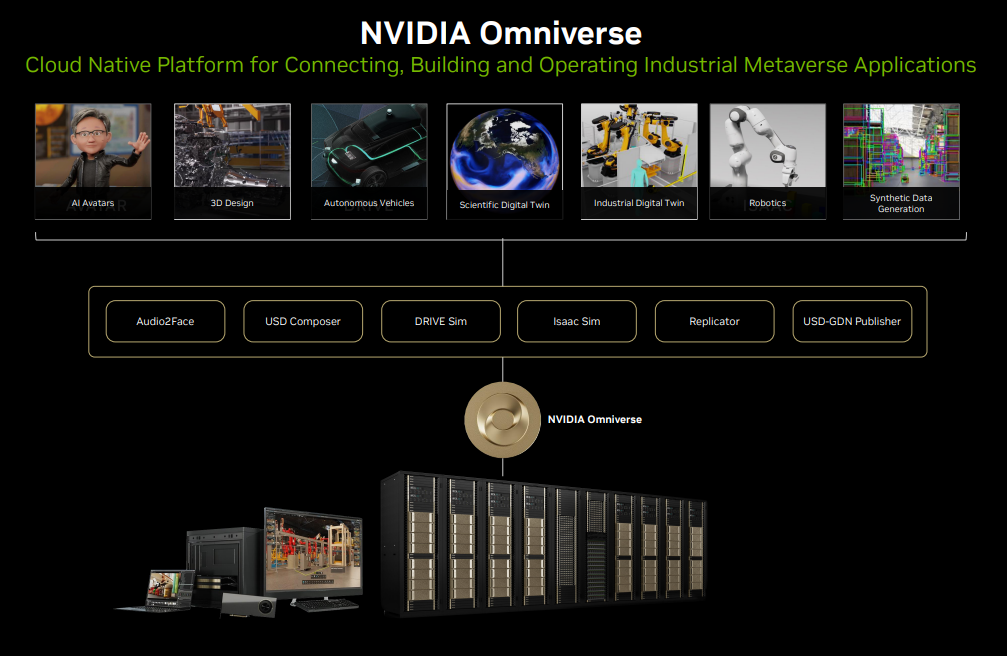

NVIDIA Omniverse

NVIDIA Omniverse là nền tảng phát triển thời gian thực đa GPU, có thể mở rộng để xây dựng và vận hành các ứng dụng metaverse. Omniverse Cloud là nền tảng dưới dạng dịch vụ cung cấp cho doanh nghiệp môi trường đám mây đầy đủ để thiết kế, phát triển, triển khai và quản lý các ứng dụng metaverse công nghiệp. Trong khi đó, NVIDIA Omniverse Enterprise là nền tảng đơn giản để triển khai, cộng tác đầu cuối và mô phỏng chân thực giúp chuyển đổi cơ bản các quy trình thiết kế phức tạp cho các tổ chức thuộc mọi quy mô. Đây là sản phẩm thương mại dành cho các nhóm và tổ chức xây dựng thế giới ảo và đường dẫn nội dung 3D. Omniverse Enterprise cung cấp khả năng mở rộng quy mô, bảo mật và Hỗ trợ kỹ thuật dành cho doanh nghiệp.

NVIDIA Omniverse dựa trên USD (Universal Scene Description) của Pixar, là framework và hệ sinh thái mở, có thể mở rộng để mô tả, sáng tác, mô phỏng và cộng tác trong thế giới 3D, ban đầu được phát triển bởi Pixar Animation Studios. USD không chỉ là một định dạng tập tin (file format), mà là 1 mô tả cảnh 3D nguồn mở (open source 3D scene description) được sử dụng để tạo và trao đổi nội dung 3D giữa các công cụ khác nhau. Nền tảng phần mềm USD có thể mở rộng hiệu suất cao để cộng tác xây dựng các cảnh 3D hoạt hình, được thiết kế để đáp ứng nhu cầu sản xuất hiệu ứng hình ảnh và phim quy mô lớn.

Ngoài USD của Pixar, NVIDIA Omniverse còn ứng dụng công nghệ RTX. NVIDIA RTX (Ray Tracing Texel eXtreme) là nền tảng điện toán hình ảnh chuyên nghiệp do NVIDIA tạo ra, chủ yếu được sử dụng trong các máy trạm để thiết kế các mô hình quy mô lớn phức tạp, sử dụng cho kiến trúc và thiết kế sản phẩm, trực quan hóa khoa học, thăm dò năng lượng cũng như sản xuất phim và video. Dĩ nhiên, RTX cũng xuất hiện ở các sản phẩm GPU hay card đồ họa cho game. Công nghệ NVIDIA RTX mang sức mạnh của AI vào điện toán hình ảnh, cho phép các nhà phát triển tạo ra các ứng dụng tăng cường AI, mang đến khả năng tăng tốc quy trình công việc cho người dùng cuối. RTX bao gồm công nghệ ray tracing có khả năng mở rộng cao chạy trên GPU kiến trúc NVIDIA Volta.

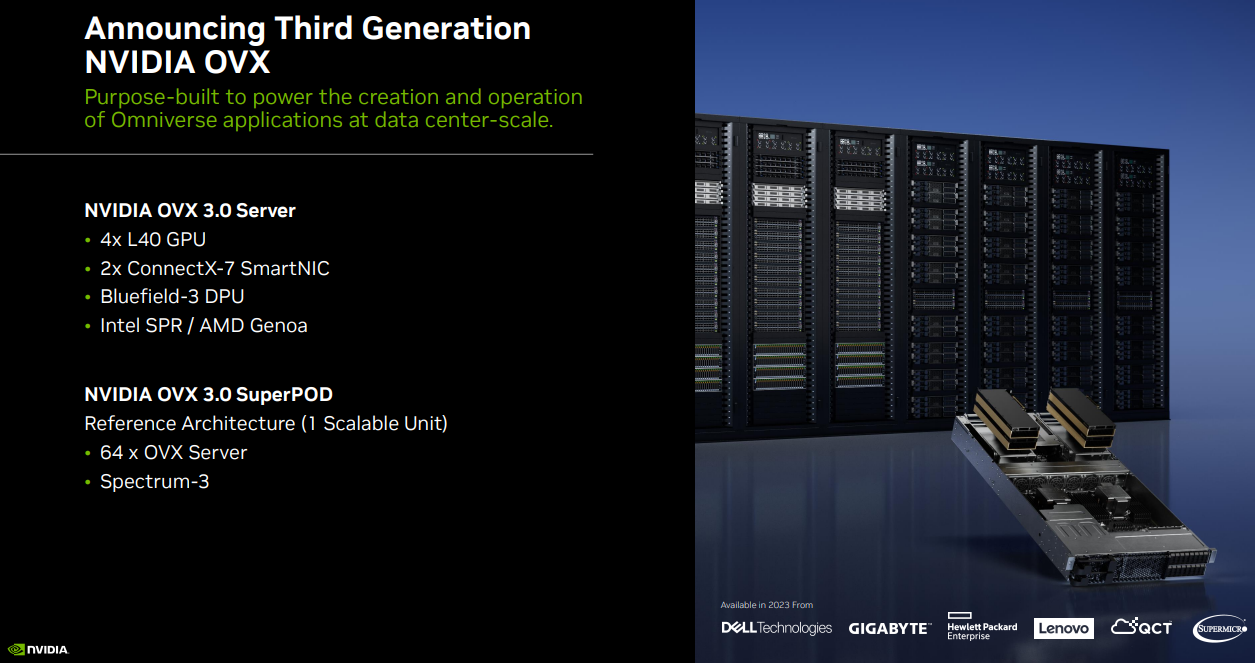

NVIDIA cũng giới thiệu các hệ thống tính toán OVX thế hệ 3, được thiết kế để sử dụng trong các mô phỏng quy mô lớn của cặp song sinh kỹ thuật số. Các hệ thống này dựa trên nền tảng NVIDIA Omniverse Enterprise, được sử dụng để tạo và quản lý siêu vũ trụ. Thế hệ thứ ba của OVX có kiến trúc mới, với thiết kế máy chủ dựa trên nền tảng CPU kép với bốn GPU NVIDIA L40. GPU L40 mang đến đồ họa thần kinh mang tính cách mạng, điện toán AI và hiệu suất cần thiết cho khối lượng công việc Omniverse đòi hỏi khắt khe nhất.

Digital Twin hay song sinh/nhân bản kỹ thuật số là đại diện kỹ thuật số của 1 sản phẩm, hệ thống hoặc quy trình vật lý trong thế giới thực hoặc dự định thực tế (song sinh vật lý - physical twin) đóng vai trò là đối tác kỹ thuật số không thể phân biệt hiệu quả của nó cho các mục đích thực tế, chẳng hạn như mô phỏng, tích hợp, thử nghiệm, giám sát và bảo trì. Đối tượng đang được nghiên cứu được trang bị nhiều cảm biến liên quan đến các lĩnh vực chức năng quan trọng. Các cảm biến này tạo ra dữ liệu về các khía cạnh khác nhau trong hoạt động của đối tượng vật lý, chẳng hạn như sản lượng năng lượng, nhiệt độ. Một ví dụ là doanh nghiệp có thể tạo 1 bản sao kỹ thuật số của nhà máy, từ đó thay đổi, thử nghiệm hay làm bất cứ việc gì với bản sao đó, AI sẽ mô phỏng kết quả, để rồi từ từ tìm ra được giải pháp tối ưu cho 1 vấn đề cụ thể. Nhờ digital twin mà doanh nghiệp tiết kiệm được chi phí rất nhiều khi hạn chế quy trình thử - sai thực tế, tất cả sẽ được giả lập, mô phỏng trong omniverse.