Nvidia lấy tên mã Blackwell cho thế hệ GPU mới nhất hiện giờ của họ, với sản phẩm mạnh nhất là B200 chuẩn bị ra mắt cho những data center vận hành chatbot AI, để tri ân nhà toán học và thống kê học người Mỹ, David Blackwell (1919 - 2010), người đã có những đóng góp đáng kể cho việc phát triển lý thuyết trò chơi, lý thuyết xác suất, thống kê và lý thuyết thông tin. Dự kiến cuối năm nay, đầu năm sau, những sản phẩm tiêu dùng, card đồ họa chơi game kiến trúc Blackwell sẽ chính thức ra mắt, RTX 5080 và 5090 chẳng hạn.

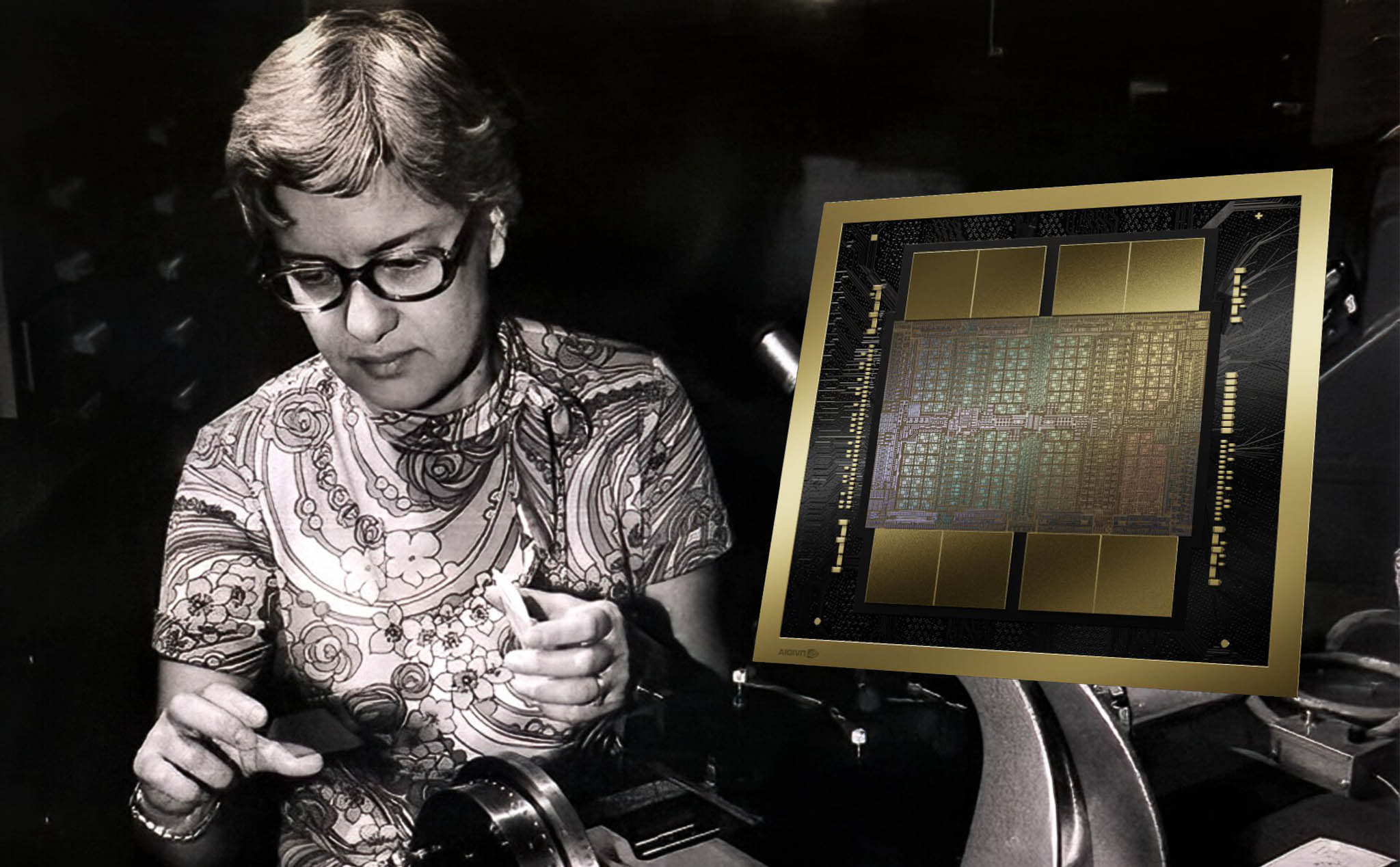

Cùng lúc, theo những nguồn tin không chính thức, Nvidia đang phát triển kiến trúc GPU kế tiếp phục vụ cả nhu cầu máy chủ lẫn tiêu dùng, tên mã Rubin. Tên mã này được Nvidia lấy để tri ân nhà thiên văn học người Mỹ, bà Vera Rubin (1928 - 2016). Những nghiên cứu của bà Rubin ở thập niên 1970 và 1980 chính là tiền đề chứng minh cho lý thuyết tồn tại của vật chất tối, cùng với đó là những nghiên cứu về chuyển động của cả thiên hà, chứng minh cho lý thuyết hợp nhất thiên hà.

Quay trở lại với kiến trúc Nvidia Rubin. Theo nhà phân tích thị trường nổi tiếng Ming Chi Kuo, hiện tại Nvidia đang hoàn tất thiết kế và thông số kỹ thuật của GPU R100. Dự kiến đến cuối năm 2025, R100 sẽ đi vào sản xuất hàng loạt dựa trên tiến trình N3 của TSMC, cũng ứng dụng công nghệ đóng gói chip bán dẫn cao cấp nhất hiện tại của TSMC là CoWoS để đặt die silicon lên lớp nền interposer, tạo ra một con chip kích thước lớn hơn cả giới hạn gia công của những cỗ máy quang khắc EUV hiện tại.

Rồi khoảng 2 năm kể từ khi Blackwell B200 được giới thiệu, tại sự kiện GTC 2026, Rubin R100 sẽ được Nvidia giới thiệu tới công chúng. Khá chắc chắn rằng sau đó Rubin sẽ có những phiên bản dành cho giải pháp thương mại tiêu dùng, chẳng hạn như R103 trang bị trên RTX 6090, hay R104 trang bị trên RTX 6080 chẳng hạn.

Cùng lúc, theo những nguồn tin không chính thức, Nvidia đang phát triển kiến trúc GPU kế tiếp phục vụ cả nhu cầu máy chủ lẫn tiêu dùng, tên mã Rubin. Tên mã này được Nvidia lấy để tri ân nhà thiên văn học người Mỹ, bà Vera Rubin (1928 - 2016). Những nghiên cứu của bà Rubin ở thập niên 1970 và 1980 chính là tiền đề chứng minh cho lý thuyết tồn tại của vật chất tối, cùng với đó là những nghiên cứu về chuyển động của cả thiên hà, chứng minh cho lý thuyết hợp nhất thiên hà.

Quay trở lại với kiến trúc Nvidia Rubin. Theo nhà phân tích thị trường nổi tiếng Ming Chi Kuo, hiện tại Nvidia đang hoàn tất thiết kế và thông số kỹ thuật của GPU R100. Dự kiến đến cuối năm 2025, R100 sẽ đi vào sản xuất hàng loạt dựa trên tiến trình N3 của TSMC, cũng ứng dụng công nghệ đóng gói chip bán dẫn cao cấp nhất hiện tại của TSMC là CoWoS để đặt die silicon lên lớp nền interposer, tạo ra một con chip kích thước lớn hơn cả giới hạn gia công của những cỗ máy quang khắc EUV hiện tại.

Công nghệ làm chip TSMC CoW-SoW và sự 'điên loạn' của ngành bán dẫn

Thời kỳ những con chip to bằng móng tay, ngón tay, bàn tay... cũng gần đến lúc kết thúc. Sắp tới đây bạn sẽ thấy "con chip" to bằng cái nồi cơm, bếp điện... và ai biết được rằng liệu con chip trong tương lai có “bự” bằng cả cái bàn hay không?

…

tinhte.vn

Rồi khoảng 2 năm kể từ khi Blackwell B200 được giới thiệu, tại sự kiện GTC 2026, Rubin R100 sẽ được Nvidia giới thiệu tới công chúng. Khá chắc chắn rằng sau đó Rubin sẽ có những phiên bản dành cho giải pháp thương mại tiêu dùng, chẳng hạn như R103 trang bị trên RTX 6090, hay R104 trang bị trên RTX 6080 chẳng hạn.

Vì còn đang được Nvidia hoàn thiện thông số kỹ thuật, nên kích thước tấm nền interposer của con chip R100 vẫn chưa được xác định cụ thể. Trên bề mặt chip vẫn sẽ là 8 stack bộ nhớ HBM xếp chồng xung quanh cụm chip xử lý logic, ứng dụng công nghệ chip nhớ HBM4.

Đầu tháng 4 vừa rồi, Samsung đã xác nhận bắt đầu sản xuất thử nghiệm những chip nhớ HBM “thế hệ thứ 5” với 12 lớp chip nhớ DRAM chồng lên nhau, tạo ra băng thông bộ nhớ trên 1.5 TB/s đối với mỗi stack chip nhớ xếp chồng. Cùng lúc, Micron cũng cho biết HBM4 sẽ ứng dụng memory interface 2048-bit, gấp đôi so với interface 1024-bit hiện tại của HBM3.

Nvidia Blackwell B200: Chip AI mạnh nhất thế giới, mạnh hơn H200 từ 2.5 đến 5 lần, thiết kế chiplet

GTC 2024, sự kiện công bố những sản phẩm phần cứng và phần mềm mới của Nvidia đã khai mạc, và trung tâm của sự kiện, và được trông đợi nhất có lẽ là kiến trúc chip GPGPU (general purpose graphics processing unit) mới của Nvidia, tên mã Blackwell…

tinhte.vn

Trong tương lai gần, giới hạn tối đa của HBM4 sẽ là 16 lớp DRAM xếp chồng lên nhau, tạo ra những chip nhớ ấn tượng cả về băng thông lẫn dung lượng, mỗi stack HBM4 có thể chứa tối đa 32 đến 64GB, nhân với 8 là 256 đến 512 GB RAM chỉ cho một cụm các die xử lý logic đặt chính giữa lớp nền interposer.

Hiện tại có một vấn đề đối với những chip xử lý AI nói riêng và những data center hỗ trợ vận hành dịch vụ AI nói chung, là tiêu thụ điện năng của toàn bộ hệ thống. Nvidia, trong quá trình phát triển kiến trúc Rubin, cũng đang phải đối mặt với vấn đề này. Hiện tại GPU Blackwell B200 ở công suất tối đa có thể ngốn tới 1000W mỗi chip. Nvidia đang phát triển Rubin để vừa tiết kiệm điện, vừa có được những cải thiện hiệu năng xử lý thuật toán machine learning.

Tuy nhiên nếu nhìn vào roadmap phát triển và sản xuất thương mại chip xử lý của TSMC, thì tới cuối năm 2025, họ sẽ bắt đầu gia công chip xử lý thương mại trên tiến trình N2, cả mật độ transistor lẫn hiệu năng tiêu thụ điện đều sẽ được cải thiện. Nhưng Nvidia chọn N3, chính xác hơn là N3P, tiến trình cải tiến của TSMC phục vụ gia công những chip xử lý điện toán hiệu suất cao, có lẽ vì đến thời điểm ấy, N3P sẽ trở nên hoàn thiện, ổn định hơn về mặt chi phí gia công, và quan trọng hơn cả là đảm bảo tỉ lệ chip đạt chuẩn trên mỗi tấm wafer silicon.