Bên cạnh những con chip xử lý máy chủ EPYC, trong đó có cả những phiên bản trang bị 3D V-cache, tại sự kiện công bố sản phẩm doanh nghiệp của AMD, GPU flagship phục vụ xử lý HPC, data center nói chung và AI nói riêng, Instinct MI300X đã được giới thiệu.

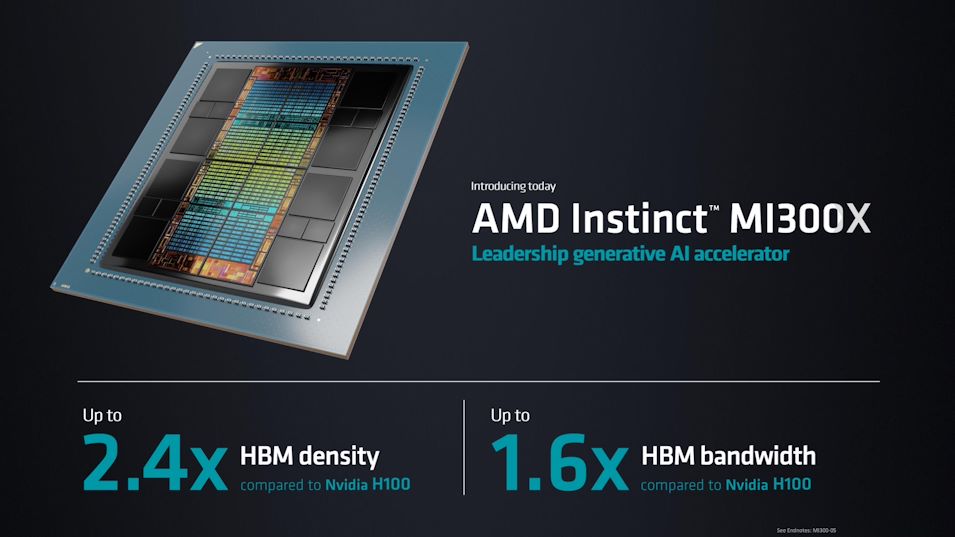

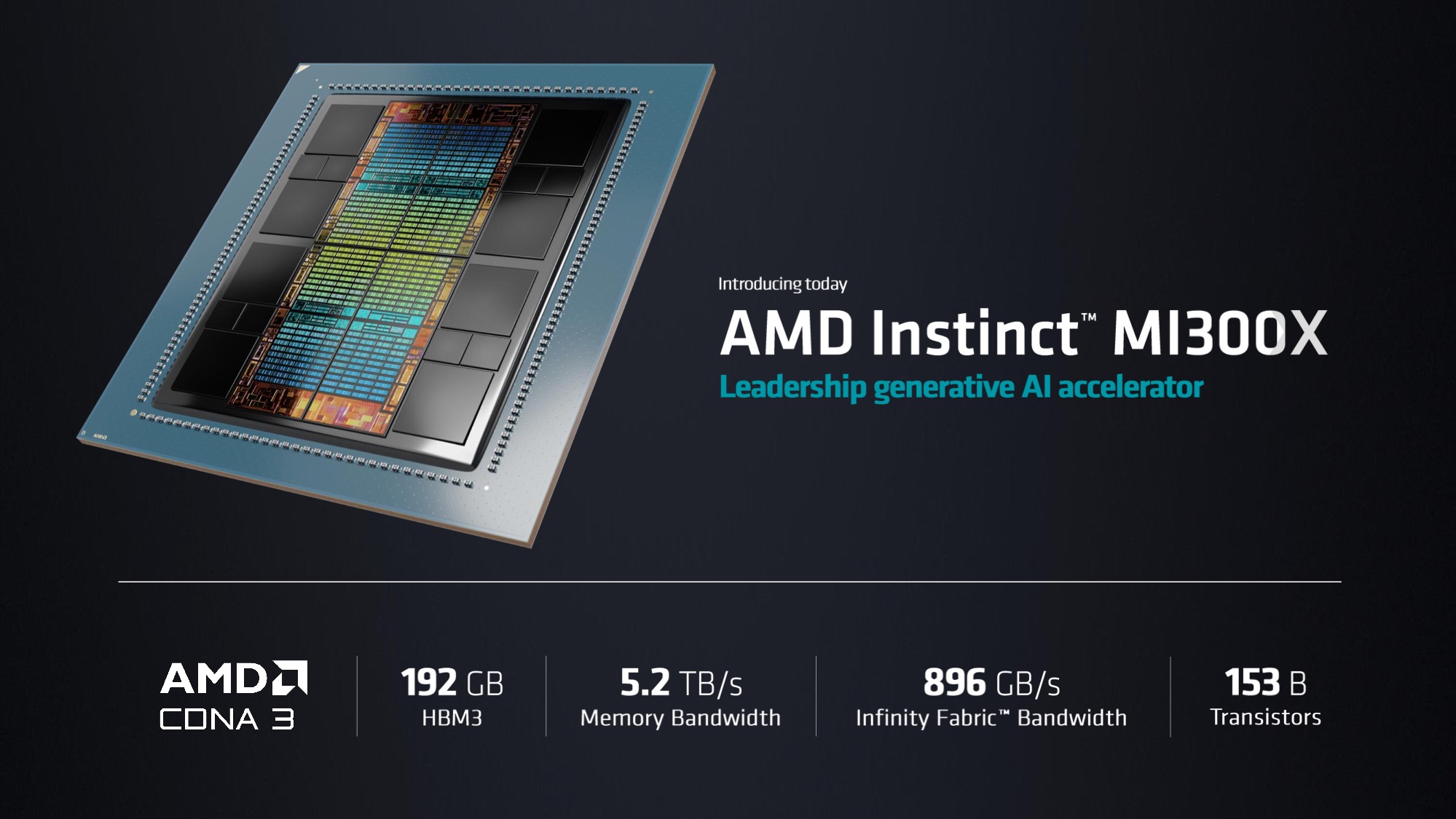

Trước đó, con chip MI300 với bộ nhớ 128GB đã được công bố, giờ đổi tên thành MI300A. Còn MI300X vừa được giới thiệu thì ứng dụng toàn bộ tile nhân xử lý GPU kiến trúc CDNA 3, thay vì kết hợp cả CPU lẫn GPU như MI300A. Trên bề mặt chip là 192GB VRAM HBM3, và GPU này được AMD tạo ra định hướng trực tiếp vào nhu cầu huấn luyện cũng như vận hành những mô hình ngôn ngữ machine learning. Bản thân bộ nhớ cực lớn cũng là lợi thế để vận hành những LLM quy mô lớn nhất ở thời điểm hiện tại.

Ngoài MI300X, thế hệ chip MI300 nói chung của AMD còn có cả những lựa chọn APU kết hợp những mảng nhân xử lý CPU Zen 4 với GPU CDNA 3, từ đó tạo ra những giải pháp chiplet phục vụ doanh nghiệp, với băng thông giữa CPU và GPU rất lớn từ cả công nghệ HBM3 lẫn Infinity Fabric. Hiện tại không có đơn vị nào ngoài AMD tạo ra giải pháp APU cùng 1 chip xử lý có cả CPU lẫn GPU. Nvidia có Grace Hopper, nhưng là hai chip độc lập trên cùng một bo mạch.

Quay trở lại với MI300X. Vì chỉ ứng dụng nhân GPU, nên thiết kế của MI300X đơn giản hơn MI300A khá nhiều. Xung quanh die chip bán dẫn là 8 stack VRAM HBM3. Ở thời điểm CES 2023 hồi đầu năm, mới chỉ có giải pháp chip RAM HBM3, nên bộ nhớ tối đa chỉ đạt 128GB trên mỗi chip. Nhưng hiện giờ đã có HBM3 24GB, cho phép tạo ra MI300X với tối đa 192GB bộ nhớ. Còn trên bề mặt die là 2 nhân CDNA 3, tổng cộng 8 chiplet GPU, 4 chiplet I/O.

Trước đó, con chip MI300 với bộ nhớ 128GB đã được công bố, giờ đổi tên thành MI300A. Còn MI300X vừa được giới thiệu thì ứng dụng toàn bộ tile nhân xử lý GPU kiến trúc CDNA 3, thay vì kết hợp cả CPU lẫn GPU như MI300A. Trên bề mặt chip là 192GB VRAM HBM3, và GPU này được AMD tạo ra định hướng trực tiếp vào nhu cầu huấn luyện cũng như vận hành những mô hình ngôn ngữ machine learning. Bản thân bộ nhớ cực lớn cũng là lợi thế để vận hành những LLM quy mô lớn nhất ở thời điểm hiện tại.

Ngoài MI300X, thế hệ chip MI300 nói chung của AMD còn có cả những lựa chọn APU kết hợp những mảng nhân xử lý CPU Zen 4 với GPU CDNA 3, từ đó tạo ra những giải pháp chiplet phục vụ doanh nghiệp, với băng thông giữa CPU và GPU rất lớn từ cả công nghệ HBM3 lẫn Infinity Fabric. Hiện tại không có đơn vị nào ngoài AMD tạo ra giải pháp APU cùng 1 chip xử lý có cả CPU lẫn GPU. Nvidia có Grace Hopper, nhưng là hai chip độc lập trên cùng một bo mạch.

Quay trở lại với MI300X. Vì chỉ ứng dụng nhân GPU, nên thiết kế của MI300X đơn giản hơn MI300A khá nhiều. Xung quanh die chip bán dẫn là 8 stack VRAM HBM3. Ở thời điểm CES 2023 hồi đầu năm, mới chỉ có giải pháp chip RAM HBM3, nên bộ nhớ tối đa chỉ đạt 128GB trên mỗi chip. Nhưng hiện giờ đã có HBM3 24GB, cho phép tạo ra MI300X với tối đa 192GB bộ nhớ. Còn trên bề mặt die là 2 nhân CDNA 3, tổng cộng 8 chiplet GPU, 4 chiplet I/O.

Giới thiệu là quý III sẽ có sample cho đối tác doanh nghiệp thử nghiệm, nên ở sự kiện công bố các giải pháp Data Center và HPC, AMD cũng chưa công bố hiệu năng xử lý của MI300X.

Cũng phải nói thêm, với sự ra mắt của MI300A và MI300X, AMD đã đạt được mục tiêu thương mại hóa những thiết kế chip XPU linh hoạt. Intel từng có ý tưởng làm như vậy với những chip xử lý phục vụ doanh nghiệp, với kiến trúc CPU và GPU Falcon Shores. Nhưng giờ Intel sẽ chỉ ra mắt GPU kiến trúc Falcon Shores mà thôi. Và MI300A và MI300X sẽ được đem ra so sánh trực tiếp với sản phẩm mạnh nhất của Nvidia hiện giờ, Grace Hopper. Giải pháp của Nvidia không tạo ra một die chip có cả nhân CPU lẫn GPU, mà là hai chip độc lập kết nối với nhau thông qua cầu nối NVLink băng thông cao.

Về cơ bản, với sức nóng hiện giờ của thị trường chip xử lý nghiên cứu và vận hành AI, mọi ánh mắt đều sẽ đổ dồn về phía AMD để phá vỡ thế độc quyền mà Nvidia đang tạm thời nắm giữ trong ngành này, với những sản phẩm trị giá hàng chục, thậm chí hàng trăm nghìn USD một con chip như H100. MI300 sẽ tạo ra cơ hội đầu tiên để AMD dấn thân vào thị trường đầy hứa hẹn và tiềm năng này.

Bên cạnh việc là “chip APU doanh nghiệp đầu tiên”, thứ rõ ràng AMD có quyền khoe khoang, thì hiện giờ thị trường đang có cơn sốt, cứ sản xuất ra chip nào là sẽ có đơn vị bỏ tiền mua về hoặc thậm chí là đặt trước. Vì thế, MI300 hứa hẹn sẽ tạo ra một khoản không hề nhỏ trong báo cáo tài chính thường niên của AMD trong năm nay.

![[IMG]](https://photo2.tinhte.vn/data/attachment-files/2023/06/6464721_Tinhte-AMD1.jpeg)

Và kết hợp những chip MI300X lại với nhau, là platform điện toán AMD Infinity Architecture Platform. Tám chip MI300X trên cùng một bo mạch, kết hợp với nhau để xử lý những LLM với yêu cầu bộ nhớ và băng thông bộ nhớ rất lớn.

Theo Anandtech

Quảng cáo