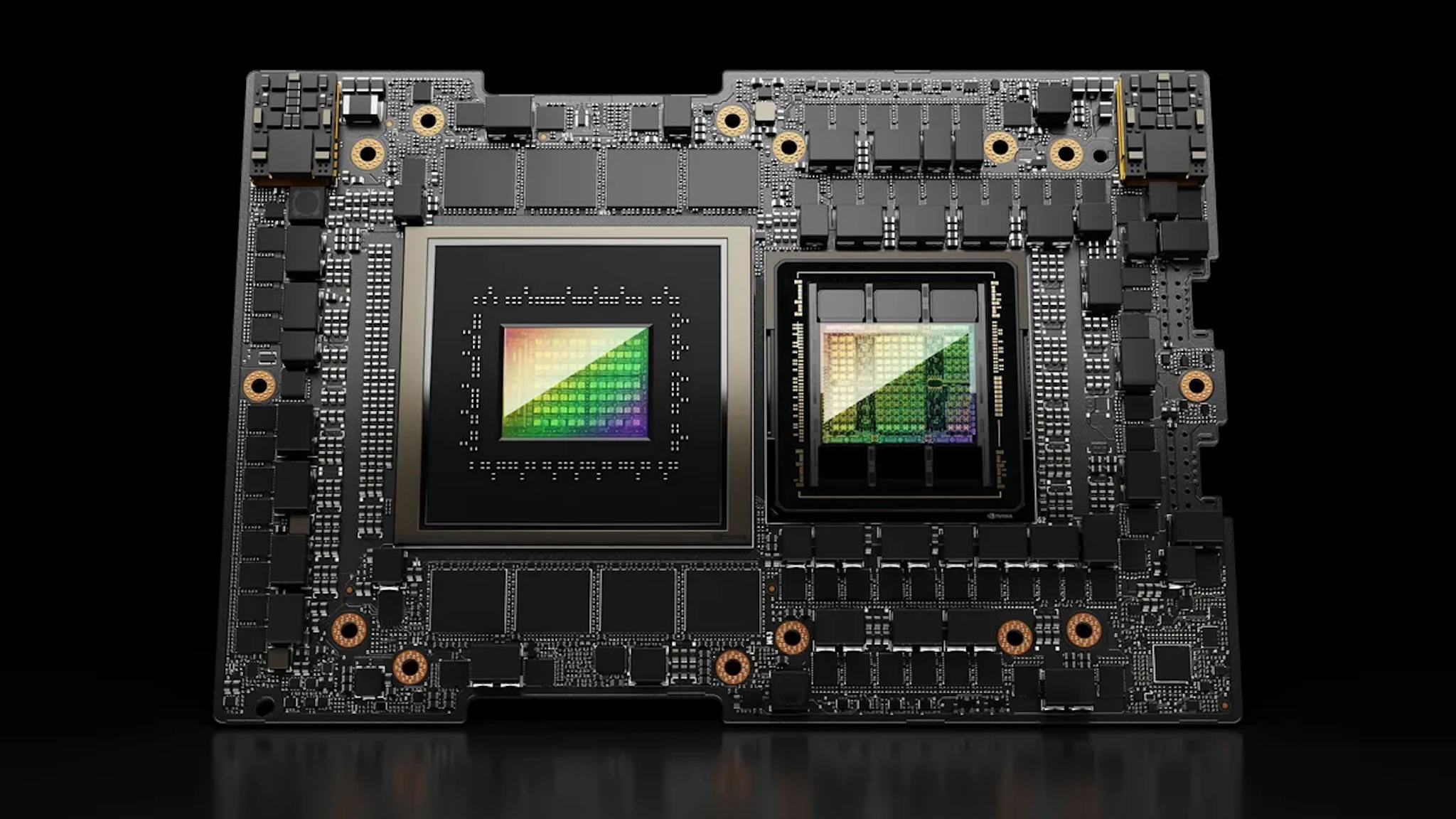

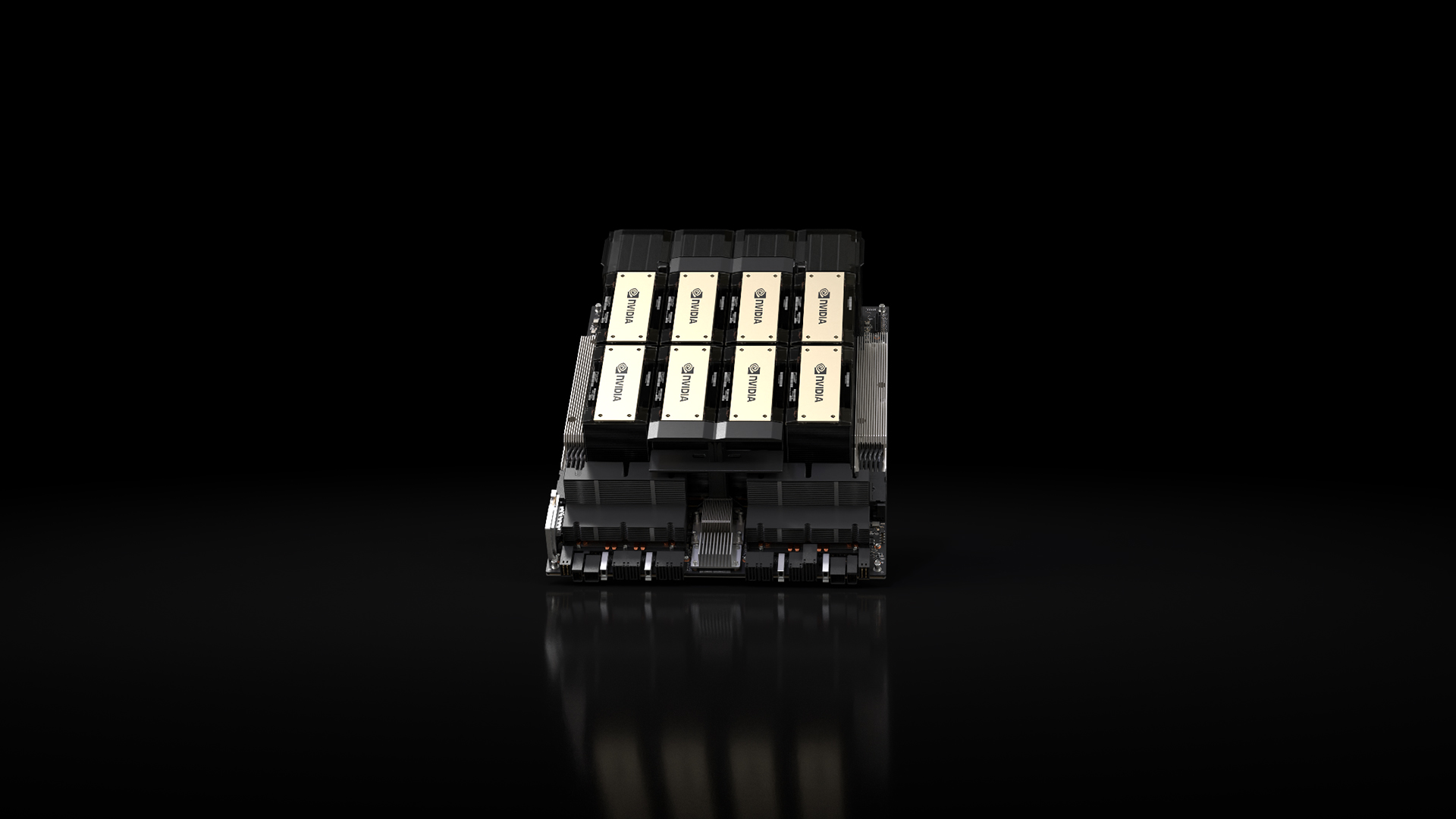

Tại sự kiện SC23 (Supercomputing 2023) mới diễn ra vào sáng nay, NVIDIA chính thức công bố GPU dựa trên kiến trúc Hopper mới là H200, chính là GPU chuyên về xử lý AI mạnh nhất mà loài người từng tạo ra. NVIDIA H200 có bộ nhớ HBM3e 141GB và băng thông bộ nhớ lên đến 4.8TB/s.

![[IMG]](https://photo2.tinhte.vn/data/attachment-files/2023/11/8184901_NVIDIA-GPU-H200.jpg.webp)

NVIDIA Hopper H200 GPU và GH200 là những con chip mạnh nhất từ trước đến nay của NVIDIA. 141GB bộ nhớ HBM3e của NVIDIA H200 chạy ở tốc độ 6.25Gbps/pin, có 6 stack và mỗi stack có dung lượng là 24GB. GPU H100 trước đây của NVIDIA chỉ có 80GB HBM3e và bằng thông khoảng 3.35TB/s.

NVIDIAcũng chỉ công bố hiệu năng xử lý FP8 (sức mạnh xử lý số thực dấu phẩy động FP8) của H200 là 32 Petaflops cho cấu hình bao gồm 8 GPU. Như vậy mỗi GPU H200 sẽ có sức mạnh xử lý khoảng 4 Petaflops, gần tương tự so với H100 trước đây.

Nvidia GH200: GPU xử lý AI mạnh nhất hành tinh

Sự kiện SIGGRAPH 2023, nơi quy tụ những đơn vị và lập trình viên trong ngành đồ họa máy tính đã bắt đầu từ ngày 6/8 vừa rồi tại Los Angeles Convention Center. Ít giờ trước, Nvidia đã có livestream giới thiệu những công nghệ và giải pháp mới phục vụ…

tinhte.vn

![[IMG]](https://photo2.tinhte.vn/data/attachment-files/2023/11/8184901_NVIDIA-GPU-H200.jpg.webp)

NVIDIA Hopper H200 GPU và GH200 là những con chip mạnh nhất từ trước đến nay của NVIDIA. 141GB bộ nhớ HBM3e của NVIDIA H200 chạy ở tốc độ 6.25Gbps/pin, có 6 stack và mỗi stack có dung lượng là 24GB. GPU H100 trước đây của NVIDIA chỉ có 80GB HBM3e và bằng thông khoảng 3.35TB/s.

NVIDIAcũng chỉ công bố hiệu năng xử lý FP8 (sức mạnh xử lý số thực dấu phẩy động FP8) của H200 là 32 Petaflops cho cấu hình bao gồm 8 GPU. Như vậy mỗi GPU H200 sẽ có sức mạnh xử lý khoảng 4 Petaflops, gần tương tự so với H100 trước đây.

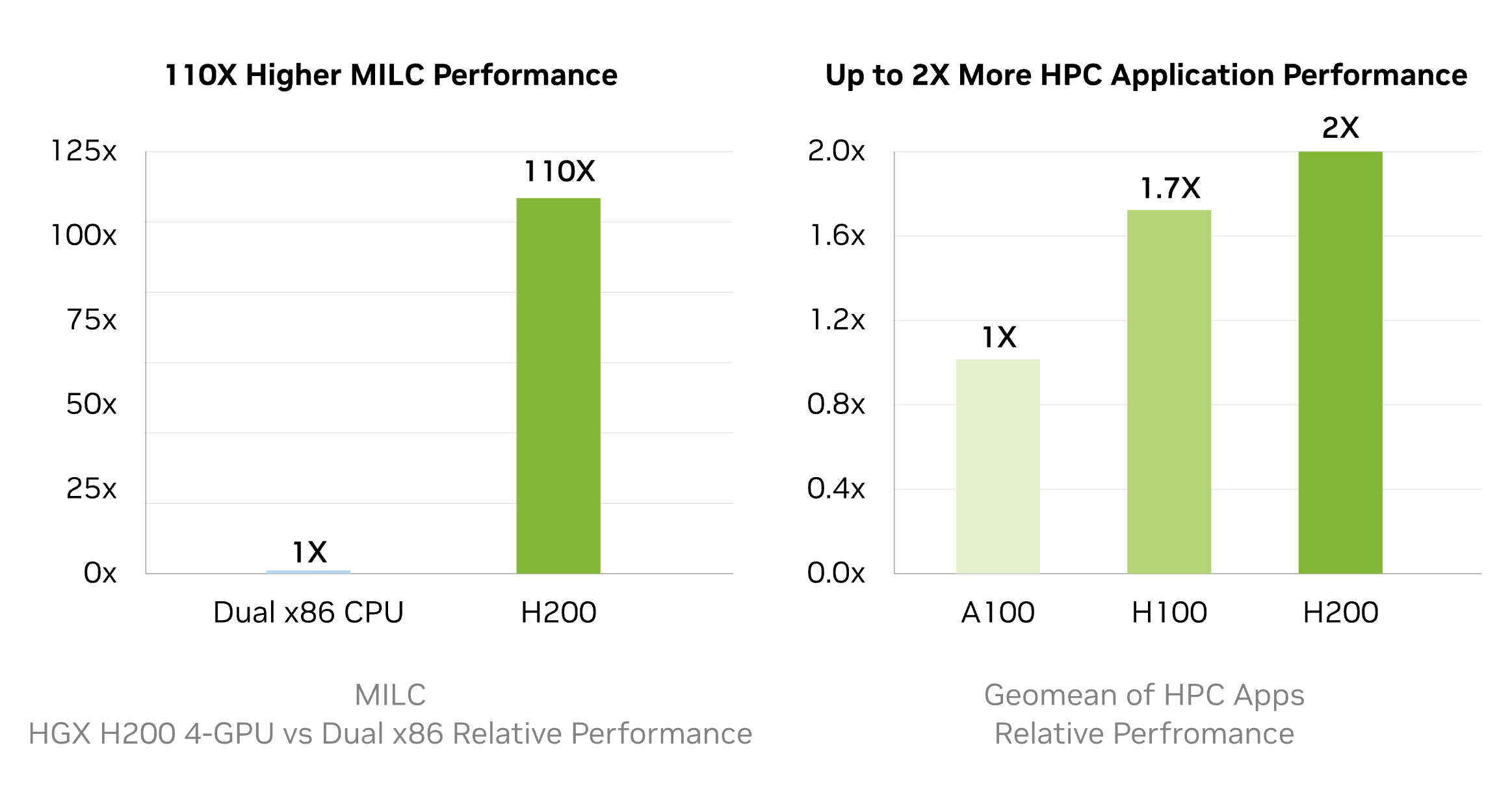

Như vậy H200 sẽ nhanh hơn như thế nào so với H100? Nó sẽ tuỳ vào nhu cầu công việc, NVIDIA có ví dụ về việc chạy các mô hình ngôn ngữ lớn (LLM) như GPT-3 hay Meta Llama2 của H200 nhanh hơn 11 lần so với H100 và nhanh hơn 18 lần so với A100, lợi thế từ việc bộ nhớ được tăng lên và băng thông cũng lớn hơn. Tuy nhiên so với B100 sử dụng kiến trúc Blackwell dự kiến ra mắt vào năm sau thì H200 vẫn còn ở một khoảng cách khá xa.

Bên cạnh giới thiệu bản nâng cấp cho GPU H100, NVIDIA cũng giới thiệu hệ thống GH200 mới, bao gồm “siêu GPU” H200 và “siêu CPU” Grace. Mỗi hệ thống “siêu chip” GH200 sẽ có tổng cộng 624GB bộ nhớ, trong đó sẽ có 480GB bộ nhớ LPDDR5x với 144GB bộ nhớ HBM3e, tăng từ 96GB HBM3 của GH100.

Điều quan trọng hơn cả là GH200 sẽ được trang bị trong các hệ thống HGX H200 và nó sẽ tương thích với hệ thống HGX H100 trước đó. Điều này có nghĩa rằng các hệ thống HGX H200 có thể sử dụng trong cùng một cơ sở hạ tầng của các hệ thống HGX H100 để tăng tốc hiệu suất xử lý mà không cần phải thay đổi về kết cấu.

Cuối cùng, hệ thống HGX H200 đầu tiên đi vào hoạt động là siêu máy tính Vendano tại Phòng thí nghiệm Quốc gia Los Alamos, Mỹ. Tiếp theo đó là hệ thống Vista của Trung tâm Máy tính Nâng cao Texas (TACC) cũng đạt được thoả thuận sử dụng CPU Grace và GPU Hopper của NVIDIA, nhưng chưa rõ là H100 hay H200.

NVIDIA cũng giới thiệu siêu máy tính Jupiter, bao gồm 24.000 siêu chip GH200, mang hiệu suất AI lên đến 96 exaflops (có lẽ là FP8) và 1 exaflops FP64.

Tom's Hardware.

Quảng cáo