Sau bao chờ đợi và teasing, cuối cùng thì AMD cũng chính thức cho ra mắt chip xử lý AI cao cấp AMD Instinct MI300X và MI300A. Thế hệ APU xử lý AI cao cấp này được cho sẽ giải tỏa phần nào cơn khát của thị trường chip xử lý AI cho máy chủ vốn luôn trong tình trạng khan hiếm hàng, ít sự lựa chọn và hiện vẫn phụ thuộc nhiều vào giải pháp của GPU cao cấp từ NVIDIA.

Đặc biệt hơn, với thế hệ chip này, AMD gần như là đơn vị duy nhất cho ra giải pháp 1 chip APU AI tích hợp cả CPU và GPU. Với cách thiết kế dạng APU, Instinct MI300 sẽ tận dụng được những ưu thế như dùng bộ nhớ Unified Memory (cho phép CPU và GPU cùng truy cập vào, đỡ tốn thời gian đẩy data, các intruction và ra lệnh qua lại nữa), tận dụng được lợi thế của Infinity Cache của AMd, CPU và GPU cũng chia sẻ và sử dụng điện năng hiệu quả hơn, từ đó đẩy hiệu năng tổng thể của APU lên cao hơn.

Sơ lược về thông số, trên bề mặt của Instinct MI300X là 192GB VRAM HBM3, băng thông 5,3TB/s, 4 die IOD với 256MB Infinty Cache, 4 cụm CCD Zen 4, 8 XCD 304 được phát triển dựa trên tiến trình CDNA 3 của AMD (5nm và 6nm). Theo AMD, Instinct MI300X cho khả năng tính toán các phép toán BF16 cao gấp 3,4 lần hay 6,8 lần đối với phép toán INT8, hỗ trợ những phép toán TF32, FP8, Sparsity,...

Đặc biệt hơn, với thế hệ chip này, AMD gần như là đơn vị duy nhất cho ra giải pháp 1 chip APU AI tích hợp cả CPU và GPU. Với cách thiết kế dạng APU, Instinct MI300 sẽ tận dụng được những ưu thế như dùng bộ nhớ Unified Memory (cho phép CPU và GPU cùng truy cập vào, đỡ tốn thời gian đẩy data, các intruction và ra lệnh qua lại nữa), tận dụng được lợi thế của Infinity Cache của AMd, CPU và GPU cũng chia sẻ và sử dụng điện năng hiệu quả hơn, từ đó đẩy hiệu năng tổng thể của APU lên cao hơn.

Chip AI cho máy chủ, chạy mô hình LLM

Sơ lược về thông số, trên bề mặt của Instinct MI300X là 192GB VRAM HBM3, băng thông 5,3TB/s, 4 die IOD với 256MB Infinty Cache, 4 cụm CCD Zen 4, 8 XCD 304 được phát triển dựa trên tiến trình CDNA 3 của AMD (5nm và 6nm). Theo AMD, Instinct MI300X cho khả năng tính toán các phép toán BF16 cao gấp 3,4 lần hay 6,8 lần đối với phép toán INT8, hỗ trợ những phép toán TF32, FP8, Sparsity,...

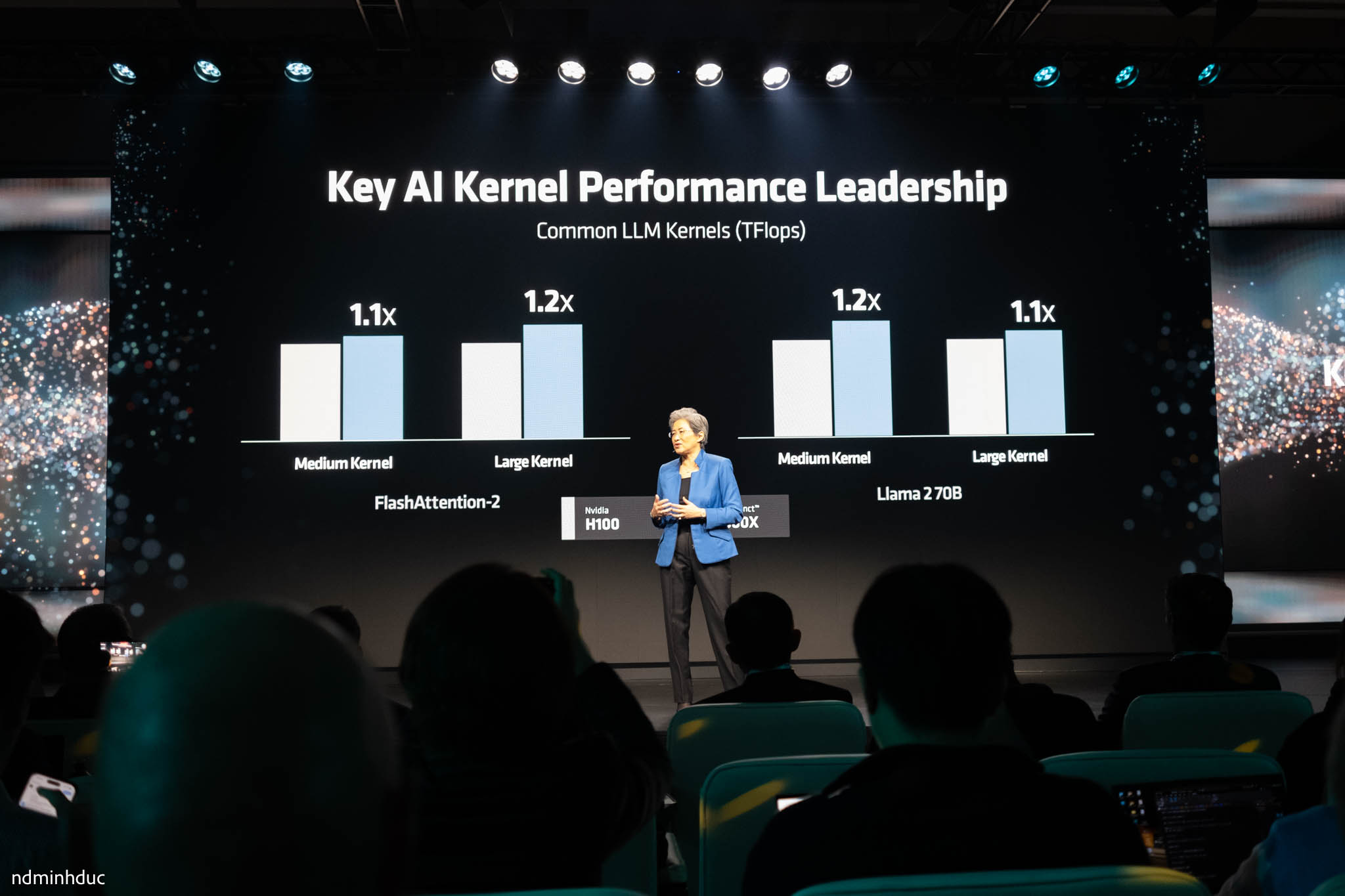

Với bộ nhớ cùng băng thông cực lớn, MI300X được thiết kế để vận hành những mô hình ngôn ngữ lớn (LLM) với số lượng tham số (parameter) ngày càng khủng khiếp hơn. AMD cho biết hiệu quả traning các mô hình AI của 1 server 8 GPU MI300X đạt thông lượng cao hơn H100 của NVIDIA 1,6 lần ở mô hình Bloom 176 tỷ tham số, hay ca hơn 14 lần ở mô hình Llama 2 70 tỷ tham số.

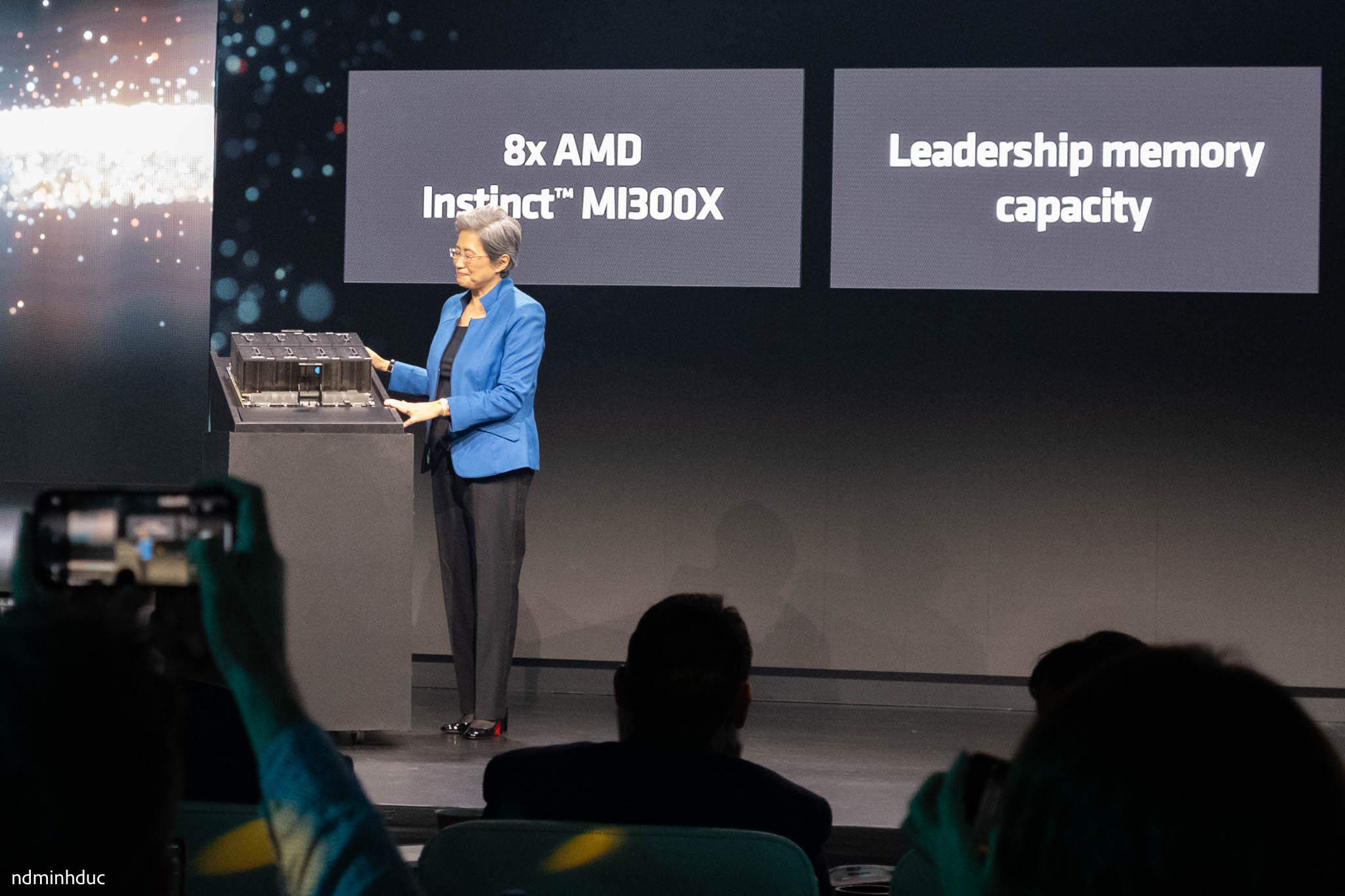

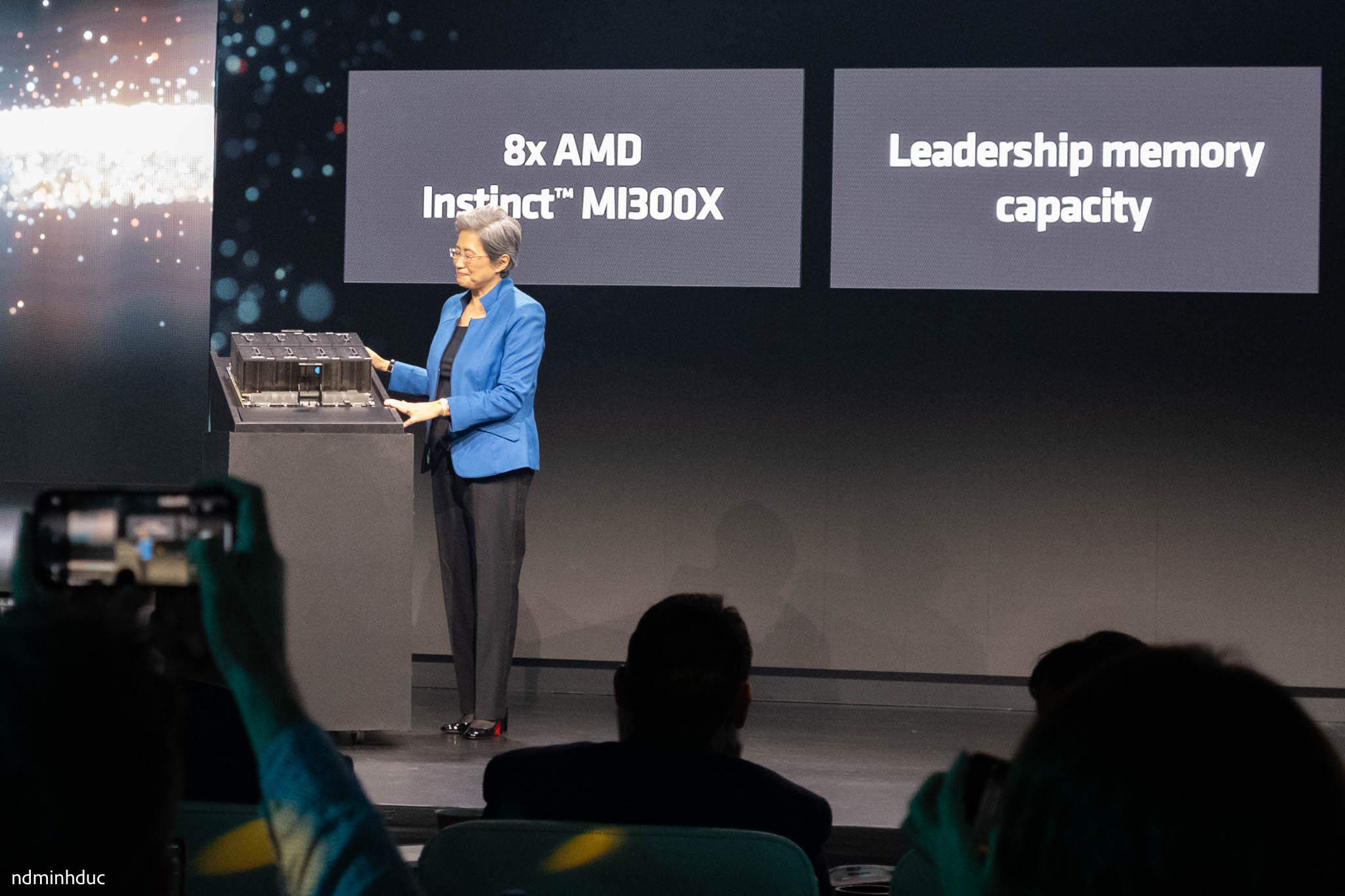

Khi kết hợp những chip MI300X lại với nhau để tạo nên platform điện toán AMD Infinity Architecture Platform, tám chip MI300X trên cùng một bo mạch sẽ cùng nhau xử lý những LLM đòi hỏi bộ nhớ và băng thông bộ nhớ cực kỳ lớn. Hệ thống này cho tổng bộ nhớ HBM3 lên tới 1.5TB, cao hơn 2,4 lần so với nền tảng H100 của NVIDIA, cho khả năng tính toán các phép toán FP16 / BF16 đạt 10,4PF, băng thông aggregate bidirectional đạt 896 GB/s, băng thông single node 448 GB/s, hỗ trợ PCIe Gen 5.

Chip AI cho HPC

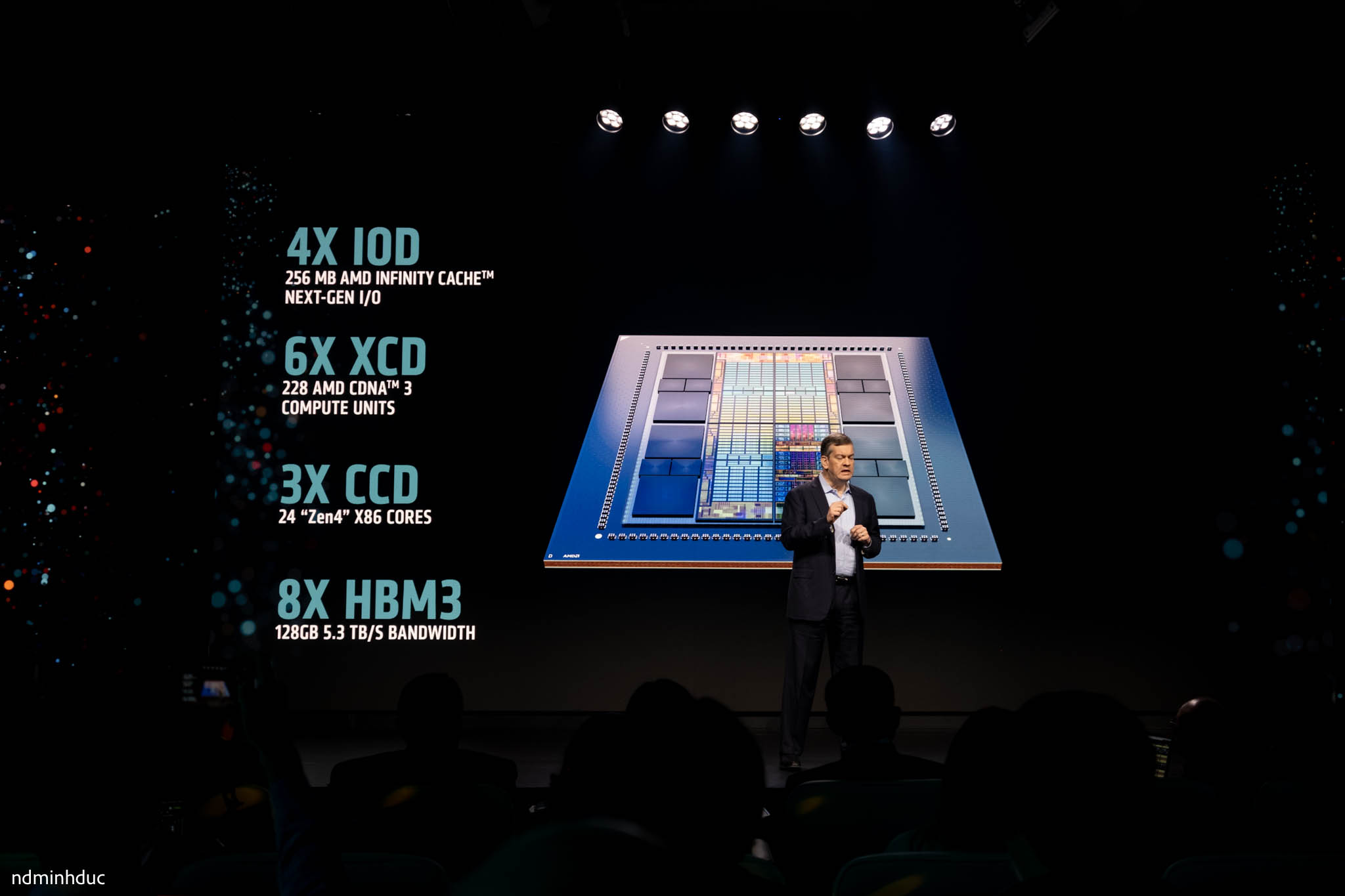

Nếu như MI300X hướng tới đối tượng doanh nghiệp hoặc những đơn vị có nhu cầu lớn về AI, thì MI300A là một "tùy biến" linh hoạt hơn, dành cho các đối tượng sử dụng HPC, nhà nghiên cứu,... Về thông số, trên bề mặt của một con APU Instint MI300A sẽ gồm 4 die IOD tích hợp 256MB AMD Infinty Cache, 3 cụm CCD với 24 nhân Zen4, 6 XCD chứa 228 nhân AMD CDNA 3 và phần còn lại là 8 stack bộ nhớ HBM3 với tổng dung lượng 128GB, băn thông 5,3TB/s.

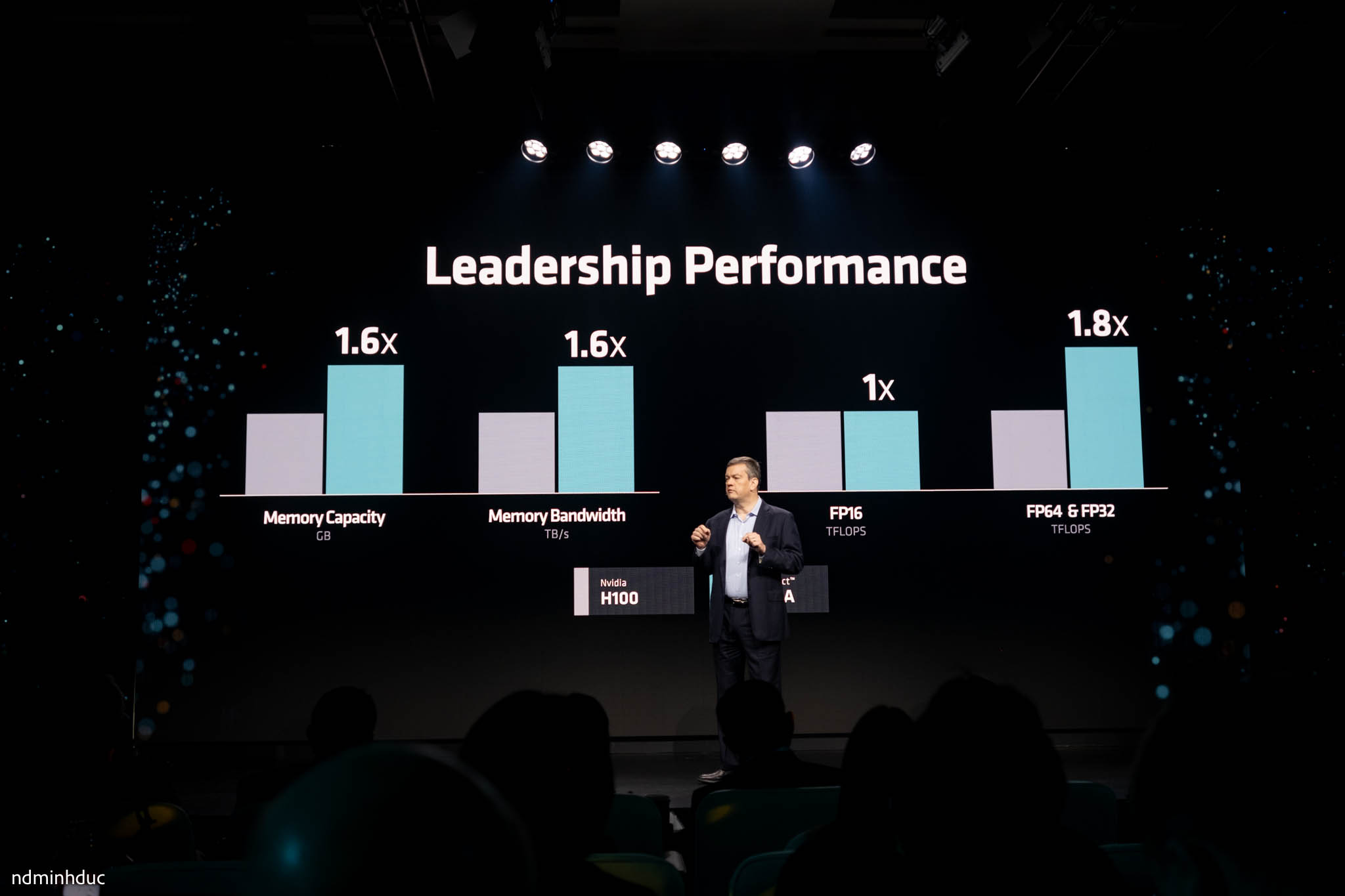

AMD cho biết về khả năng so với H100 của Nvidia, Instint MI300A có dung lượng bộ nhớ cao hơn 1,6 lần, băng thông cao hơn 1,6 lần, khả năng tính toán FP64 và FB32 cao hơn 1,8 lần. Đặc biệt, nhớ thiết kế dạng APU nên Instint MI300A sẽ có hiệu năng trên mỗi watt điện cao hơn gấp đôi so với con Grace Hopper của Nvidia (thực chất là CPU và GPU trên cùng một bo mạch chứ không phải toàn bộ trên 1 con chip APU)

Quảng cáo

Instinct MI300X và MI300A hiện không chỉ là câu trả lời của AMD đối với NVIDIA mà hơn hết, nó là một thí dụ rõ ràng nhất cho niềm tin của AMD về thế hệ chip APU với nhiều tủy chọn khác nhau, tương ứng với nhiều nhu cầu khác. Hiện tại, Instinct MI300X góp phần giải tỏa cơn khát GPU cho mục đích nghiên cứu, huấn luyện AI, đặc biệt là các ứng dụng Generative AI. Đối với AMD, Instinct MI300 rõ ràng sẽ giúp họ giành lấy được những khách hàng doanh nghiệp - những đối tượng mà từ lâu dù có tiền nhưng vẫn không mua được chip NVIDIA do nguồn cầu quá lớn vượt quá nguồn cung.

Chip AI cho PC

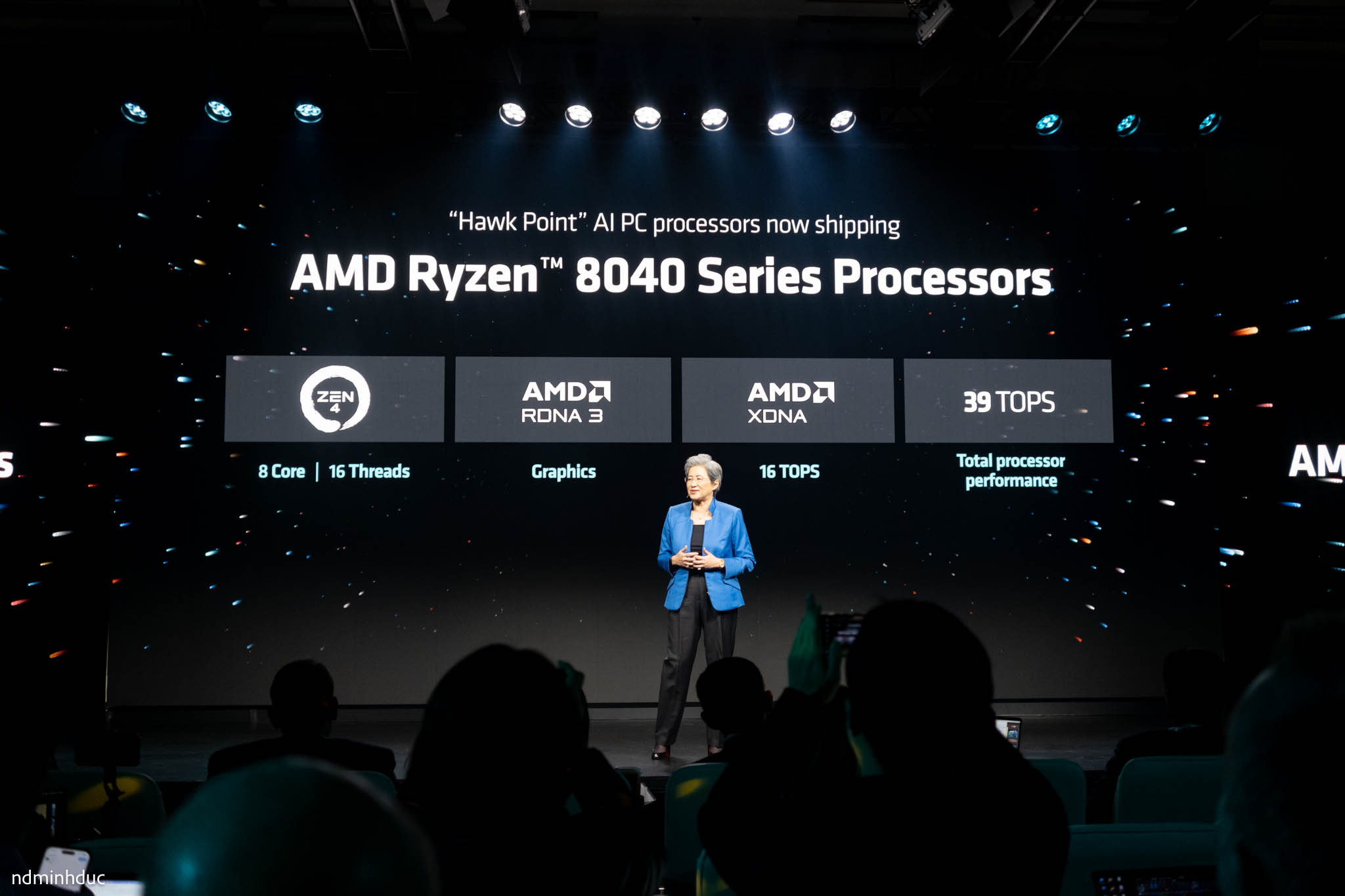

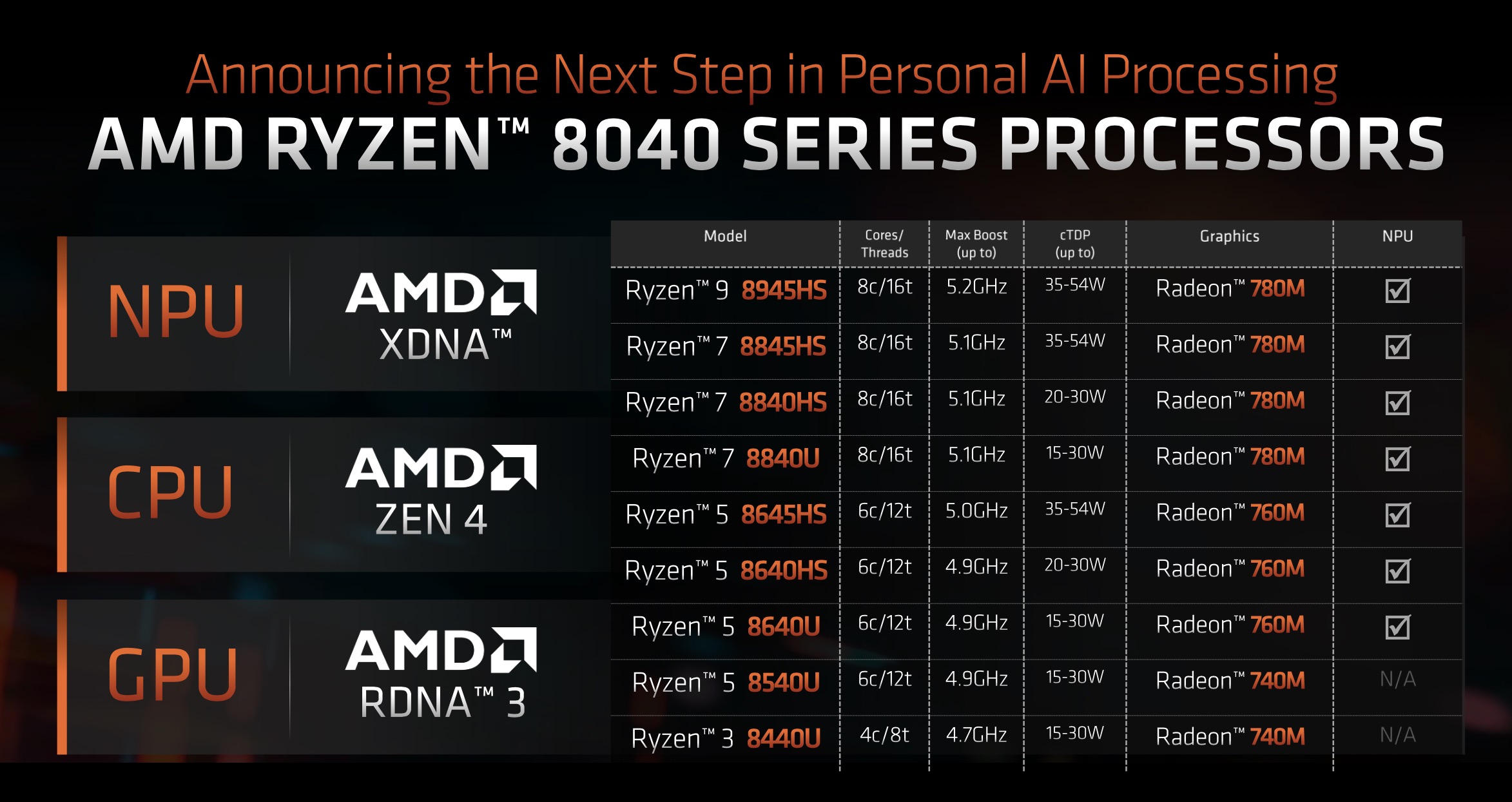

Cũng tại sự kiện vừa diễn ra ở California, AMD cũng chính thức giới thiệu AMD Ryzen 8040 Series, hướng tới các máy tính PC cá nhân xử lý AI. AMd cho biết Ryzen 8040 được trang bị 8 nhân CPU 16 luồng dựa trên kiến trúc Zen4, tích hợp chip đồ họa RDNA 3, chip xử lý các tác vụ AI với sức mạnh 16 TOPS.

Quảng cáo

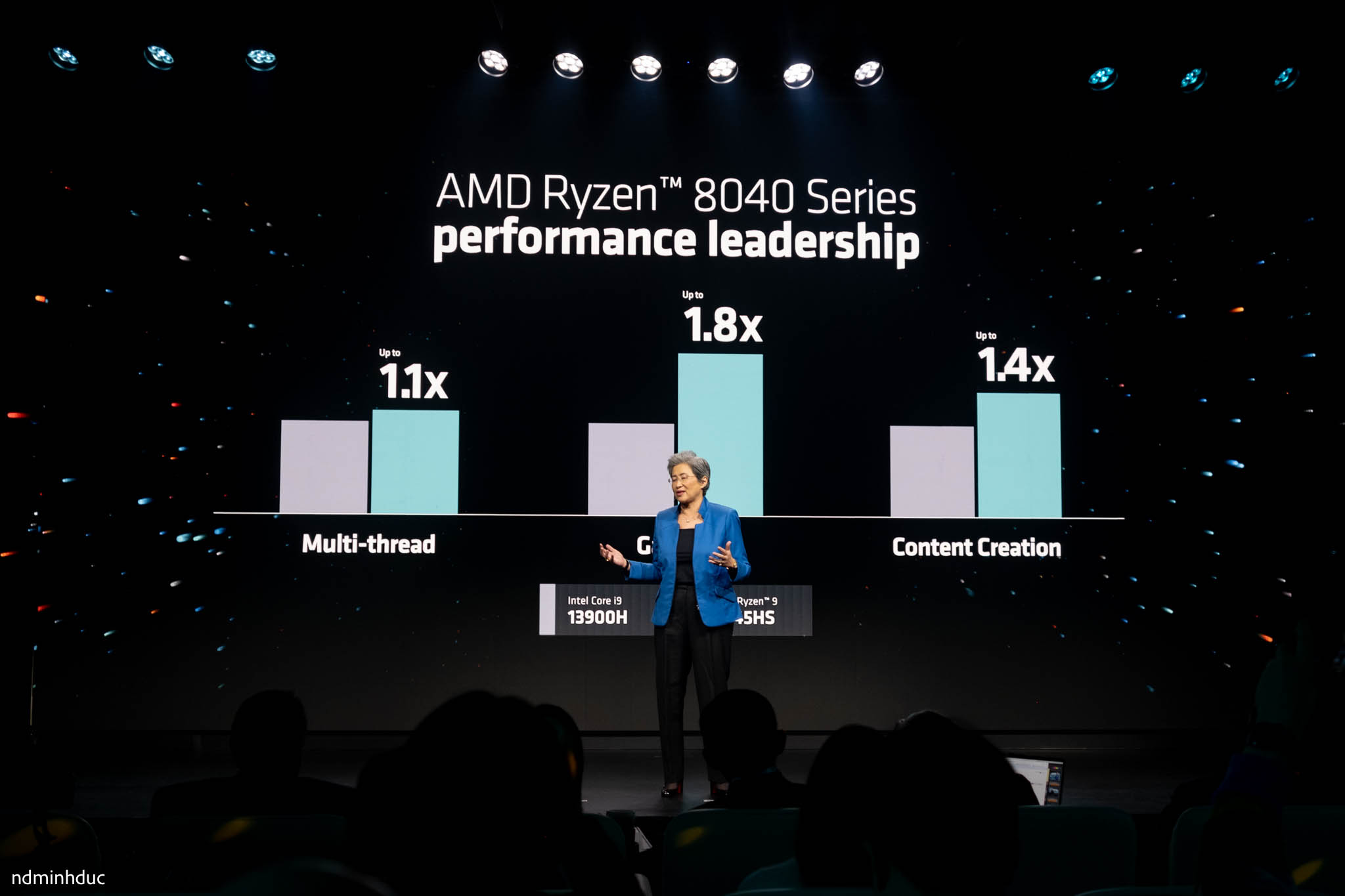

Gom toàn bộ các thành phần, Ryzen 8040 cho sức mạnh tổng cộng 39 TOPS. AMD nói rằng so với 13900H của Intel, Ryzen 8040 có hiệu năng đa luồng cao hơn 1,1 lần. Những chiếc máy đầu tiên chạy Ryzen 8040 của AMD sẽ bao gồm Acer, Asus, Dell, HP, Lenovo và Razer, dự kiến ra mắt từ quý 1 năm 2024 sắp tới.

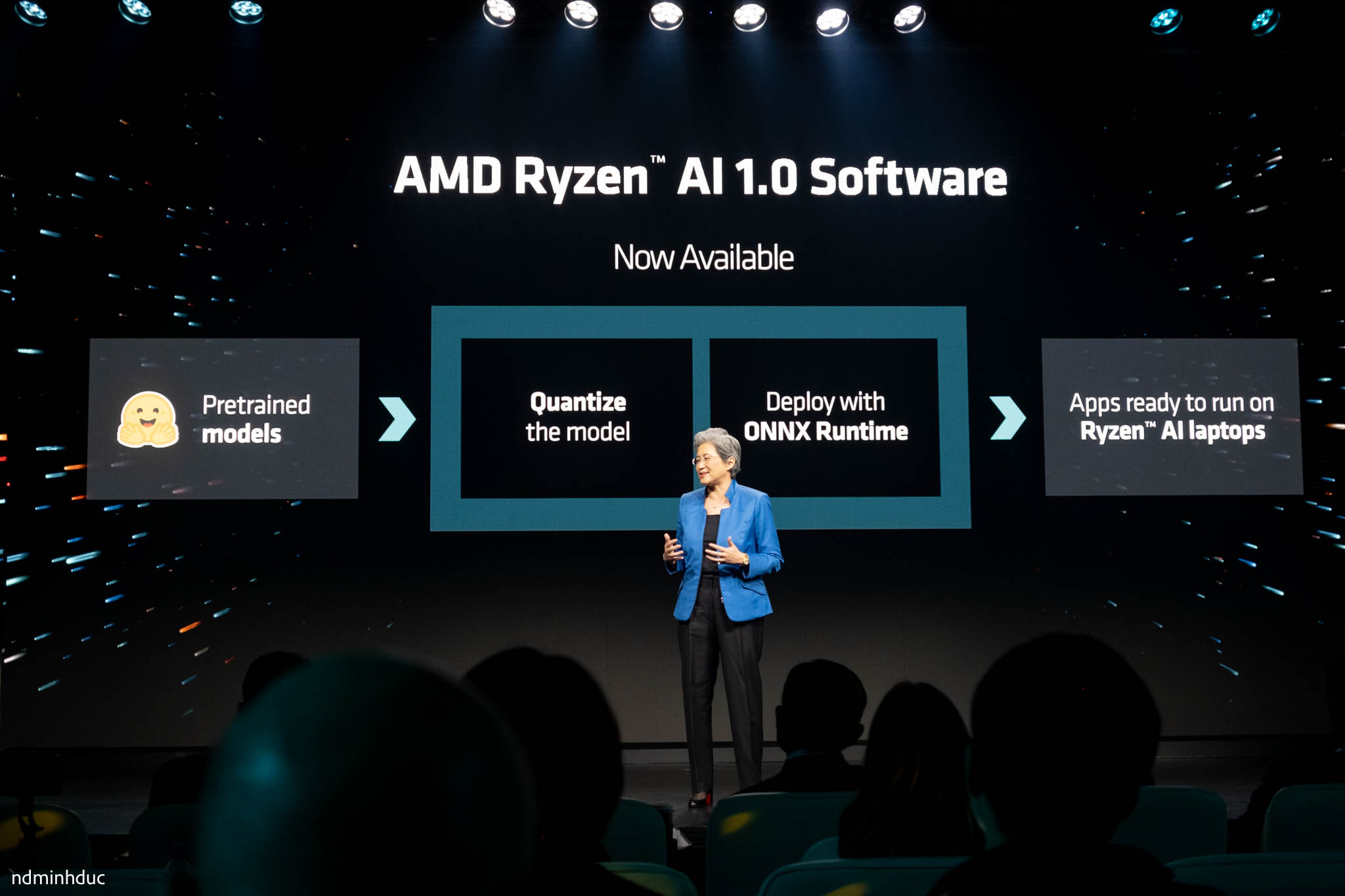

Bên cạnh đó, AMD hôm nay chính thức cho ra giải pháp phần mềm AMD Ryzen AI 1.0, giúp các nhà phát triển có thể chuyển nhanh các mô hình đã huấn luyện của họ sang chạy được một cách dễ dàng trên các laptops AI của AMD. Công ty nói rằng các máy laptop sử dụng chip Ryzen AI sẽ đảm nhiệm xử lý các mô hình AI bởi NPU, giải phóng khối lượng công việc lớn cho CPU và nhờ đó, thời lượng pin tổng thể của máy cũng được kéo dài ra. Chưa dừng lại ở đó, nhờ vào NPU, các tính năng AI khác cũng sẽ được các OEM triển khai dễ dàng hơn như nhận diện cử chỉ, xác thực sinh trắc học,...