Ngày từ những hình ảnh quảng cáo rò rỉ đầu tiên đã cho thấy có tính năng Face Unlock hiện diện trên chiếc Pixel 6 Pro. Ngoài ra báo cáo mới đây từ 9to5Google cho thấy có vẻ Google đã có dự định trang bị tính năng này ngay từ đầu trên chiếc Pixel 6 Pro nhưng sau đó đã tạm hoãn khi ra mắt. Vậy câu hỏi lúc này là Google sẽ vận hành tính năng này như thế nào trên Pixel 6 Pro để đảm bảo tính bảo mật vì máy chỉ có 1 camera trước và hoàn toàn không có bất kỳ hệ thống phần cứng chuyên biệt nào (như trên Pixel 4) để hỗ trợ.

Và đây là giả thuyết khả thi nhất:

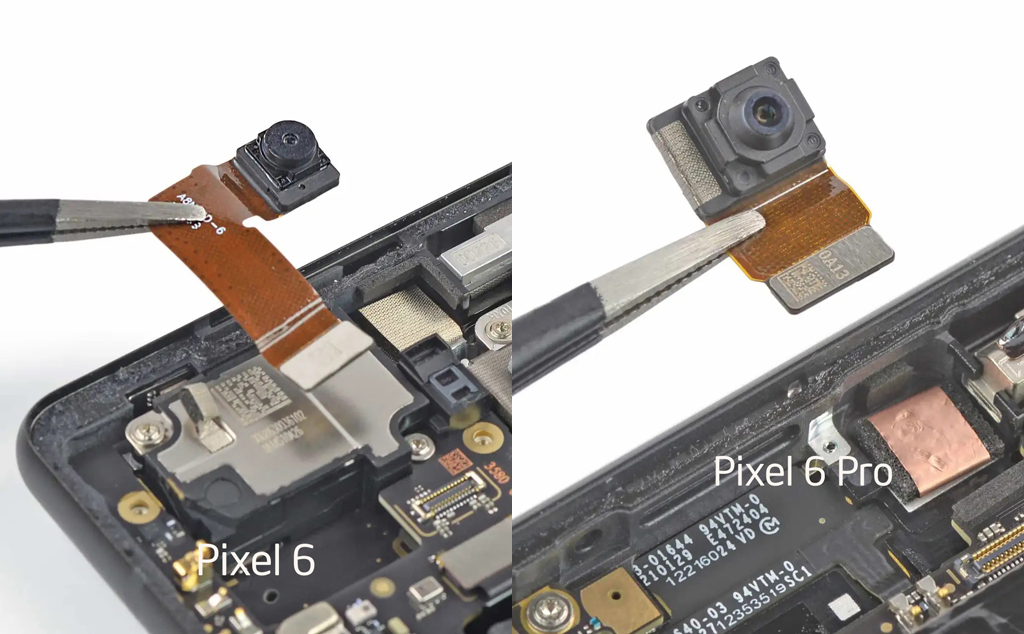

Đầu tiên, so sánh camera trước của Pixel 6 và 6 Pro thì 6 Pro có số megapixel cao hơn (11,1 so với 8MP), trường nhìn rộng hơn (94 so với 84 độ), khẩu độ nhỏ hơn (f/2.2 so với f2.0) và kích thước điểm ảnh lớn hơn (1,22 so với 1,12μm). Tuy nhiên sự khác biệt quan trọng nhất là Pixel 6 Pro sử dụng cảm biến Sony IMX663, hỗ trợ hệ thống lấy nét tự động Dual Pixel DPAF trong khi IMX335 trên Pixel 6 thì không.

Và đây là giả thuyết khả thi nhất:

DPAF trên camera trước

Đầu tiên, so sánh camera trước của Pixel 6 và 6 Pro thì 6 Pro có số megapixel cao hơn (11,1 so với 8MP), trường nhìn rộng hơn (94 so với 84 độ), khẩu độ nhỏ hơn (f/2.2 so với f2.0) và kích thước điểm ảnh lớn hơn (1,22 so với 1,12μm). Tuy nhiên sự khác biệt quan trọng nhất là Pixel 6 Pro sử dụng cảm biến Sony IMX663, hỗ trợ hệ thống lấy nét tự động Dual Pixel DPAF trong khi IMX335 trên Pixel 6 thì không.

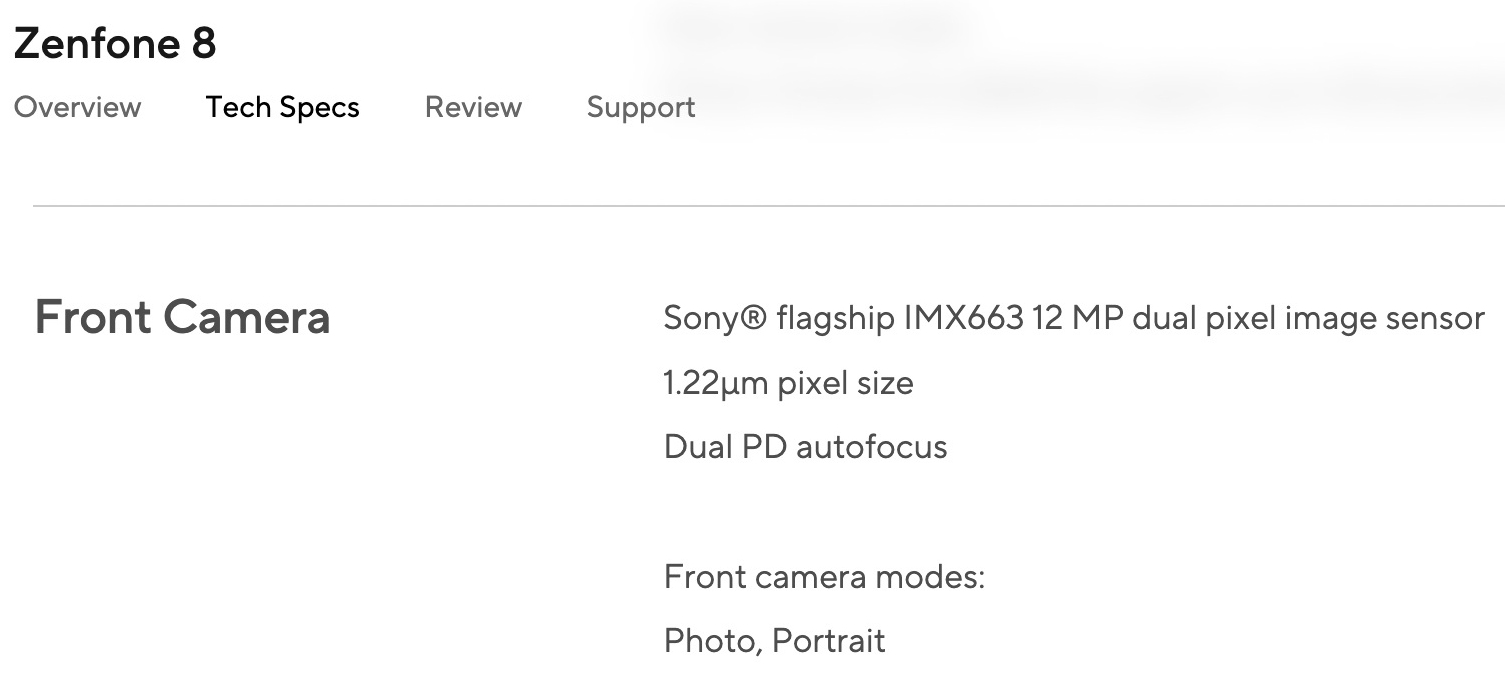

Điều thú vị là trong phần thông số kỹ thuật của Pixel 6 Pro không hề đề cập đến Dual Pixel trên camera trước. Thông tin này được phát hiện bằng cách xem thông số của Asus Zenfone 8, vốn cũng sử dụng IMX663.

Sự hỗ trợ từ machine learning

Tiếp đến, Google đã sử dụng DPAF kể từ thế hệ Pixel 2 để tạo bản đồ chiều sâu cho chế độ Portrait Mode chỉ bằng một ống kính duy nhất, bao gồm cả camera trước. Google đã giải thích cách hoạt động của tính năng này trên blog từ năm 2017: “Nếu chúng ta tưởng tượng ống kính của camera sau trên điện thoại được chia thành 2 nửa, thì quang cảnh của thế giới khi được nhìn qua phần bên trái và phần bên phải của ống kính sẽ hơi khác nhau. 2 điểm quan sát này cách nhau chưa đến 1mm (gần bằng đường kính của ống kính), nhưng chúng đủ khác nhau để tính toán đa chiều và tạo bản đồ chiều sâu”.

Một năm sau trên Pixel 3, Google đã cải thiện hơn nữa khả năng ước tính độ sâu do DPAF tạo ra bằng machine learning. (Pixel 4 sau đó đã cải thiện thêm Portrait Mode bằng cách tận dụng Dual Pixel và camera kép phía sau).

Bản đồ chiều sâu do DPAF tạo ra sẽ hữu ích để ghi lại các đường nét trên khuôn mặt người dùng, trong khi Google (từ quá trình phát triển ARCore) cũng có các thuật toán “độ sâu từ chuyển động” chỉ yêu cầu 1 camera RGB duy nhất. “Bản đồ chiều sâu được tạo bằng cách chụp nhiều hình ảnh từ các góc độ khác nhau và so sánh chúng khi bạn di chuyển điện thoại để ước tính khoảng cách đến từng pixel”, theo Google.

Google Tensor

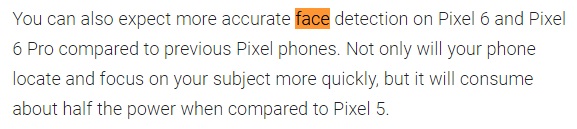

Và cuối cùng, Google có chip Tensor mới hỗ trợ xử lý machine learning nhanh hơn. Trước đó hãng cũng đã quảng cáo về cách con chip này cho phép (trong nhiếp ảnh) nhận diện khuôn mặt nhanh hơn, chính xác hơn trong khi sử dụng ít năng lượng hơn.

Quảng cáo

Tổng kết lại, tất cả những yếu tố trên có thể là cách mà Google có thể kết hợp để mang tính năng Face Unlock lên Pixel 6 Pro – bằng cách tận dụng các kỹ năng mà công ty đã phát triển trong nhiều năm giữa nhiếp ảnh điện toán và machine learning để tạo bản đồ chiều sâu cho khuôn mặt chỉ bằng 1 camera trước.

Tham khảo: 9to5Google