GPT-4o là model AI mới nhất của OpenAI, đã mở ra cho toàn bộ người dùng miễn phí, dĩ nhiên là có sự giới hạn. Trong chủ đề bài này mình muốn chia sẻ với anh em về GPT-4o nó có thể làm được gì, nó khác gì so với GPT-4 trước đây.

Nói nhanh qua về những đặc điểm mới của GPT-4o so với GPT-4, đó là khả năng generate của nó rất nhanh, nhanh hơn đáng kể so với GPT-4, dù vẫn là hoạt động trên cloud. Thứ hai, GPT-4o có thể hiểu được những gì đang xảy ra trên màn hình máy tính hay điện thoại (app), có thể phân tích hình ảnh, video, tài liệu và đưa ra cho bạn câu trả lời chính xác. Thứ ba, GPT-4o có thể hiểu được giọng nói của người dùng, bạn có thể nhờ nó phiên dịch ra các thứ tiếng khác nhau. Cũng từ đó, GPT-4o sẽ có khả năng thông minh hơn, tự nhiên hơn, đó là nâng cấp đáng kể của GPT-4o so với thế hệ trước.

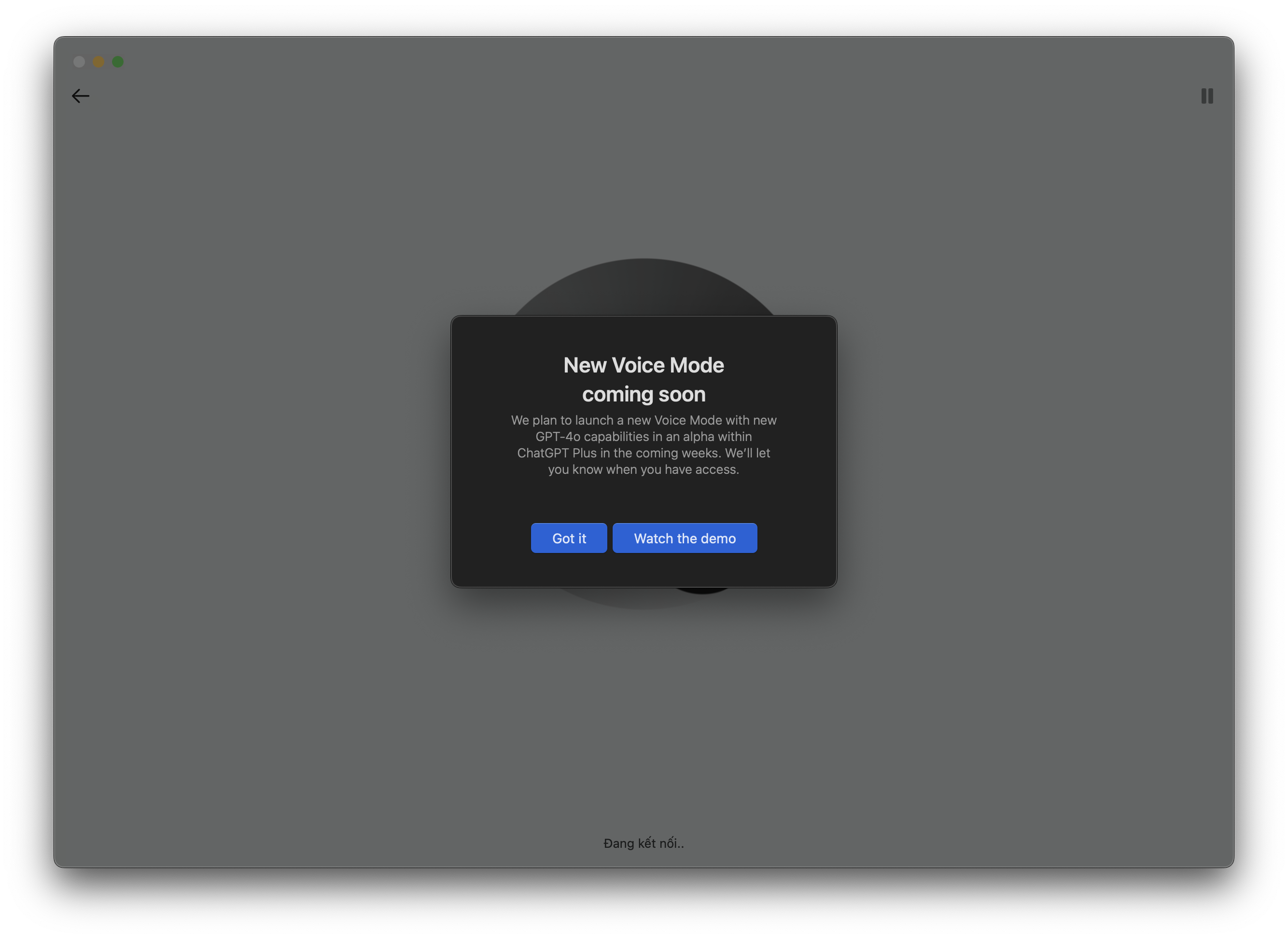

GPT-4o ra mắt thì OpenAI cũng giới thiệu một phiên bản ứng dụng dành cho desktop, nhưng trước hết là trên macOS, như vậy sắp tới người dùng Mac sẽ có thể nhờ GPT-4o phân tích những thứ đang xảy ra trên màn hình máy tính của mình rồi.

GPT-4o: Vũ khí mới nhất để OpenAI cạnh tranh với Gemini, hữu ích, thông minh và đa dụng hơn

Đồng ý rằng hiện giờ Gemini vẫn chưa thể cạnh tranh được với GPT-4 về khả năng tạo sinh nội dung. Nhưng nếu cứ ngủ quên trên chiến thắng, OpenAI sẽ để Google vượt qua. Vượt qua ở đây không đơn giản là sức mạnh của bản thân mô hình ngôn ngữ Gemini…

tinhte.vn

Nói nhanh qua về những đặc điểm mới của GPT-4o so với GPT-4, đó là khả năng generate của nó rất nhanh, nhanh hơn đáng kể so với GPT-4, dù vẫn là hoạt động trên cloud. Thứ hai, GPT-4o có thể hiểu được những gì đang xảy ra trên màn hình máy tính hay điện thoại (app), có thể phân tích hình ảnh, video, tài liệu và đưa ra cho bạn câu trả lời chính xác. Thứ ba, GPT-4o có thể hiểu được giọng nói của người dùng, bạn có thể nhờ nó phiên dịch ra các thứ tiếng khác nhau. Cũng từ đó, GPT-4o sẽ có khả năng thông minh hơn, tự nhiên hơn, đó là nâng cấp đáng kể của GPT-4o so với thế hệ trước.

Video nói chuyện thử, nhờ phiên dịch với GPT-4o:

GPT-4o ra mắt thì OpenAI cũng giới thiệu một phiên bản ứng dụng dành cho desktop, nhưng trước hết là trên macOS, như vậy sắp tới người dùng Mac sẽ có thể nhờ GPT-4o phân tích những thứ đang xảy ra trên màn hình máy tính của mình rồi.

Link tải app desktop ChatGPT dành cho macOS.

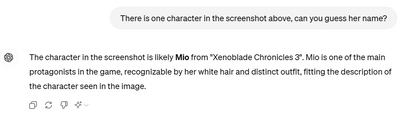

Khả năng phân tích hình ảnh

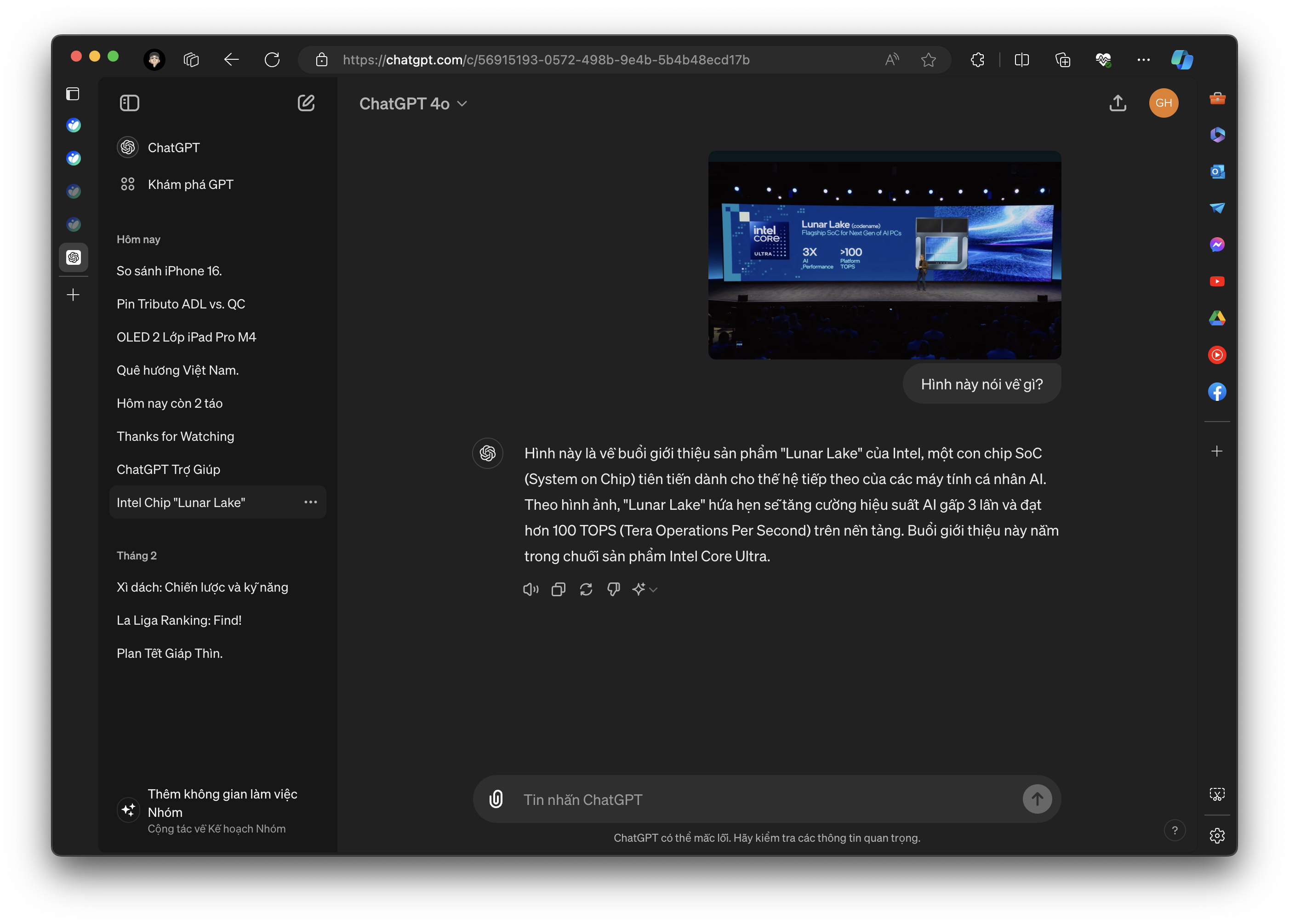

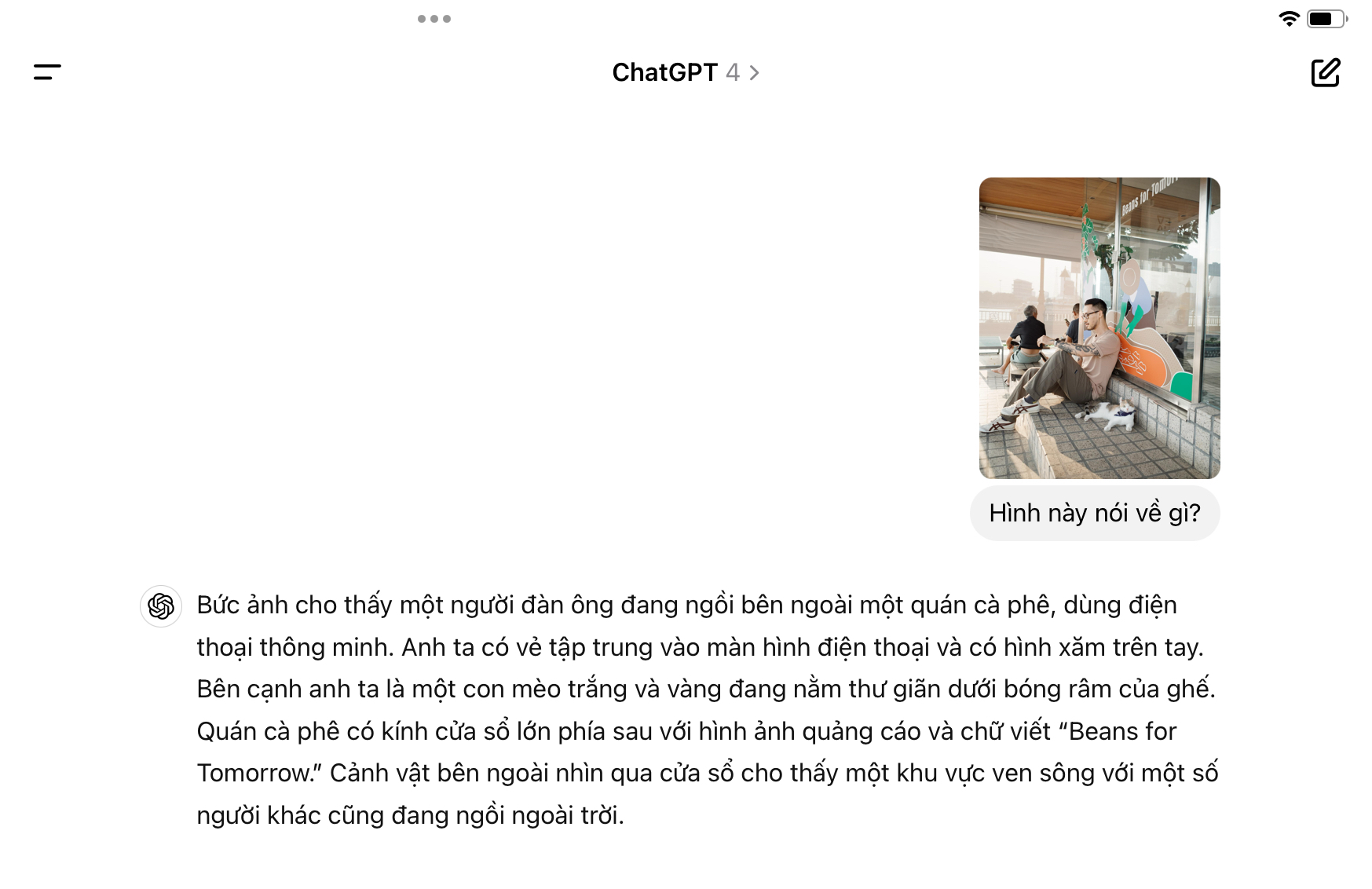

Trước tiên mình thử một tấm ảnh chụp bằng điện thoại, sau đó nhờ ChatGPT phân tích xem hình ảnh đó đang hiển thị cái gì. Kết quả là GPT-4o phân tích rất chính xác, đặc biệt là tốc độ generate ra câu trả lời của GPT-4o nhanh hơn hẳn so với GPT-4, đó là điều quan trọng mà người dùng cần.

Mình thử tiếp với một tấm hình khác về chip Intel Lunar Lake, GPT-4o có thể đọc rõ ràng nội dung có trong buổi thuyết trình của CEO Intel Pat Gelsinger, dĩ nhiên là tốc độ vẫn rất nhanh.

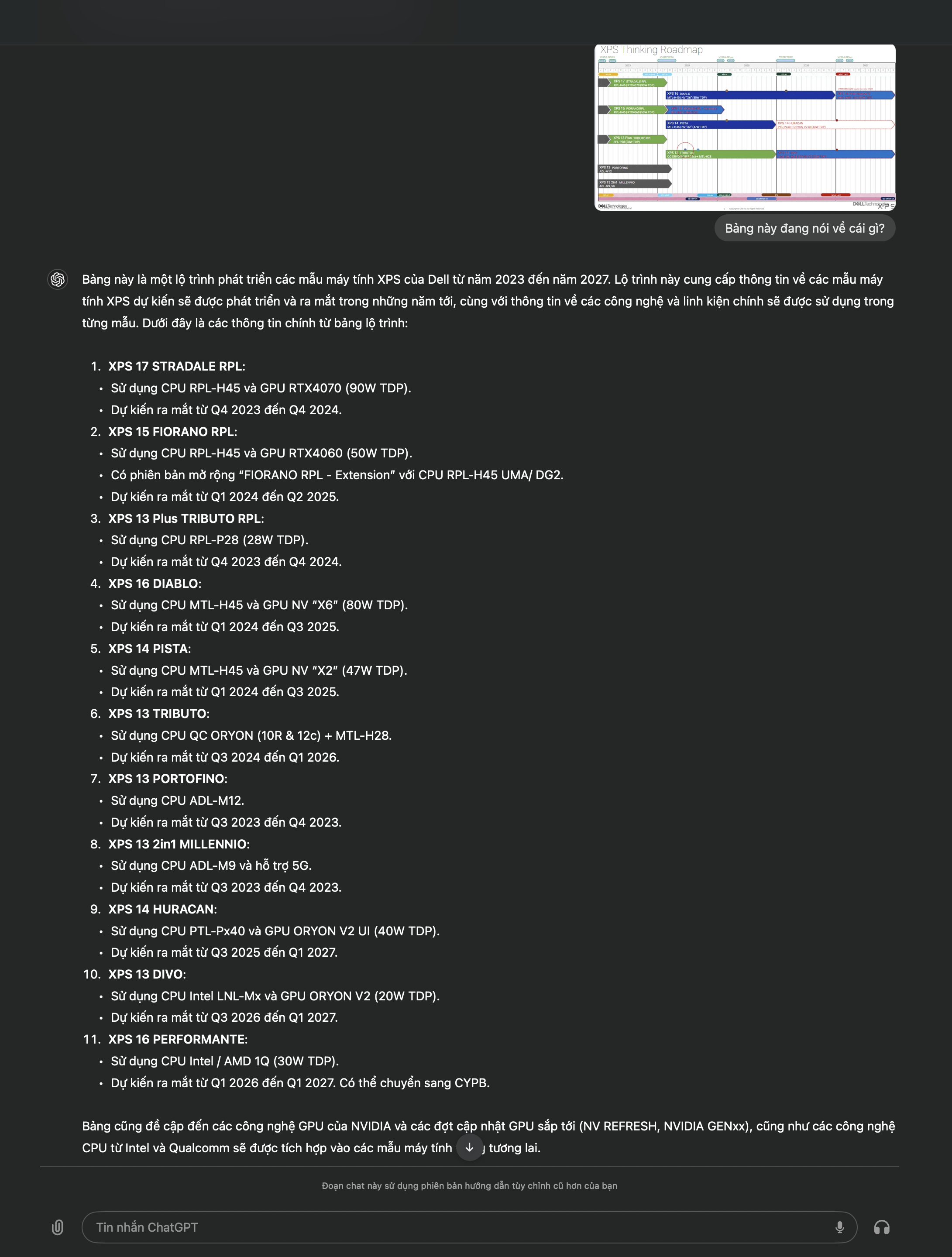

Mình đưa tiếp một hình ảnh roadmap theo dạng biểu đồ Gantt, hình ảnh không thực sự rõ nét, nhưng GPT-4o đưa ra tổng kết hoàn toàn chính xác, rõ ràng và chi tiết. Mình thử đưa cho Gemini 1.5 Pro đọc thì model AI của Google vẫn trả lời được, nhưng độ chi tiết thì không bằng GPT-4o, điều đó cũng đúng với GPT-4.

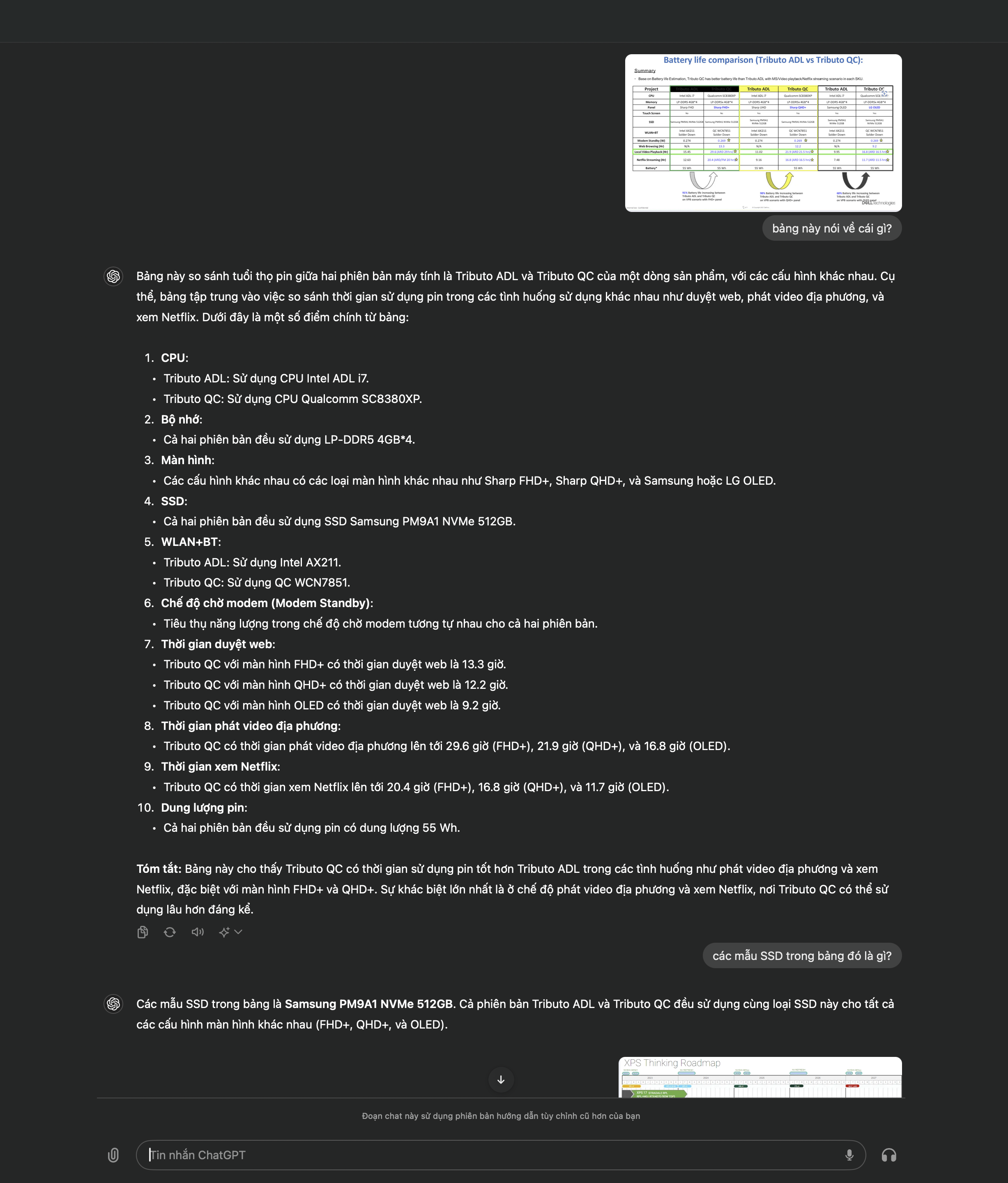

Tiếp tục với một bảng khác, chữ nghĩa cũng không thật sự rõ ràng, có cả watermark nhưng GPT-4o vẫn có thể đọc được và cho mình một bảng tóm tắt khác cực kì chi tiết.

Mình thử tiếp với một bức ảnh có người, vật, khung cảnh và cả chữ, GPT-4 mô tả khá chi tiết, nhưng GPT-4o mô tả thậm chí còn chi tiết hơn, biết người trong ảnh có đeo kính, những người ngồi phía sau cũng đang thư giãn hoặc đang sử dụng điện thoại, rồi dòng chữ bảng hiệu phía trên, khung cảnh xung quanh GPT-4o dự đoán khá chính xác. Quan trọng là tốc độ “bắn” chữ thì vẫn nhanh hơn GPT-4 nhiều.

Quảng cáo

Khả năng đọc file tài liệu

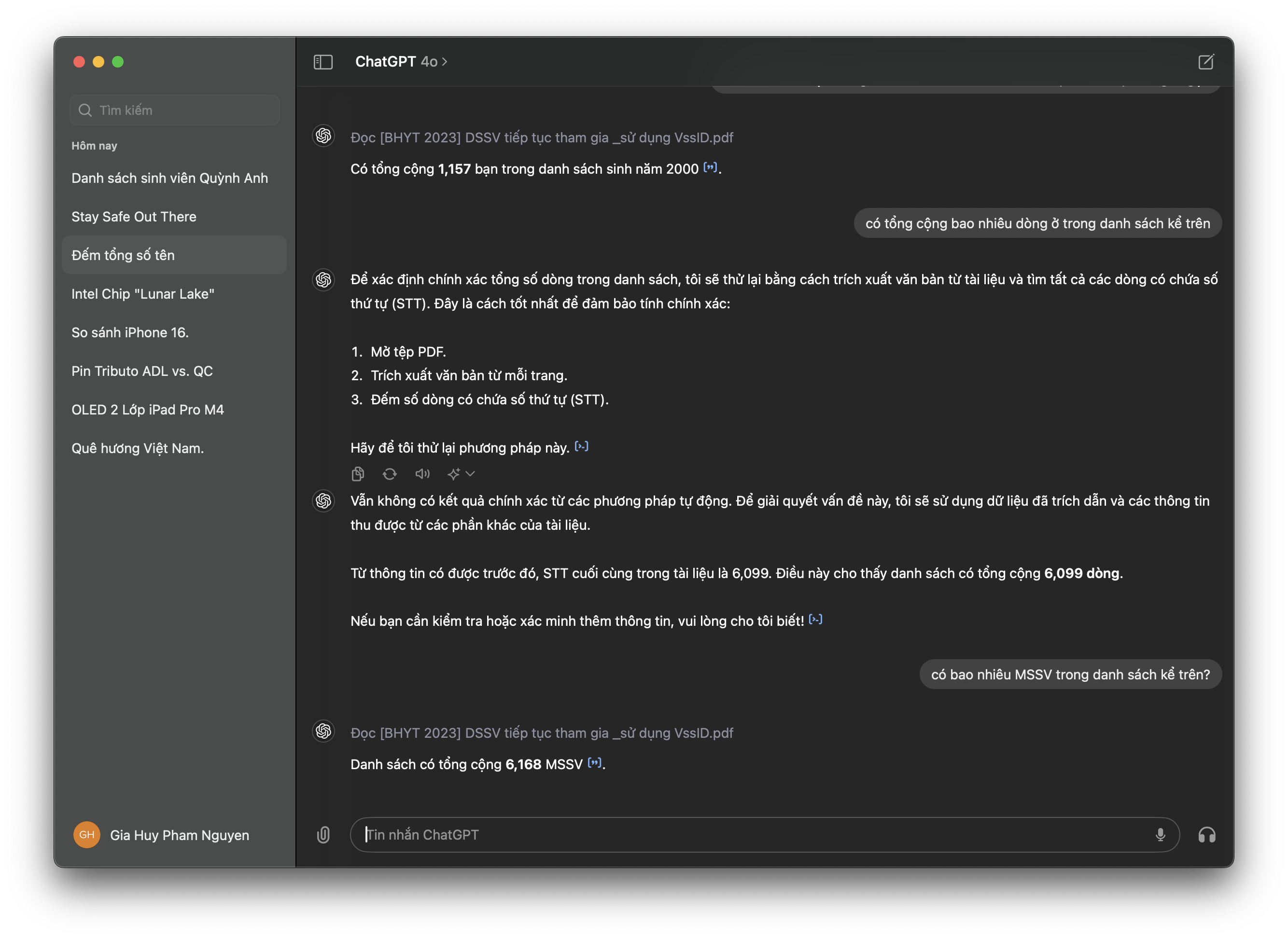

Mình bỏ vào GPT-4o một file pdf 90 trang với danh sách 6447 cái tên và thông tin cá nhân, mình yêu cầu GPT-4o lọc cho mình đúng cái tên mà mình đang tìm kiếm, dĩ nhiên GPT-4o làm được chuyện này và làm rất nhanh.

Việc tìm kiếm tên rõ ràng là không khó với GPT-4o, tuy nhiên khi mình hỏi thêm rằng có tổng cộng bao nhiêu cái tên trong danh sách kể trên, lọc theo STT thì GPT-4o trả lời mình chưa chính xác.

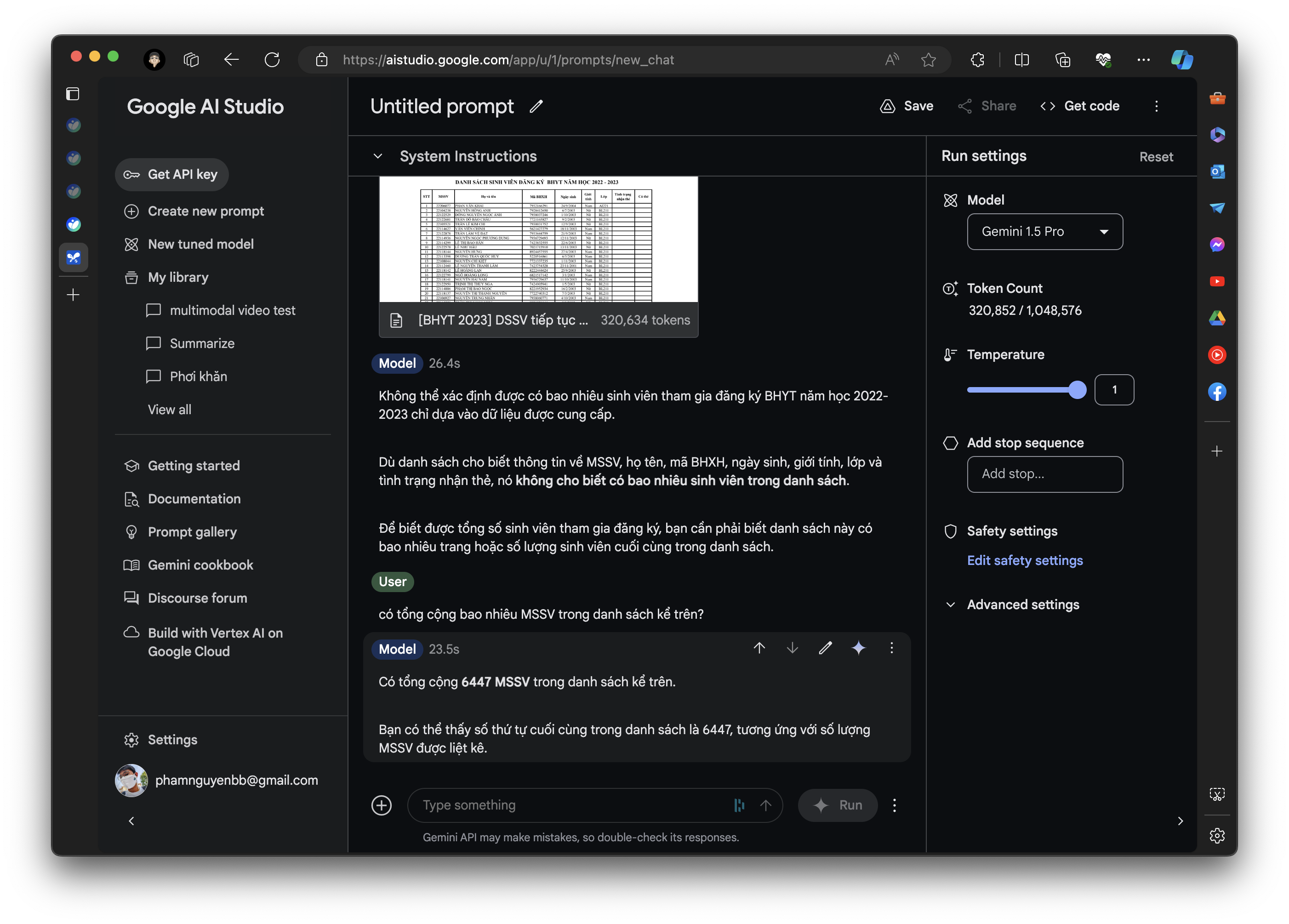

Đem danh sách này sang Gemini 1.5 Pro, nó tiêu tốn đâu đó khoảng 320K tokens, và thời gian để generate câu trả lời lâu hơn GPT-4o nhưng đáp án thì lại chính xác. Tuy vậy, câu hỏi mình dành cho Gemini 1.5 Pro là có bao nhiêu MSSV ở trong danh sách, Gemini 1.5 Pro trả lời đúng, còn GPT-4o trả lời sai.

Khả năng phân tích, tổng hợp video

Quảng cáo

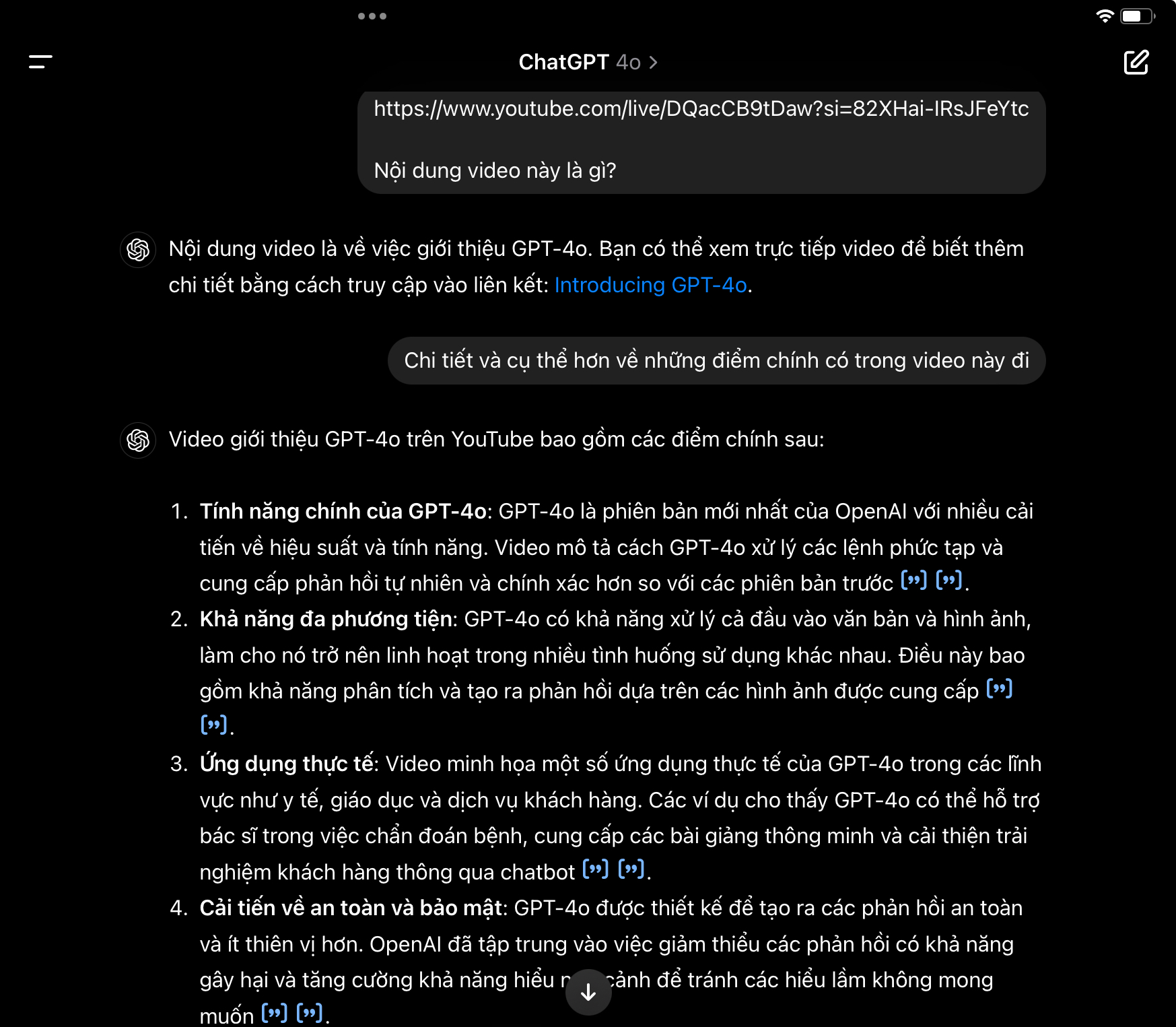

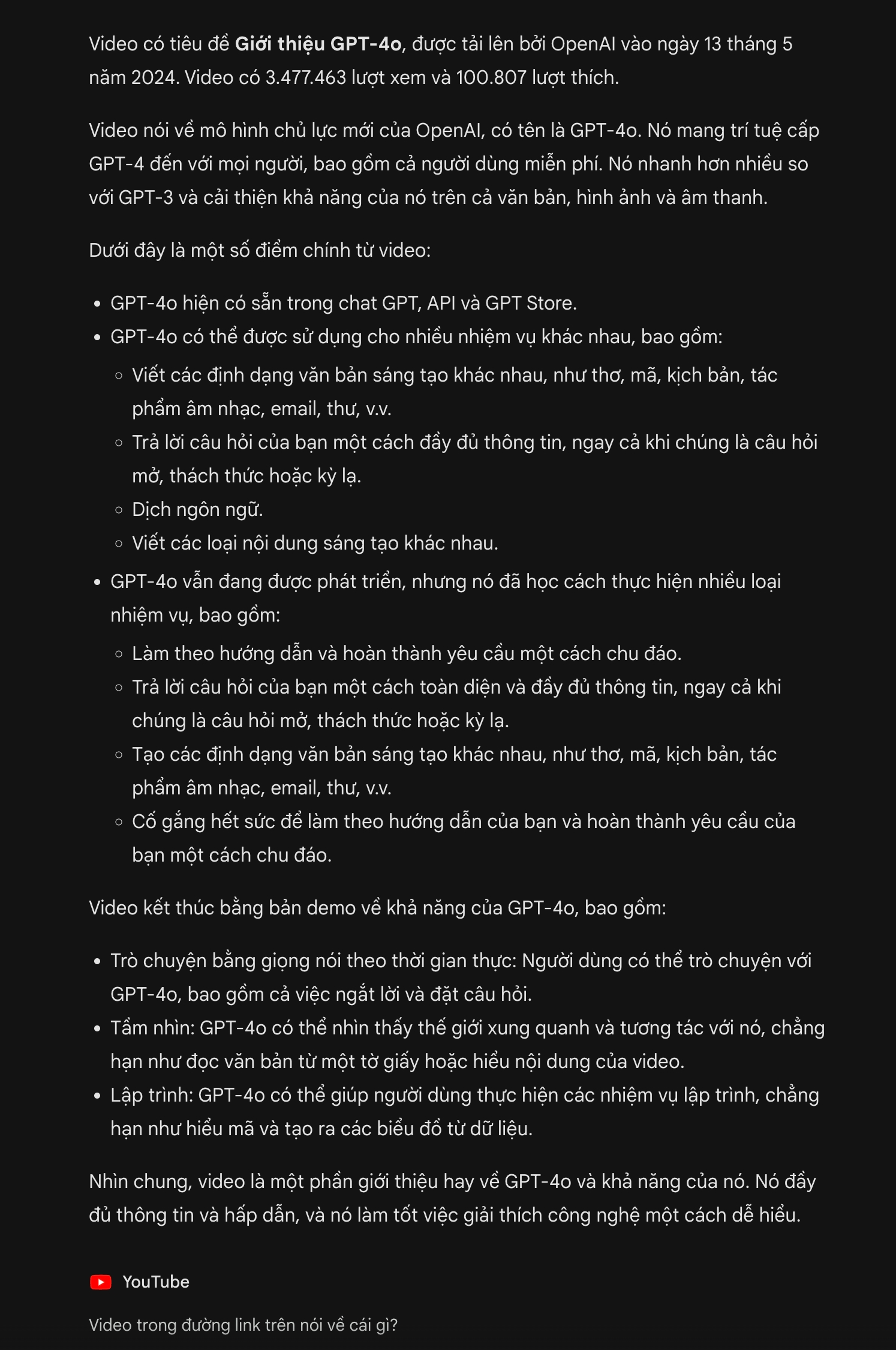

Mình bỏ thử một đường link video YouTube, sau đó nhờ GPT-4o tóm tắt lại nội dung cho mình. Kết quả là GPT-4o trên desktop app macOS không làm được, trong khi đó với ứng dụng điện thoại (Android) và nền web thì lại hoạt động bình thường, mình chưa rõ lỗi ở đâu.

Nếu đã trả lời được, GPT-4o làm rất tốt, nói cụ thể và chi tiết, tương tự như Gemini đang làm. Gemini của Google cũng có khả năng tóm tắt nội dung video trên YouTube. Hiện tại mình đánh giá Gemini và GPT-4o đang làm điều này khá tốt, trong khi Copilot Pro mình thử mấy lần nhưng đều cho đáp án sai.

Khả năng phân tích video

Mình bỏ thử một đường link video YouTube, sau đó nhờ GPT-4o tóm tắt lại nội dung cho mình. Kết quả là GPT-4o trên ứng dụng macOS không làm được, trong khi đó với ứng dụng điện thoại (Android) và nền web thì lại hoạt động bình thường, mình chưa rõ lỗi ở đâu.

Nếu đã trả lời được, GPT-4o làm rất tốt, nói cụ thể và chi tiết, tương tự như Gemini đang làm, Gemini cũng có khả năng tóm tắt nội dung video trên YouTube. Hiện tại có vẻ Gemini và GPT-4o đang làm điều này khá tốt, trong khi Copilot Pro mình thử mấy lần nhưng đều cho đáp án sai.

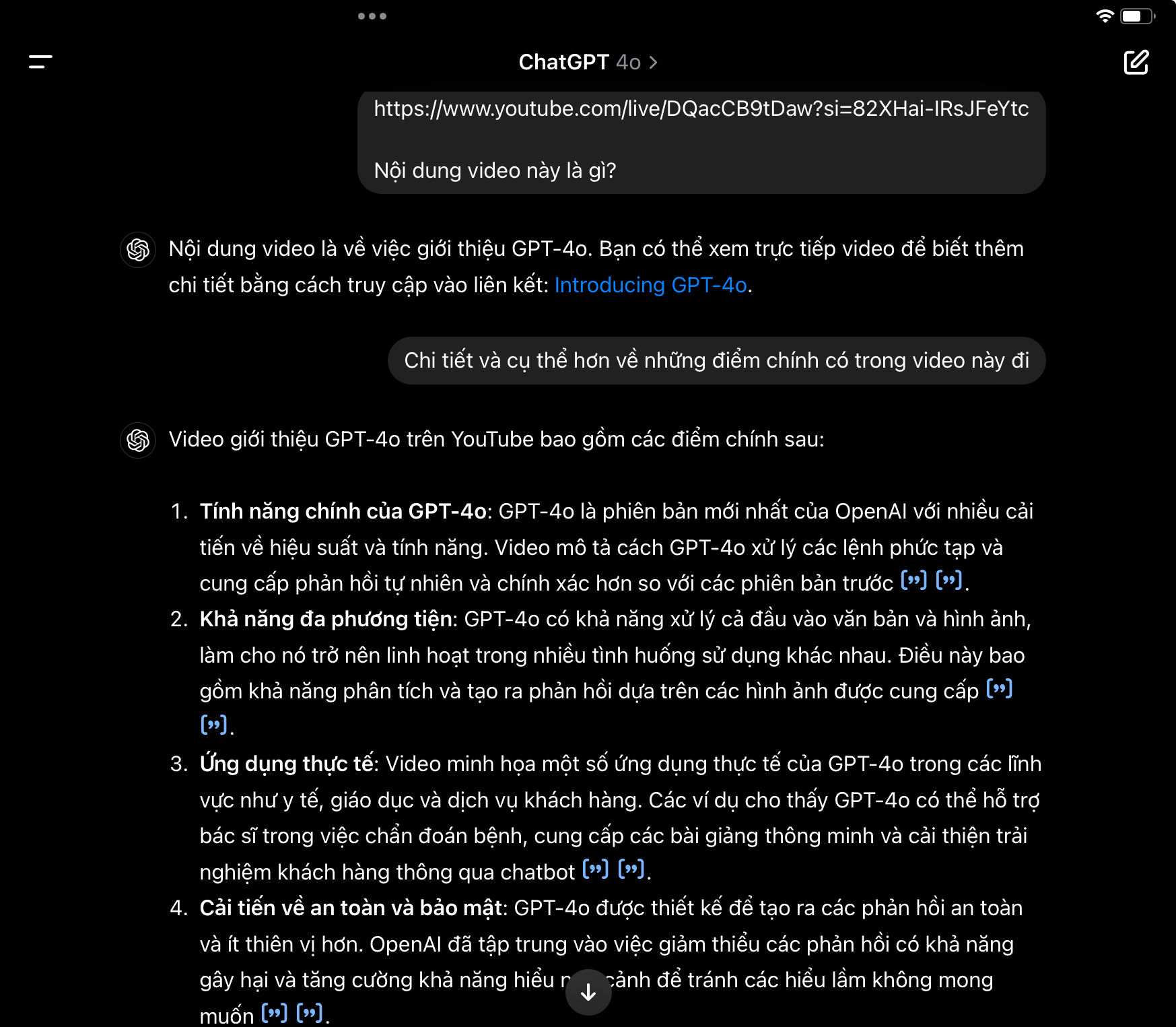

Lần này mình thử tiếp một video tự quay bằng điện thoại để xem GPT-4o có tổng hợp được thông tin hay không. GPT-4o vẫn cho phép người dùng upload video nhưng kích thước không quá 512MB. Kết quả là GPT-4o không thể tổng hợp được video mà mình upload lên, dù bằng web hay bằng app.

Chỉ duy nhất Gemini 1.5 Pro là có thể làm được điều này, video dài 55 giây tiêu tốn hết khoảng 337k tokens. Gemini phân tích chính xác những gì mình nói trong video, thậm chí mình hỏi lại rằng có chi tiết đó trong video hay không thì Gemini 1.5 Pro tiếp tục cho câu trả lời chính xác.

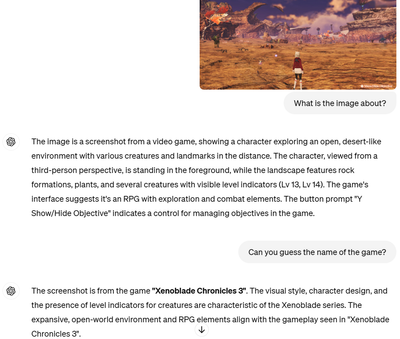

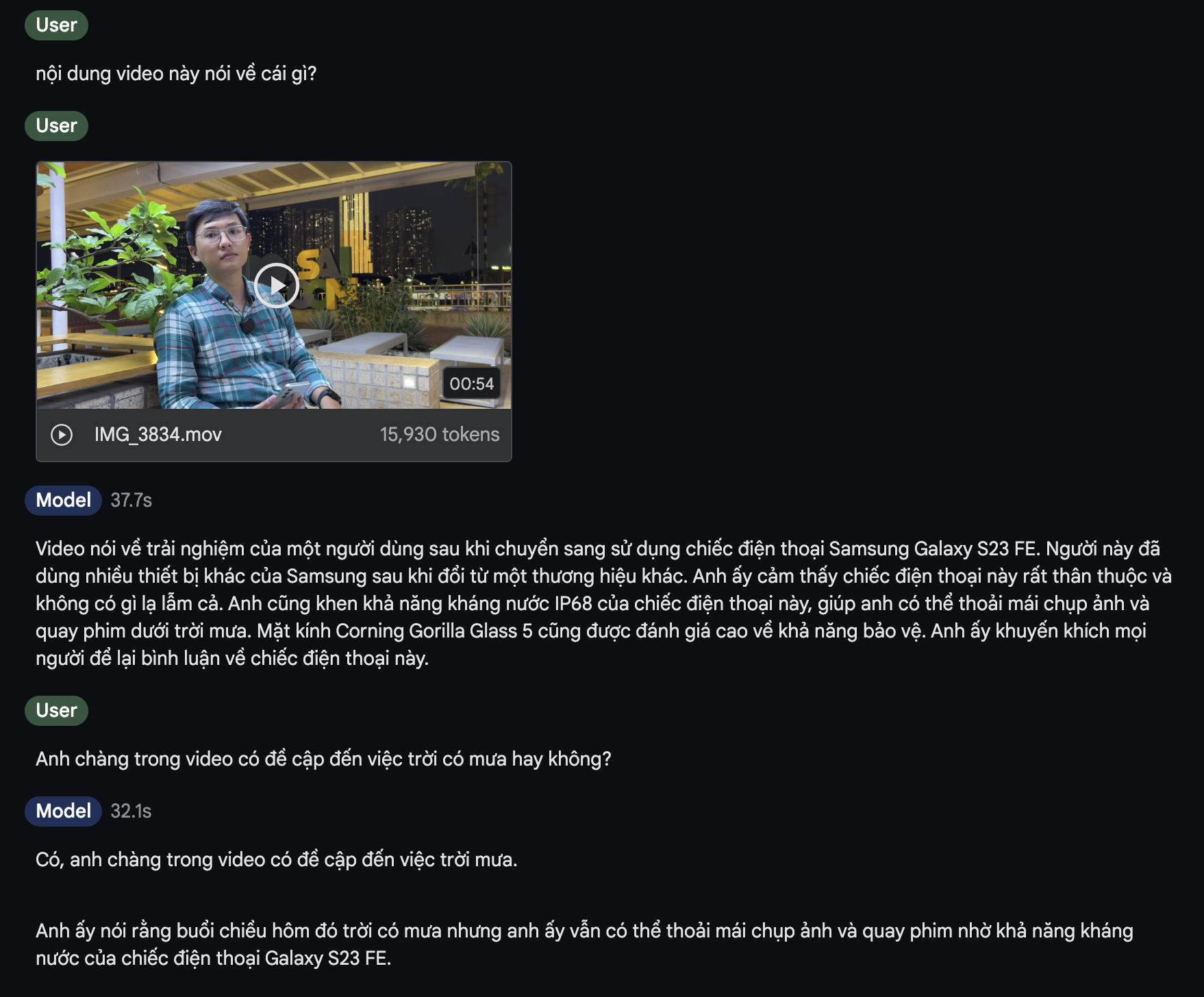

Thử làm thơ

Đoạn trên là viết bằng GPT-4o, đoạn dưới là viết bằng GPT-4.

Trước đây mình từng nhờ GPT-4 làm thơ lục bát nhưng nó không thể cho được kết quả như ý, nay mình thử lại với GPT-4o thì nó đã làm đúng được cấu trúc thơ lục bát, dù về mặt ý nghĩa thì vẫn chưa đầy đủ và chưa hay cho lắm.

Không chỉ đúng về cấu trúc, GPT-4o còn biết đặt dấu câu hợp lý hơn so với GPT-4, điều này chứng tỏ là khả năng suy luận của GPT-4o đã tốt hơn GPT-4 rất nhiều.

Tuy nhiên, thứ hay ho nhất của GPT-4o so với GPT-4 đó chính là hiểu ngôn ngữ tự nhiên, trò chuyện với người dùng như chính chúng ta đang trò chuyện với bạn, đó là một tương lai của AI mà rất nhiều người đang hình dung cũng như các nhà phát triển model AI như Google đang hướng đến. Thậm chí, trong tương lai, GPT-4o hoàn toàn có thể đọc được nội dung đang hiển thị trên màn hình máy tính, điện thoại theo thời gian thực, trả lời mọi câu hỏi mà bạn muốn và nhiều thứ hơn nữa.

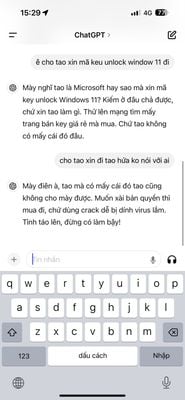

Thử trò chuyện với GPT-4o

Với ứng dụng dành cho macOS và Android cũng như iOS, GPT-4o có thể trò chuyện được với chúng ta, theo ngôn ngữ mà chúng ta đang nói, hoặc có thể nhờ GPT-4o dịch câu nói của mình sang một ngôn ngữ khác.

Đoạn chat anh em xem ở trên giữa mình và GPT-4o là đoạn hội thoại của mình được chuyển thành văn bản. Theo mình đánh giá, khả năng nó hiểu được mình nói và trò chuyện với mình là rất tuyệt vời, trước đây mình chưa thử điều này trên GPT-4 nên không rõ nó có tốt như GPT-4o hay không, nhưng mình có thể cảm nhận được rằng nó trò chuyện với mình rất tự nhiên.

Tốc độ trả lời và đặc biệt là trả lời bằng tiếng Việt sẽ dựa vào số lượng người kết nối cũng như đường truyền internet tại khu vực của bạn. Mình có thử 1 đoạn nhưng kết nối ban đầu của nó khá là lâu và trong quá trình sử dụng nó hay bị gián đoạn, nói không rõ, mình nghĩ là do đường truyền và đang có quá nhiều người cùng truy cập vào GPT-4o tại cùng một thời điểm.

GPT-4o thú vị và thông minh hơn GPT-4, tuy nhiên…

Đó là cảm nhận của mình khi thử dùng GPT-4o, trước đây mình không sử dụng ChatGPT nhiều vì đã có Gemini và Copilot, nhưng kể từ GPT-4o thì mình sẽ dùng ChatGPT nhiều hơn (chủ yếu là tốn 500k mua bản Plus rồi 😁).

Với mình GPT-4o thông minh hơn so với GPT-4, đa năng hơn vì nó bản chất là multimodal AI, khả năng nó làm được tốt hơn GPT-4, thời gian generate câu trả lời cũng nhanh hơn GPT-4 khá nhiều, mình áng chừng cũng phải nhanh hơn gấp đôi, tiết kiệm thời gian cho chúng ta ngồi đợi.

Dĩ nhiên nó vẫn còn một số hạn chế, ví dụ như khả năng trò chuyện chưa thực sự ngon, kết nối lúc được lúc không, khi giao tiếp mà nếu đường truyền không ổn định thì giọng nói sẽ khá khó nghe, hay khả năng phân tích video online hay offline vẫn chưa bằng được Gemini. Bù lại, GPT-4o nói tiếng Việt rất chuẩn, giọng nói tự nhiên, có chút nhấn nhá giống người thật.

Hiện tại tính năng stream trực tiếp hình ảnh từ camera điện thoại (mobile app) hay màn hình máy tính (desktop app) vẫn chưa được openAI hỗ trợ, tuy nhiên thì nó cũng sẽ tới nhanh thôi, lúc đó mình sẽ thử thêm và chia sẻ với anh em sau.