Dù chỉ tổng có 15 trang, tuy nhiên tài liệu nghiên cứu về AI mà Apple công gần đây đã tiết lộ nhiều điểm cực kỳ thú vị mà dưới góc độ nào đó, đây rất có thể chính là cách họ "teasing" những tính năng AI sẽ được trang bị trên iOS 18 sắp tới, qua đó cũng thể hiện cách mà Apple sẽ khai thác AI cho người dùng.

Sau một thời gian im hơi lặng tiếng trước sự bùng nổ của AI, Apple gần đây đã có nhiều động thái thể hiện sự quan tâm của công ty tới công nghệ trí thông minh nhân tạo và mới nhất, họ phát hành một nghiên cứu khá ngắn gọn về mô hình AI mà công ty đang phát triển.

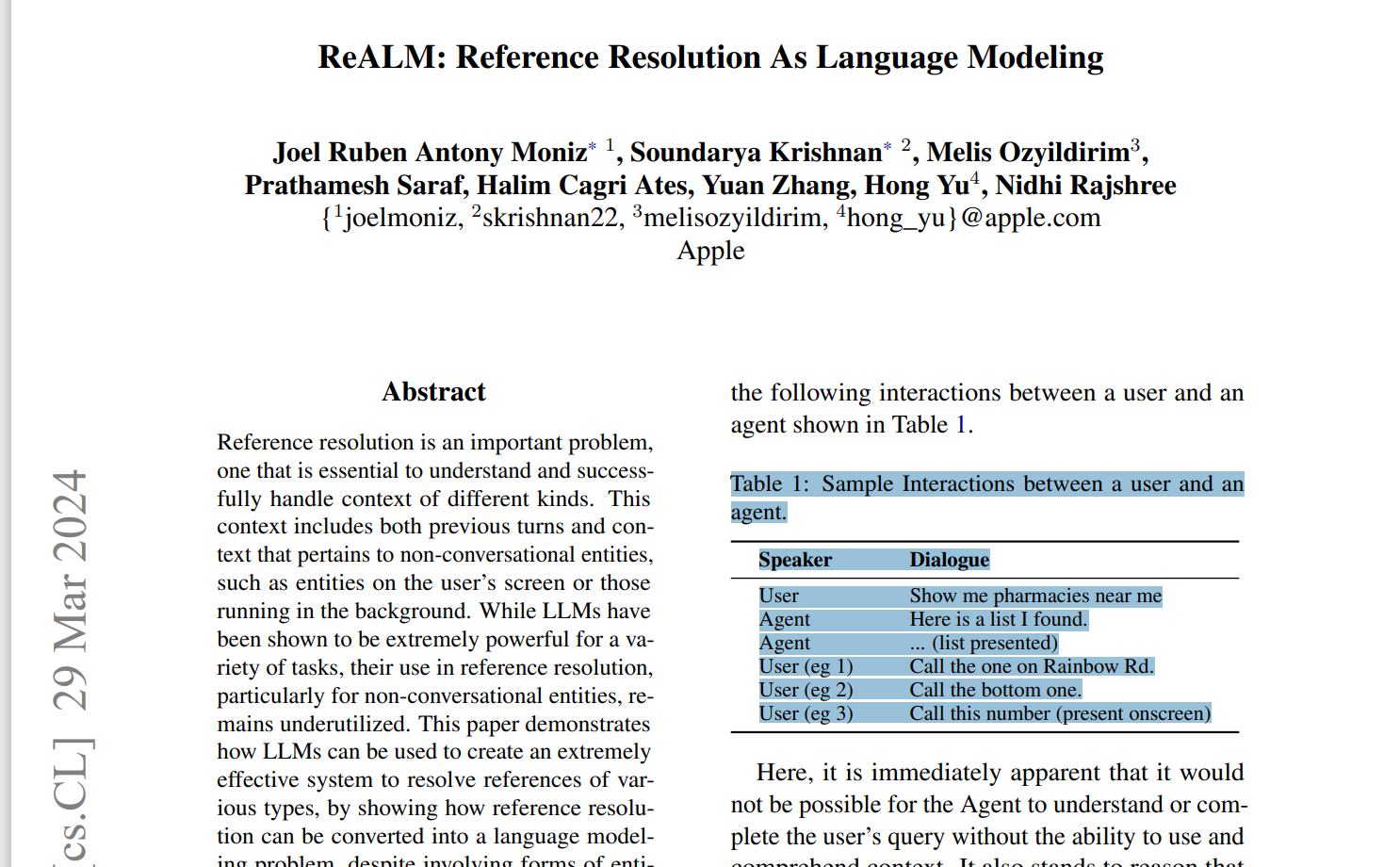

Với tên gọi Reference Resolution As Language Modeling (ReALM), nghiên cứu của Apple tập trung vào phân tích thực trạng của cách tiếp cận AI hiện tại, đồng thời đưa ra cách tiếp cận AI mới của họ. Sơ lược một chút, cái mà chúng ta nói về AI suốt thời gian qua chính là xoay quanh câu chuyện dùng "text" để giao tiếp với AI.

99,99% các ứng dụng AI mà anh em có thể tiếp cận được đều sử dụng cách này: anh em nhập câu lệnh (prompt) vào, model sẽ có hiểu coi anh em muốn gì và trả về kết quả. Dù đâu ra có là text, hoặc hình, hoặc video cũng đều dựa trên bản chất này. Tuy nhiên, theo nghiên cứu vừa công bố thì Apple chọn một cách tiếp cận khác.

Sau một thời gian im hơi lặng tiếng trước sự bùng nổ của AI, Apple gần đây đã có nhiều động thái thể hiện sự quan tâm của công ty tới công nghệ trí thông minh nhân tạo và mới nhất, họ phát hành một nghiên cứu khá ngắn gọn về mô hình AI mà công ty đang phát triển.

Nghiên cứu model AI vừa công bố của Apple

Với tên gọi Reference Resolution As Language Modeling (ReALM), nghiên cứu của Apple tập trung vào phân tích thực trạng của cách tiếp cận AI hiện tại, đồng thời đưa ra cách tiếp cận AI mới của họ. Sơ lược một chút, cái mà chúng ta nói về AI suốt thời gian qua chính là xoay quanh câu chuyện dùng "text" để giao tiếp với AI.

99,99% các ứng dụng AI mà anh em có thể tiếp cận được đều sử dụng cách này: anh em nhập câu lệnh (prompt) vào, model sẽ có hiểu coi anh em muốn gì và trả về kết quả. Dù đâu ra có là text, hoặc hình, hoặc video cũng đều dựa trên bản chất này. Tuy nhiên, theo nghiên cứu vừa công bố thì Apple chọn một cách tiếp cận khác.

Trong nghiên cứu, Apple đưa ra một thí dụ người dùng đang tìm nhà thuốc ở gần. Họ đưa ra câu lệnh "tìm giúp tôi nhà thuốc gần đây", lúc này agent (anh em có thể hiểu là một con AI nhân công) sẽ hồi đáp lại "đây là danh sách tôi tìm thấy + [danh sách các nhà thuốc ở gần]". Tới đây thì về cơ bản cũng truyền thống chứ chưa có gì là AI hay thông minh. Nhưng tới đoạn sau mới ghê.

Sau đó, thí dụ giả định rằng người dùng sẽ phản hồi lại theo kiểu: "gọi cho cái ở đường Rainbow", hoặc "gọi cho cái cuối" hoặc “gọi cho số này”. Anh em lưu ý những chữ mình in đậm. Trên thực tế, cách con người giao tiếp chứa đầy những từ ngữ mơ hồ (theo kiểu, vừa hất hàm vừa bảo người bên cạnh "đi ra đó đi", hoặc "nhớ hôm bữa,...". Đối với con người, khi đang "sống" trong ngữ cảnh đó, con người hoàn toàn hiểu được một cách tự nhiên. Tuy nhiên, đối với máy tính, đó vẫn là một sự mơ hồ và hiện hầu hết các model AI không thể hiểu được người dùng muốn gì: “cái” ở đường Rainbow là cái gì, số điện thoại hay số đường, “cái cuối” là cái gì, số này là số nào,…

Có một thuật ngữ ở đây gọi là Reference resolution, nghĩa là một từ bình thường có nghĩa này, nhưng trong câu thì có nghĩa khác. Thí dụ như "Cô ấy yêu con chó của cổ." Con người thì đọc qua cái hiểu được liền, nhưng đối với máy, rất khó để nó xác định được "cô ấy" và "cổ" là 1 chủ thể. Các mô hình AI lớn cũng vẫn gặp rắc rối với chính vấn đề này.

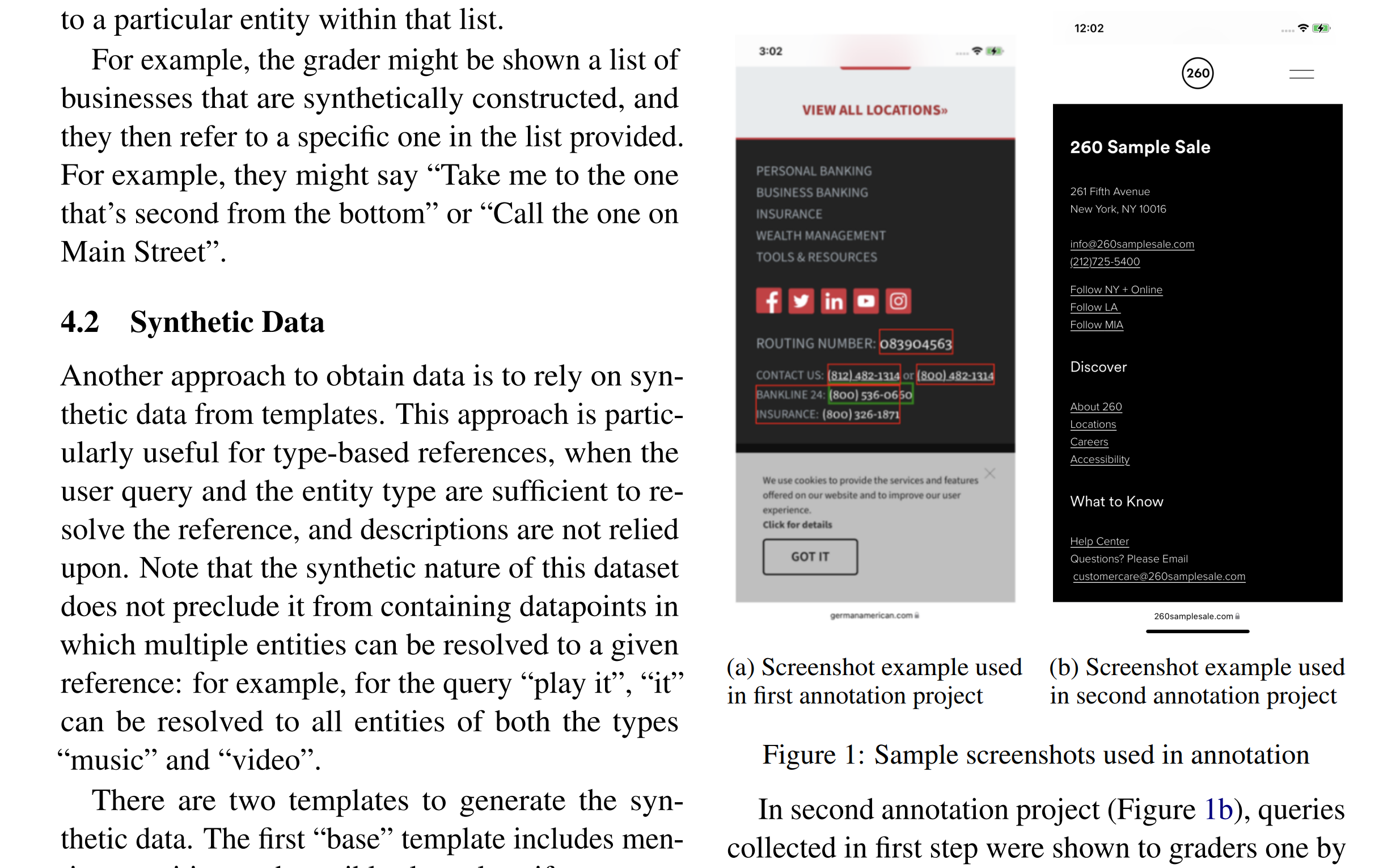

Và lúc này, Apple đề cập tới 2 giải pháp khả dĩ: tìm cách cho máy hiểu được ngữ cảnh đàm thoại và ngữ cảnh đang hiện trên màn hình. Dựa trên 2 thông tin này, AI sẽ xác định được ý định của người dùng qua các câu "số này, cái cuối hay cái ở đường rainbow." Apple đã chỉ ra khó khăn ở chỗ "hiểu được màn hình người dùng" bởi trong quá trình sử dụng tự nhiên, trên đó là một đống cực kỳ phức tạp, gây khó khăn cho các model nhận diện hình ảnh hoặc text trên màn hình kiểu truyền thống. Rõ ràng kỹ thuật nhận diện chữ trên màn hình OCR hay nhận diện hình ảnh thì có lâu rồi, nhưng vấn đề là người dùng cứ lướt lướt màn hình, rồi đủ dạng thông tin ở mọi nơi mà họ đang mở thì điều đó không dễ dàng chút nào.

Cuối cùng, Apple đề xuất 3 cách tiếp cận để thu được nhiều data nhất có thể với mục đích cuối cùng là để hiểu được ngữ cảnh của người dùng, sau đó suy ra họ muốn gì và trả về kết quả cho họ hài lòng. Đó là sự kết hợp của dữ liệu tương tác của người dùng (text họ gõ gì, họ nói gì, họ bấm chỗ nào,...), sau đó là các dữ liệu tổng hợp (kiểu lệnh "phát nó đi,... ) và cuối cùng là dữ liệu thu được trên màn hình (bao gồm trang web đang mở, số điện thoại, email, địa chỉ,...) Tất cả sẽ được tận dụng để model ReALM của Apple sử dụng nhằm hiểu được người dùng muốn gì.

Trong nghiên cứu, Apple đã làm một thử nghiệm, so sánh 4 model với 4 kích thước của họ (lần lượt 80 triệu, 250 triệu, 1 tỷ và 3 tỷ tham số) và so với cả ChatGPT 3.5 và GPT-4 của OpenAI. Kết quả, Apple nói rằng model nhỏ nhất của họ cho khả năng hiểu được các Reference tương đương với GPT-4 (tin đồn nói rằng có 1,76 ngàn tỷ tham số), còn các model lớn hơn thì hoạt động hiệu quả hơn ở khoảng này.

Quảng cáo

Nếu nghiên cứu AI này được áp dụng cho iOS 18?

Đấy là thông tin trong nghiên cứu của Apple vừa công bố về con AI ReALM của họ. Mặc dù đây chỉ là nghiên cứu, chưa có bằng chứng gì rõ ràng về việc nó sẽ được Apple trang bị cho iOS hay iPhone hay không, nhưng nếu hơi AQ một chút thì rõ ràng, họ đã xây model, đã xác định được vấn đề tới giai đoạn này như trong nghiên cứu nói thì nhiều khả năng, iOS 18 sắp tới cũng sẽ có thể được tận dụng được các tính năng này.

Nếu đó là sự thật thì, đây có thể là một cách tiếp cận rất mới trong cách con người tương tác với AI. Nếu trước giờ chỉ nhập text, và phải nhập đúng, thì AI mới hiểu thì bây giờ, nó đọc màn hình luôn chứ không chỉ dựa vào mỗi text để hiểu hơn về ý định trong đầu của người dùng. Và nếu vậy, cách sử dụng iPhone + AI sẽ tự nhiên hơn rất nhiều. Chúng ta vẫn dùng iPhone như trước giờ, và chỉ cần dùng ngôn ngữ tự nhiên thì máy cũng hiểu được chúng ta muốn gì và làm theo. Theo cách mà xưa giờ Apple làm (một số anh em hay chọc là tái định nghĩa), thì điều này là hoàn toàn có cơ sở.

Và nếu vậy, chúng ta còn thấy được quan điểm của Apple trong việc ứng dụng AI chính là hỗ trợ người dùng xài iPhone được tự nhiên hơn - một cách "nâng cấp" các tính năng truyền thống. Nói cách khác, chúng ta sẽ không có tính năng mới, chỉ là có cách dùng mới với những tính năng đó. Và chắc chắn, với sự xuất sắc của Apple trong khâu tiếp thị sản phẩm mới (chắc anh em còn nhớ Dynamic Island), thì AI chắc chắn sẽ đóng vai trò làm nhiều anh em fan vỡ òa nếu nó được ra mắt chính thức tại WWDC.

Có thể thấy, cách tiếp cận này của Apple rất khác so với việc khai thác AI tạo sinh như ChatGPT hay Copilot hoặc Gemini của Google vốn được dùng để tìm kiếm, khai thác thông tin. Thay vào đó, Apple có thể sẽ chọn cách dùng AI để thổi luồng gió mới hơn vào các dịch vụ, tính năng sẵn có của họ trên iPhone hơn.

Quảng cáo

Và một điểm cuối, nếu thực sự những tính năng AI bằng giải pháp nói trên được Apple triển khai thì nó cũng đòi hỏi phần cứng. Do bản chất đã đọc và hiểu quả nhiều dữ liệu, bao gồm cả tương tác lẫn màn hình của người dùng, nên model AI này buộc phải chạy dưới local, ngay trên máy mà không cần mạng. Lúc này, câu hỏi về phần cứng nào được hỗ trợ, và liệu vậy thì mức độ tiêu thụ năng lượng ra sao, hiệu năng thế nào cũng là câu hỏi nếu khi đó mọi thứ diễn ra đúng như vậy.