Ngay sau khi Meta giới thiệu model Llama 3 thì gần như ngay lập tức Intel cũng công bố về những con chip của hãng đã thể hiện ra sao với model AI mới này của Meta, đồng thời cung cấp chi tiết các điểm chuẩn của những mẫu chip khi kiểm thử với Llama 3.

Với mục tiêu “AI Everywhere” thì Intel không thể chậm chân trong việc tối ưu hoá các mẫu chip hiện có của mình với các model AI mới nhất, các mẫu vi xử lý từ Gaudi 2 và Gaudi 3, Xeon Scalable Granite Rapids cho đến các mẫu Intel Core Ultra cho người dùng phổ thông và dòng GPU Arc đều đã sẵn sàng cho Llama 3.

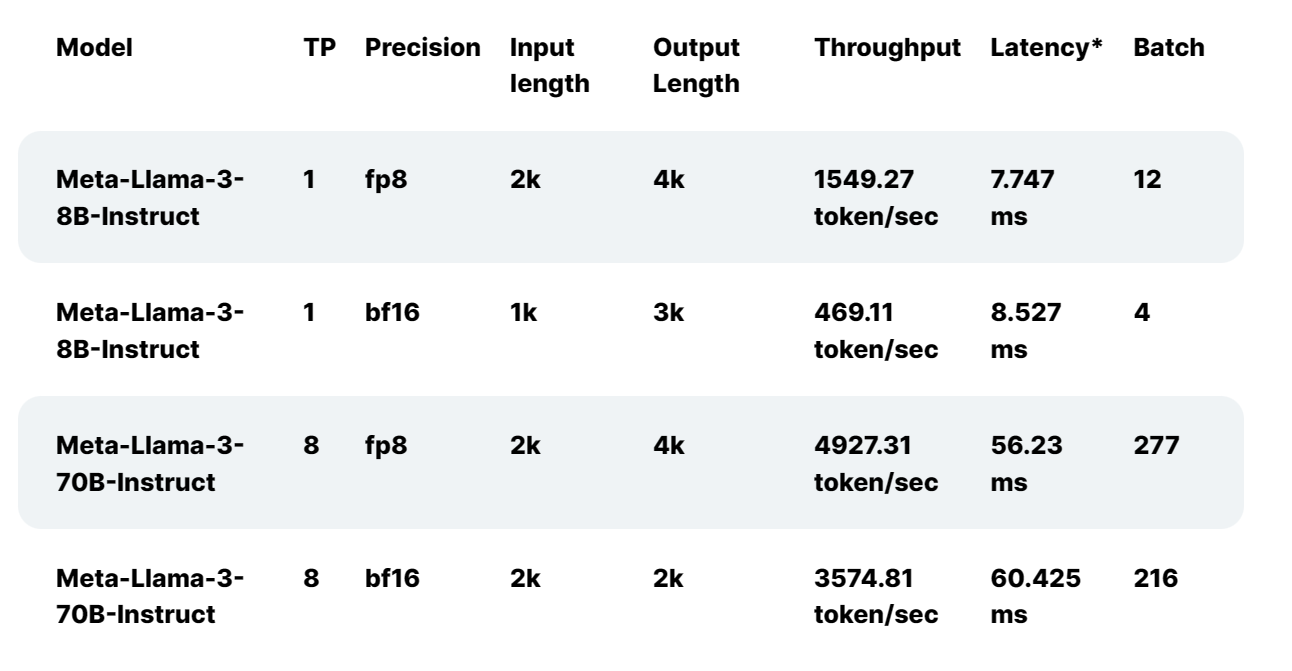

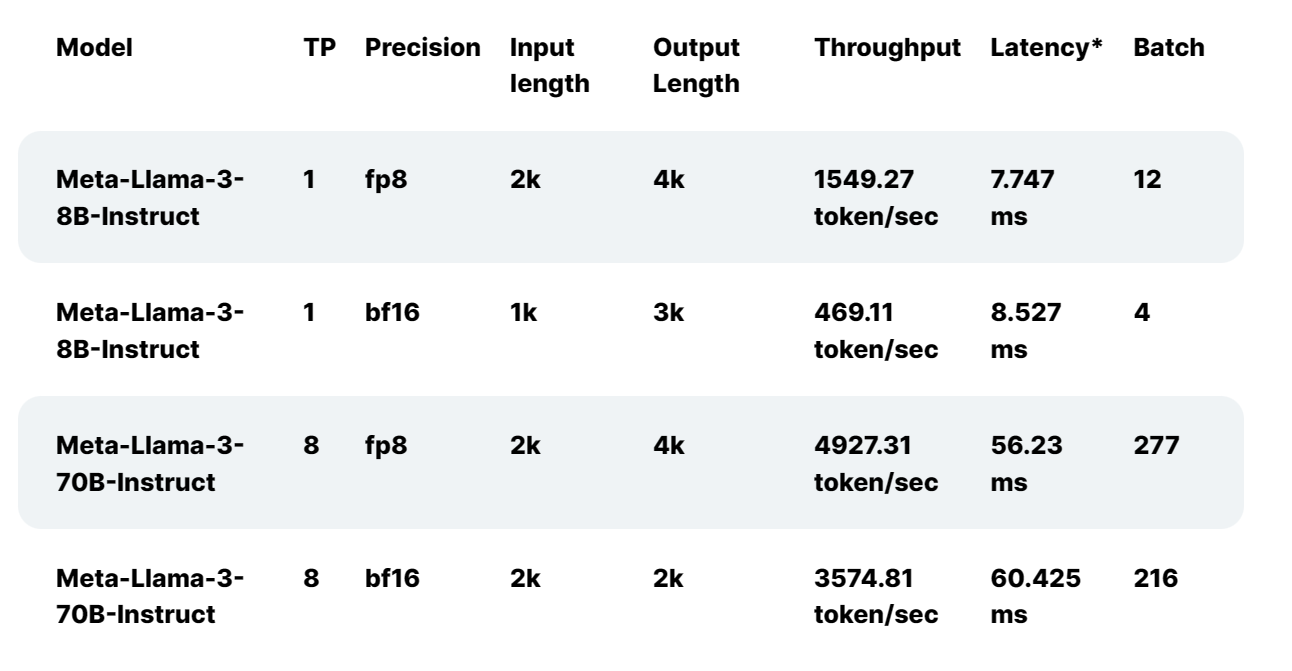

Các mẫu Gaudi 2 trước đây đã được thử nghiệm với Llama 2 từ 7 tỷ tham số, 13 tỷ tham số và 70 tỷ tham số, bây giờ Gaudi 2 tiếp tục được tối ưu với Llama 3 và dĩ nhiên bên cạnh đó là mẫu Gaudi 3 mới vừa được giới thiệu, kết quả thể hiện ở bảng benchmark bên trên, giữa hai model Llama 3 inference và Llama 3 đã fine-tune, mỗi model sẽ có 2 tham số khác nhau.

Các mẫu Gaudi 2 trước đây đã được thử nghiệm với Llama 2 từ 7 tỷ tham số, 13 tỷ tham số và 70 tỷ tham số, bây giờ Gaudi 2 tiếp tục được tối ưu với Llama 3 và dĩ nhiên bên cạnh đó là mẫu Gaudi 3 mới vừa được giới thiệu, kết quả thể hiện ở bảng benchmark bên trên, giữa hai model Llama 3 inference và Llama 3 đã fine-tune, mỗi model sẽ có 2 tham số khác nhau.

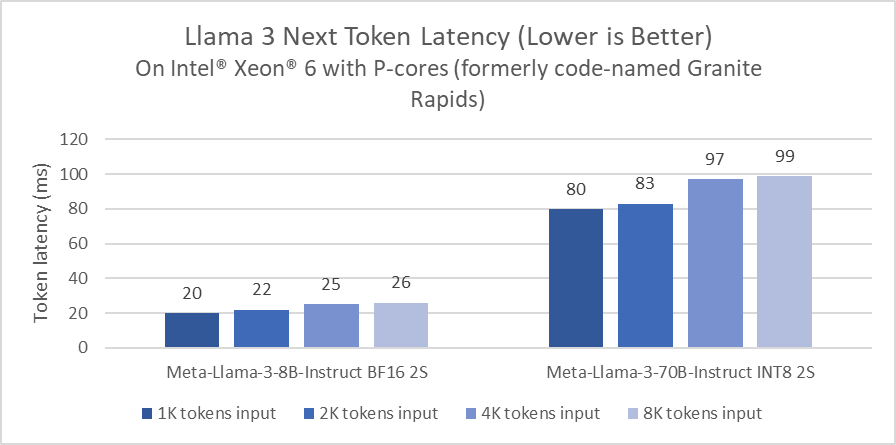

Intel cũng thử nghiệm với các mẫu Intel Xeon 6 (Granite Rapids) là thế hệ mới nhất và Intel Xeon Scalable thế hệ 4 (Shappire Rapids).

Hiệu năng suy luận Meta Llama 3 8B trên phiên bản AWS m7i.metal-48x dựa trên Intel Xeon Scalable Shappire Rapids.

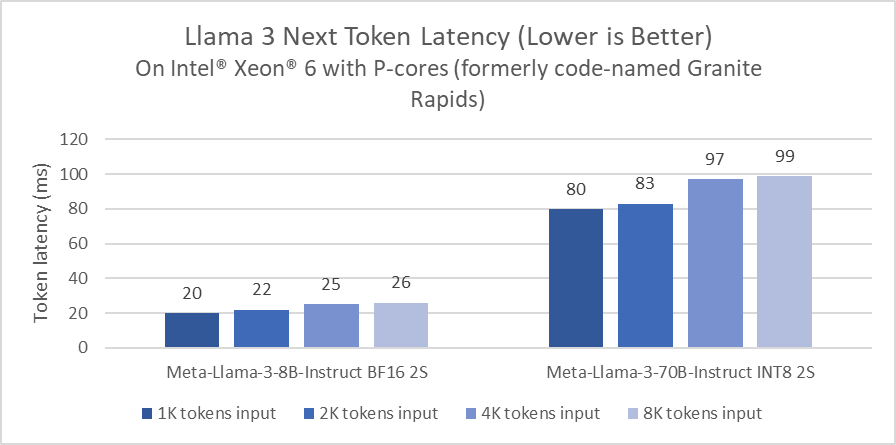

Tiếp tục khi Intel benchmark Llama 3 trên thế hệ Intel Xeon mới nhất vừa được Intel "nhá hàng" tại Intel Vision 2024 là Granite Rapids thì thấy rằng, độ trễ suy luận Llama 3 8B cải thiện gấp 2 lần so với các bộ xử lý Intel Xeon thế hệ 4, và với những model lớn hơn như Llama 3 70B thì đều dưới 100ms cho mỗi token, trong 1 server với 2 socket. Lưu ý là tại Intel Vision 2024 thì Intel thay đổi tên gọi Intel Xeon Scalable thành Intel Xeon, Granite Rapids là Intel Xeon 6 với các nhân P sẽ ra mắt nửa cuối năm nay, còn mẫu Intel Xeon 6 với các nhân E (Sierra Forest) sẽ ra mắt trong quý 2 này.

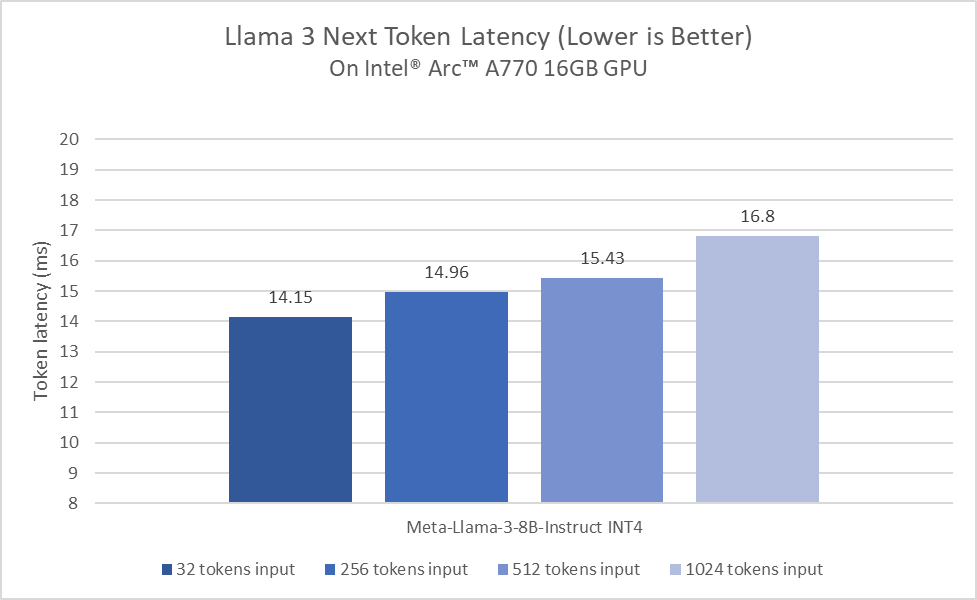

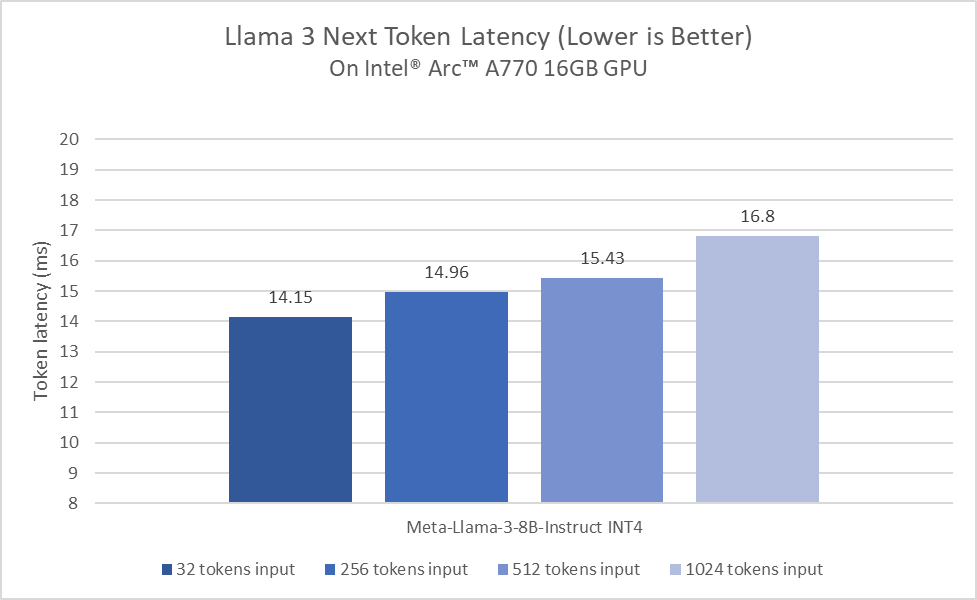

Với các mẫu vi xử lý dành cho người dùng cuối như Intel Core Ultra hay GPU Intel Arc, Intel cũng cho thấy hiệu suất của những mẫu iGPU trong Core Ultra H series và dGPU Intel Arc A770, độ trễ khi thử nghiệm với model Llama 3 8B Instruct INT4 nhìn chung là dưới 20ms.

Riêng với iGPU 8 nhân Xe bên trong Intel Core Ultra đưa ra câu trả lời nhanh hơn tốc độ đọc bình thường của con người, nhờ vào bộ tăng tốc AI DP4a và băng thông bộ nhớ lên đến 120GB/s. Intel cho biết sẽ tiếp tục tối ưu hiệu suất và hiệu quả năng lượng với Llama 3 trên các thế hệ vi xử lý tiếp theo.

Intel.

Meta giới thiệu mô hình ngôn ngữ Llama 3: model AI mạnh nhất hiện tại

Mô hình ngôn ngữ lớn mới nhất của Meta là Llama 3 chính thức ra mắt với 2 model khác nhau: 8 tỷ tham số và 70 tỷ tham số, Llama 3 được Meta cải thiện khả năng suy luận và hiệu suất tổng thể, tốt hơn Llama 2 nhiều lần và cả khi so sánh với một số…

tinhte.vn

Với mục tiêu “AI Everywhere” thì Intel không thể chậm chân trong việc tối ưu hoá các mẫu chip hiện có của mình với các model AI mới nhất, các mẫu vi xử lý từ Gaudi 2 và Gaudi 3, Xeon Scalable Granite Rapids cho đến các mẫu Intel Core Ultra cho người dùng phổ thông và dòng GPU Arc đều đã sẵn sàng cho Llama 3.

Intel cũng thử nghiệm với các mẫu Intel Xeon 6 (Granite Rapids) là thế hệ mới nhất và Intel Xeon Scalable thế hệ 4 (Shappire Rapids).

Hiệu năng suy luận Meta Llama 3 8B trên phiên bản AWS m7i.metal-48x dựa trên Intel Xeon Scalable Shappire Rapids.

Tiếp tục khi Intel benchmark Llama 3 trên thế hệ Intel Xeon mới nhất vừa được Intel "nhá hàng" tại Intel Vision 2024 là Granite Rapids thì thấy rằng, độ trễ suy luận Llama 3 8B cải thiện gấp 2 lần so với các bộ xử lý Intel Xeon thế hệ 4, và với những model lớn hơn như Llama 3 70B thì đều dưới 100ms cho mỗi token, trong 1 server với 2 socket. Lưu ý là tại Intel Vision 2024 thì Intel thay đổi tên gọi Intel Xeon Scalable thành Intel Xeon, Granite Rapids là Intel Xeon 6 với các nhân P sẽ ra mắt nửa cuối năm nay, còn mẫu Intel Xeon 6 với các nhân E (Sierra Forest) sẽ ra mắt trong quý 2 này.

Với các mẫu vi xử lý dành cho người dùng cuối như Intel Core Ultra hay GPU Intel Arc, Intel cũng cho thấy hiệu suất của những mẫu iGPU trong Core Ultra H series và dGPU Intel Arc A770, độ trễ khi thử nghiệm với model Llama 3 8B Instruct INT4 nhìn chung là dưới 20ms.

Riêng với iGPU 8 nhân Xe bên trong Intel Core Ultra đưa ra câu trả lời nhanh hơn tốc độ đọc bình thường của con người, nhờ vào bộ tăng tốc AI DP4a và băng thông bộ nhớ lên đến 120GB/s. Intel cho biết sẽ tiếp tục tối ưu hiệu suất và hiệu quả năng lượng với Llama 3 trên các thế hệ vi xử lý tiếp theo.

Intel.